Pytanie 1

Thunderbolt to interfejs:

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Thunderbolt to interfejs:

Na skutek użycia polecenia ipconfig uzyskano konfigurację przedstawioną na ilustracji. Jaki jest adres IP stacji roboczej, która została poddana testom?

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Realtek RTL8168C(P)/8111C(P)

PCI-E Gigabit Ethernet NIC

Adres fizyczny. . . . . . . . . . : 00-1F-D0-A5-0B-57

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IP. . . . . . . . . . . . . : 192.168.0.11

Maska podsieci. . . . . . . . . . : 255.255.255.0

Brama domyślna. . . . . . . . . . : 192.168.0.1

Serwer DHCP . . . . . . . . . . . : 192.168.0.1

Serwery DNS . . . . . . . . . . . : 62.21.99.95Który procesor jest kompatybilny z płytą główną o przedstawionej specyfikacji?

ASUS micro-ATX, socket 1150, VT-d, DDR3 `1333, 1600 MHz), ATI Radeon X1250, 3 x PCI-Express x1, 3 x PCI-Express x16, 2 x Serial ATA III, USB 3.0, VGA, HDMI, DVI-D

Jakie są przyczyny wyświetlenia na ekranie komputera komunikatu o wykryciu konfliktu adresów IP?

Tryb użytkownika w przełączniku CISCO (User EXEC Mode) umożliwia

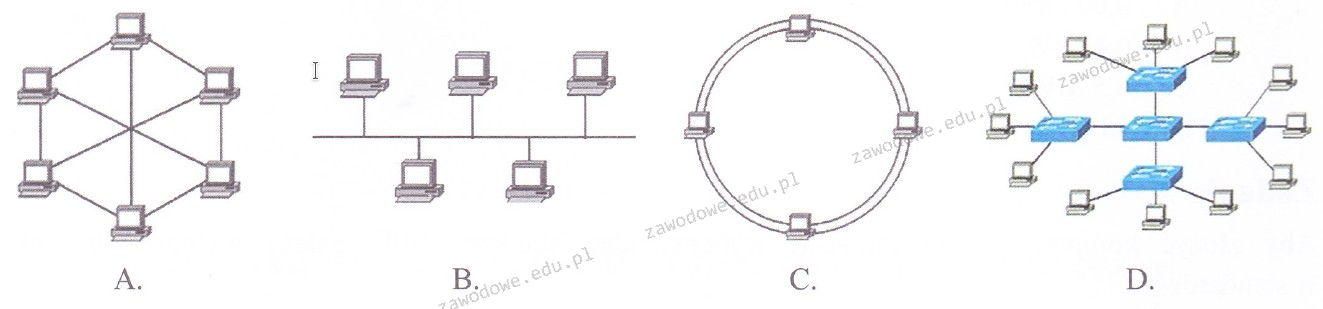

Na którym z przedstawionych rysunków ukazano topologię sieci typu magistrala?

Jakie są różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

Polecenie dsadd służy do

Interfejs graficzny systemu Windows, który wyróżnia się przezroczystością przypominającą szkło oraz delikatnymi animacjami okien, nazywa się

Wykonanie komendy dxdiag w systemie Windows pozwala na

Podczas zamykania systemu operacyjnego na ekranie pojawił się błąd, tak zwany bluescreen, 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN – niepowodzenie zamykania systemu, spowodowane brakiem pamięci. Błąd ten może wskazywać na

Przedsiębiorca przekazujący do składowania odpady inne niż komunalne ma obowiązek prowadzić

W systemie Windows mechanizm ostrzegający przed uruchamianiem nieznanych aplikacji oraz plików pobranych z Internetu funkcjonuje dzięki

Numer przerwania przypisany do karty sieciowej został zapisany w systemie binarnym jako 10101. Ile to wynosi w systemie dziesiętnym?

Aby zamontować przedstawioną kartę graficzną, potrzebna jest płyta główna posiadająca złącze

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie otrzymał zadanie podziału aktualnej lokalnej sieci komputerowej na 16 podsieci. Obecna sieć posiada adres IP 192.168.20.0 i maskę 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Aby powiększyć lub zmniejszyć rozmiar ikony na pulpicie, trzeba obracać rolką myszki, trzymając jednocześnie klawisz

Gdzie w dokumencie tekstowym Word umieszczony jest nagłówek oraz stopka?

Który z protokołów służy do synchronizacji czasu?

Jakie zastosowanie ma polecenie md w systemie Windows?

System S.M.A.R.T. służy do śledzenia funkcjonowania oraz identyfikacji usterek

Podstawowym zadaniem mechanizmu Plug and Play jest

Wskaż standard interfejsu stosowanego do przewodowego połączenia dwóch urządzeń.

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

Program Mozilla Firefox jest udostępniany na zasadach licencji

Najbardziej nieinwazyjnym, a zarazem efektywnym sposobem naprawy komputera zainfekowanego wirusem typu rootkit jest

W jakiej topologii sieci komputerowej każdy węzeł ma bezpośrednie połączenie z każdym innym węzłem?

Liczba 129 w systemie dziesiętnym będzie przedstawiona w formacie binarnym na

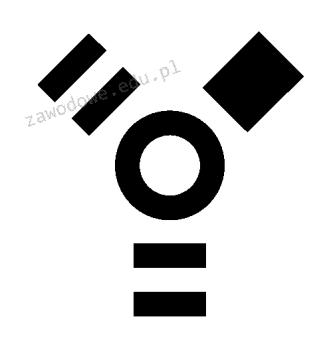

Symbol graficzny przedstawiony na ilustracji oznacza złącze

Hosty A i B nie mają możliwości komunikacji z hostem C. Natomiast komunikacja między hostami A i B przebiega poprawnie. Jakie może być źródło problemu w komunikacji pomiędzy hostami A i C oraz B i C?

Termin określający wyrównanie tekstu do prawego i lewego marginesu to

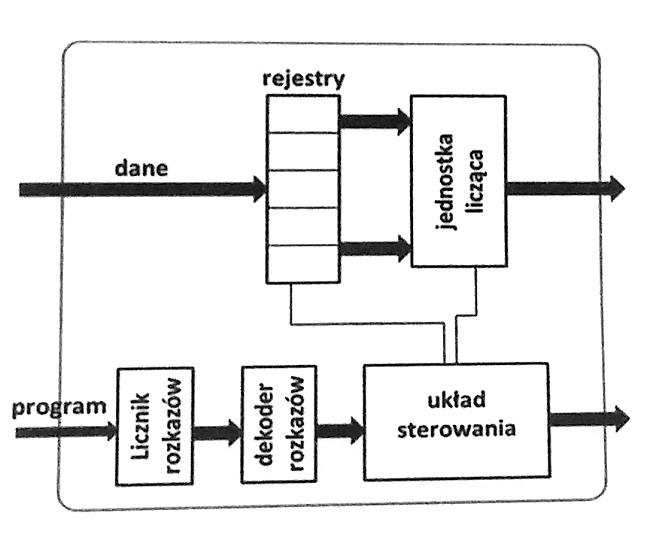

Rejestry przedstawione na diagramie procesora mają zadanie

Aby skutecznie zabezpieczyć system operacyjny przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego konieczne jest

Który z poniższych protokołów służy do zarządzania urządzeniami w sieciach?

Przedstawione na ilustracji narzędzie służy do

Jak nazywa się translacja adresów źródłowych w systemie NAT routera, która zapewnia komputerom w sieci lokalnej dostęp do internetu?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Nowe komponenty komputerowe, takie jak dyski twarde czy karty graficzne, są umieszczane w metalizowanych opakowaniach foliowych, których głównym celem jest zabezpieczenie

Kiedy podczas startu systemu z BIOSu firmy AWARD komputer wyemitował długi dźwięk oraz dwa krótkie, to oznacza, że wystąpił błąd?

Czym jest skrót MAN w kontekście sieci?