Pytanie 1

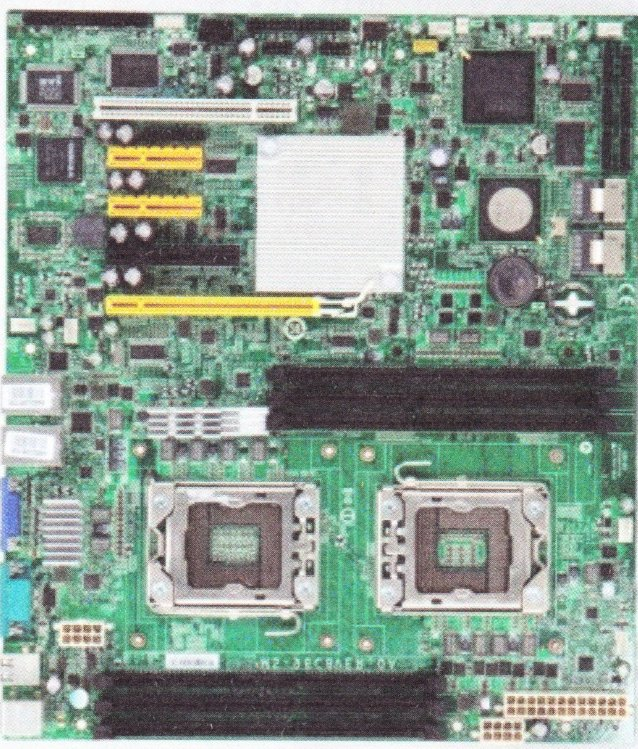

W komputerze użyto płyty głównej widocznej na obrazku. Aby podnieść wydajność obliczeniową maszyny, zaleca się

Wynik: 38/40 punktów (95,0%)

Wymagane minimum: 20 punktów (50%)

W komputerze użyto płyty głównej widocznej na obrazku. Aby podnieść wydajność obliczeniową maszyny, zaleca się

W systemie Windows 7, aby skopiować katalog c:\est wraz ze wszystkimi podkatalogami na zewnętrzny dysk, należy zastosować polecenie

Z jakiego oprogramowania NIE można skorzystać, aby przywrócić dane w systemie Windows na podstawie wcześniej wykonanej kopii?

Jakie narzędzie wraz z odpowiednimi parametrami należy zastosować w systemie Windows, aby uzyskać przedstawione informacje o dysku twardym?

ST9500420AS Identyfikator dysku : A67B7C06 Typ : ATA Stan : Online Ścieżka : 0 Element docelowy : 0 Identyfikator jednostki LUN: 0 Ścieżka lokalizacji : PCIROOT(0)#ATA(C00T00L00) Bieżący stan tylko do odczytu : Nie Tylko do odczytu: Nie Dysk rozruchowy : Tak Dysk plików stronicowania: Tak Dysk plików hibernacji: Nie Dysk zrzutów awaryjnych: Tak Dysk klastrowany: Nie Wolumin ### Lit Etykieta Fs Typ Rozmiar Stan Info ----------- --- ----------- ----- ------------ ------- ------- -------- Wolumin 1 SYSTEM NTFS Partycja 300 MB Zdrowy System Wolumin 2 C NTFS Partycja 445 GB Zdrowy Rozruch Wolumin 3 D HP_RECOVERY NTFS Partycja 15 GB Zdrowy Wolumin 4 E HP_TOOLS FAT32 Partycja 5122 MB Zdrowy

Jakiego typu tablicę partycji trzeba wybrać, aby stworzyć partycję o pojemności 3TB na dysku twardym?

W systemie Windows Server narzędzie, które pozwala na zarządzanie zasadami grupowymi, to

Ustanowienie połączenia pomiędzy dwoma oddalonymi hostami za pomocą publicznej sieci, takiej jak Internet, w sposób, że węzły tej sieci nie wpływają na przesyłane pakiety, to

Do bezprzewodowej transmisji danych pomiędzy dwiema jednostkami, z wykorzystaniem fal radiowych w zakresie ISM 2,4 GHz, przeznaczony jest interfejs

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

Który z wymienionych składników stanowi element pasywny w sieci?

Jakie napięcie zasilające mają moduły pamięci DDR3 SDRAM?

Moduł funkcjonalny, który nie znajduje się w kartach dźwiękowych, to skrót

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

Atak DDoS (ang. Disributed Denial of Service) na serwer doprowadzi do

Rozkaz procesora, przetwarzający informację i zamieniający ją na wynik, należy do grupy rozkazów

Jak nazywa się rodzaj licencji, który sprawia, że program jest w pełni funkcjonalny, ale można go uruchomić jedynie określoną, niewielką liczbę razy od momentu instalacji?

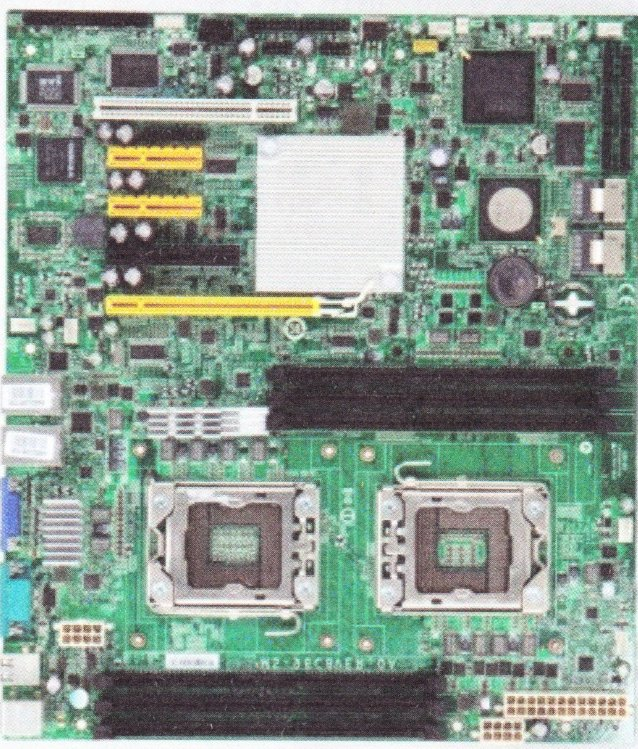

Jaki jest rezultat realizacji którego polecenia w systemie operacyjnym z rodziny Windows, przedstawiony na poniższym rysunku?

Osoba korzystająca z komputera udostępnia w sieci Internet pliki, które posiada. Prawa autorskie będą złamane, gdy udostępni

Jakie jest rozgłoszeniowe IP dla urządzenia o adresie 171.25.172.29 z maską 255.255.0.0?

Jaką rolę odgrywa ISA Server w systemie operacyjnym Windows?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby stworzyć kontroler domeny w środowisku systemów Windows Server na lokalnym serwerze, konieczne jest zainstalowanie roli

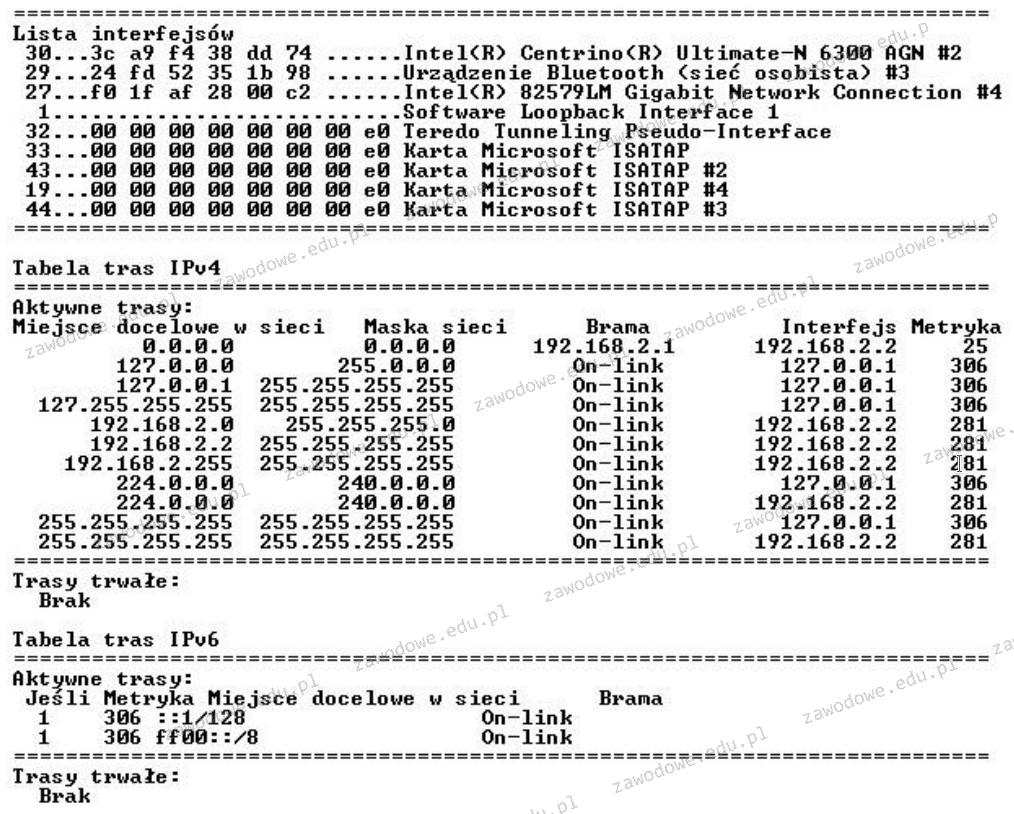

Jeśli użytkownik wybierze pozycję wskazaną strzałką, będzie mógł zainstalować aktualizacje

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

W sieci lokalnej, aby chronić urządzenia sieciowe przed przepięciami oraz różnicami napięć, które mogą wystąpić w trakcie burzy lub innych wyładowań atmosferycznych, należy zastosować

Wykonując polecenie ipconfig /flushdns, można przeprowadzić konserwację urządzenia sieciowego, która polega na

Jakie polecenie jest wysyłane do serwera DHCP, aby zwolnić wszystkie adresy przypisane do interfejsów sieciowych?

Jak nazywa się topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub przełącznik?

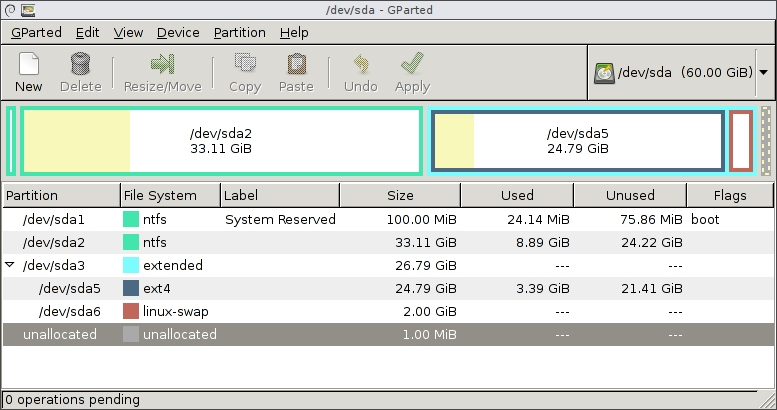

Badanie danych przedstawionych przez program umożliwia dojście do wniosku, że

Który z protokołów umożliwia terminalowe połączenie ze zdalnymi urządzeniami, zapewniając jednocześnie transfer danych w zaszyfrowanej formie?

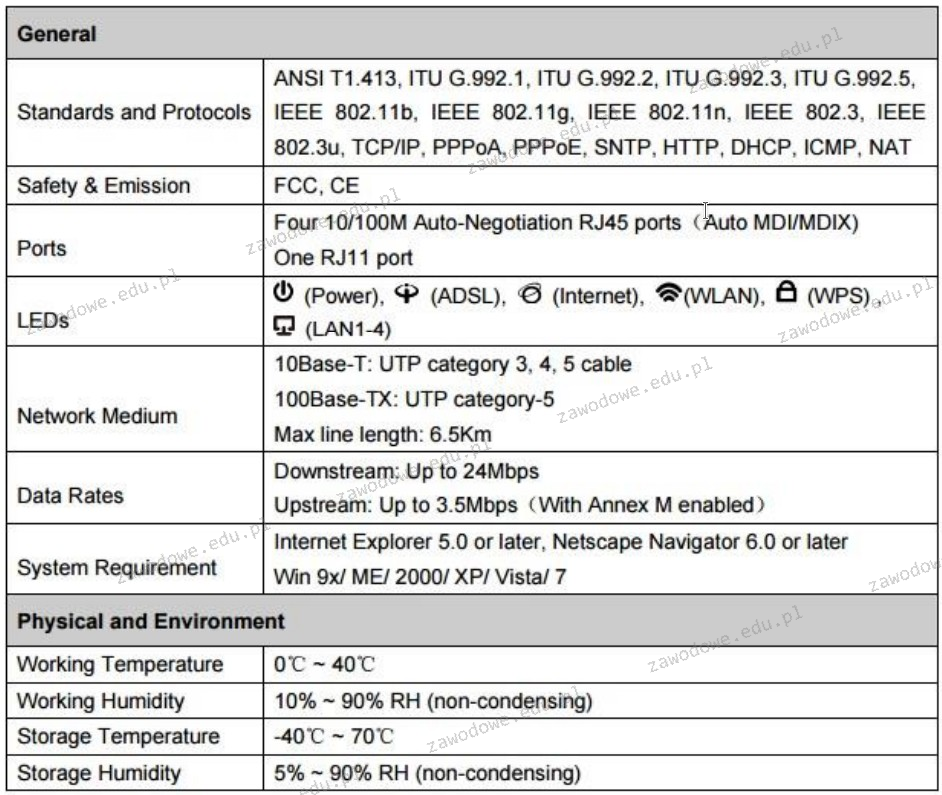

Przedstawiona specyfikacja techniczna odnosi się do

Jaką częstotliwość odświeżania należy ustawić, aby obraz na monitorze był odświeżany 85 razy na sekundę?

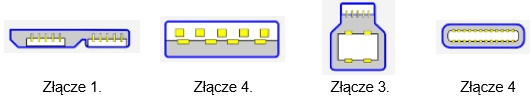

Wskaż kształt złącza USB typu C.

Komenda uname -s w systemie Linux służy do identyfikacji

Czym jest prefetching?

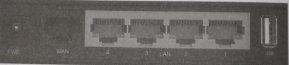

Na który port rutera należy podłączyć kabel od zewnętrznej sieci, aby uzyskać dostęp pośredni do Internetu?

W ustawieniach haseł w systemie Windows Server aktywowano opcję, że hasło musi spełniać wymagania dotyczące złożoności. Z jakiej minimalnej liczby znaków musi składać się hasło użytkownika?

Określenie najbardziej efektywnej trasy dla połączenia w sieci to

Najkrótszy czas dostępu charakteryzuje się