Pytanie 1

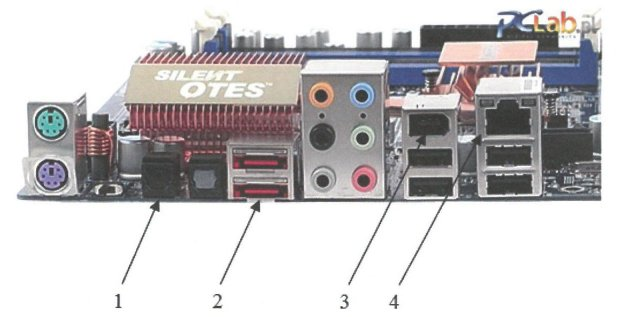

Który z portów na pokazanej płycie głównej pozwala na podłączenie zewnętrznego dysku za pośrednictwem interfejsu e-SATA?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Który z portów na pokazanej płycie głównej pozwala na podłączenie zewnętrznego dysku za pośrednictwem interfejsu e-SATA?

Jakie narzędzie jest używane do diagnozowania łączności między hostami w systemie Windows?

W przedsiębiorstwie trzeba było zreperować 5 komputerów i serwer. Czas potrzebny na naprawę każdego z komputerów wyniósł 1,5 godziny, a serwera 2,5 godziny. Stawka za usługę to 100,00 zł za roboczogodzinę, a do tego doliczany jest podatek VAT w wysokości 23%. Jaka kwota brutto będzie należna za tę usługę?

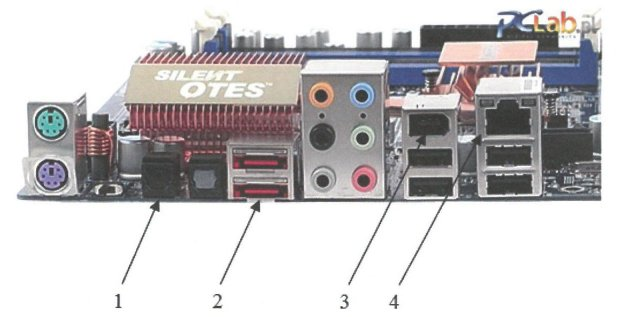

Program WinRAR pokazał okno informacyjne widoczne na ilustracji. Jakiego rodzaju licencją posługiwał się do tej pory użytkownik?

Rodzaj ataku komputerowego, który polega na pozyskiwaniu wrażliwych informacji osobistych poprzez podszywanie się pod zaufaną osobę lub instytucję, to

W komputerze zainstalowano nowy dysk twardy o pojemności 8 TB i podzielono go na dwie partycje, z których każda ma 4 TB. Jaki typ tablicy partycji powinien być zastosowany, aby umożliwić takie partycjonowanie?

Aby zwiększyć lub zmniejszyć rozmiar ikony na pulpicie, należy obracać kółkiem myszy, trzymając jednocześnie wciśnięty klawisz

Jakie polecenie w systemie Windows pozwala na zmianę zarówno nazwy pliku, jak i jego lokalizacji?

W klasycznym adresowaniu, adres IP 74.100.7.8 przynależy do

Jaki sprzęt powinno się wybrać do pomiarów schematu okablowania strukturalnego sieci lokalnej?

Jaki jest adres rozgłoszeniowy w sieci, w której działa host z adresem IP 195.120.252.32 i maską podsieci 255.255.255.192?

Jaki protokół jest stosowany wyłącznie w sieciach lokalnych, gdzie działają komputery z systemami operacyjnymi firmy Microsoft?

Aby przeprowadzić instalację systemu operacyjnego z rodziny Windows na stacjach roboczych, konieczne jest dodanie na serwerze usług

Ustalenie adresów fizycznych MAC na podstawie adresów logicznych IP jest efektem działania protokołu

Polecenie Gpresult

Jakie urządzenie aktywne pozwoli na podłączenie do sieci lokalnej za pomocą kabla UTP 15 komputerów, drukarki sieciowej oraz rutera?

Jakie urządzenie powinno być użyte do połączenia komputerów w układzie gwiazdowym?

Który standard implementacji sieci Ethernet określa sieć wykorzystującą kabel koncentryczny, z maksymalną długością segmentu wynoszącą 185 m?

Jaką długość ma maska sieci dla adresów z klasy B?

Jakim poleceniem w systemie Linux można utworzyć nowych użytkowników?

W systemie Linux program, który odpowiada aplikacji chkdsk z Windows, to

Który z interfejsów umożliwia transfer danych zarówno w formacie cyfrowym, jak i analogowym pomiędzy komputerem a wyświetlaczem?

Każdorazowo automatycznie szyfrowany staje się plik, który został zaszyfrowany przez użytkownika za pomocą systemu NTFS 5.0, w momencie

W systemie Windows 7, aby skopiować katalog c:\est wraz ze wszystkimi podkatalogami na zewnętrzny dysk, należy zastosować polecenie

Ustanowienie połączenia pomiędzy dwoma oddalonymi hostami za pomocą publicznej sieci, takiej jak Internet, w sposób, że węzły tej sieci nie wpływają na przesyłane pakiety, to

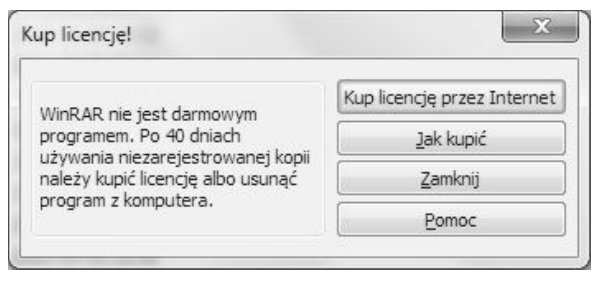

Strategia przedstawiona w diagramie dla tworzenia kopii zapasowych na nośnikach jest znana jako

Jakie zastosowanie ma przedstawione narzędzie?

Które z poniższych wskazówek jest NIEWłaściwe w kontekście konserwacji skanera płaskiego?

Osoba odpowiedzialna za zarządzanie siecią komputerową pragnie ustalić, jakie połączenia są aktualnie nawiązywane na komputerze z systemem operacyjnym Windows oraz które porty są wykorzystywane do nasłuchu. W tym celu powinna użyć polecenia

W jaki sposób powinno się wpisać w formułę arkusza kalkulacyjnego odwołanie do komórki B3, aby przy przenoszeniu tej formuły w inne miejsce arkusza odwołanie do komórki B3 pozostało stałe?

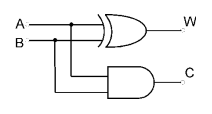

Jakie wartości logiczne otrzymamy w wyniku działania podanego układu logicznego, gdy na wejścia A i B wprowadzimy sygnały A=1 oraz B=1?

Wykonanie polecenia tar -xf dane.tar w systemie Linux spowoduje

Martwy piksel, który jest defektem w monitorach LCD, to punkt, który ciągle ma ten sam kolor

Gdy użytkownik wykonuje w wierszu poleceń komendę ping www.onet.pl, otrzymuje komunikat: "Żądanie polecenia ping nie może znaleźć hosta www.onet.pl Sprawdź nazwę i ponów próbę". Z kolei, po wpisaniu w wierszu poleceń komendy ping 213.180.141.140 (adres IP serwera www.onet.pl), użytkownik otrzymuje odpowiedź z serwera. Jakie mogą być przyczyny tej sytuacji?

Co oznacza kod BREAK odczytany przez układ elektroniczny klawiatury?

Do sprawdzenia, czy zainstalowana karta graficzna komputera przegrzewa się, użytkownik może wykorzystać program

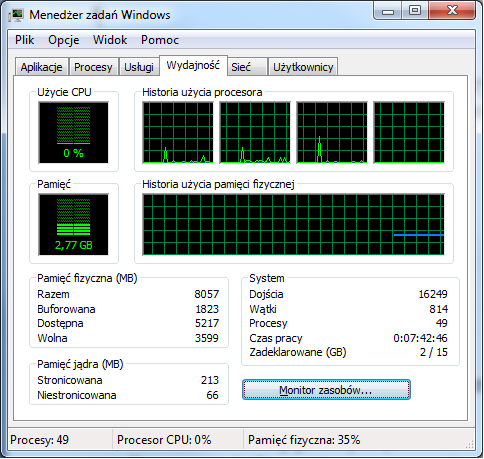

W systemie Windows do uruchomienia przedstawionego narzędzia należy użyć polecenia

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

W systemie Linux do monitorowania użycia procesora, pamięci, procesów i obciążenia systemu służy polecenie

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry