Pytanie 1

Podaj domyślny port używany do przesyłania poleceń w serwerze FTP

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Podaj domyślny port używany do przesyłania poleceń w serwerze FTP

Aby zapobiec uszkodzeniom układów scalonych przy serwisie sprzętu komputerowego, należy korzystać z

Brak informacji o parzystości liczby lub o znaku wyniku operacji w ALU może sugerować problemy z funkcjonowaniem

Jakiego typu macierz RAID nie zapewnia odporności na awarie żadnego z dysków tworzących jej strukturę?

Moduł funkcjonalny, który nie znajduje się w kartach dźwiękowych, to skrót

Komunikat tekstowy KB/Interface error, wyświetlony na ekranie komputera z BIOS POST firmy AMI, informuje o błędzie

W topologii gwiazdy każde urządzenie działające w sieci jest

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Aby uzyskać informacje na temat aktualnie działających procesów w systemie Linux, można użyć polecenia

Jakie stwierdzenie o routerach jest poprawne?

Do umożliwienia komunikacji pomiędzy sieciami VLAN, wykorzystuje się

Minimalna zalecana ilość pamięci RAM dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Jeśli podczas podłączania stacji dysków elastycznych 1,44 MB kabel sygnałowy zostanie włożony odwrotnie, to

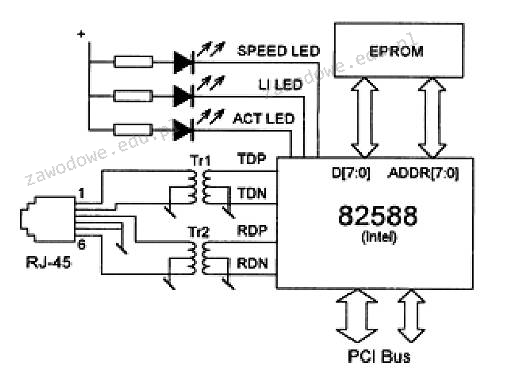

Jaką rolę pełnią elementy Tr1 i Tr2, które są widoczne na schemacie ilustrującym kartę sieciową Ethernet?

Jaką liczbę komputerów można zaadresować w sieci z maską 255.255.255.224?

Polecenie to zostało wydane przez Administratora systemu operacyjnego w trakcie ręcznej konfiguracji sieciowego interfejsu. Wynikiem wykonania tego polecenia jest ```netsh interface ip set address name="Glowna" static 151.10.10.2 255.255.0.0 151.10.0.1```

Jaką normę wykorzystuje się przy okablowaniu strukturalnym w komputerowych sieciach?

Uruchomienie systemu Windows w trybie debugowania pozwala na

Narzędziem do zarządzania usługami katalogowymi w systemach Windows Server, które umożliwia przeniesienie komputerów do jednostki organizacyjnej wskazanej przez administratora, jest polecenie

Pamięć, która działa jako pośrednik pomiędzy pamięcią operacyjną a procesorem o dużej prędkości, to

Industry Standard Architecture to norma magistrali, według której szerokość szyny danych wynosi

Aby zamontować katalog udostępniony w sieci komputerowej w systemie Linux, należy wykorzystać komendę

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

Jaki skrót oznacza rodzaj licencji Microsoft dedykowanej dla szkół, uczelni, instytucji rządowych oraz dużych firm?

Zamiana taśmy barwiącej wiąże się z eksploatacją drukarki

W systemach Windows istnieje możliwość przypisania użytkownika do dowolnej grupy za pomocą panelu

Kable łączące poziome punkty dystrybucyjne z centralnym punktem dystrybucyjnym określa się jako

Firma świadcząca usługi sprzątania potrzebuje drukować faktury tekstowe w czterech kopiach równocześnie, na papierze samokopiującym. Jaką drukarkę powinna wybrać?

Aby zapewnić największe bezpieczeństwo danych przy wykorzystaniu dokładnie 3 dysków, powinny one być zapisywane w macierzy dyskowej

Użycie polecenia net accounts w Wierszu poleceń systemu Windows, które ustawia maksymalny czas ważności hasła, wymaga zastosowania opcji

Aby uzyskać wyświetlenie podanych informacji o systemie Linux w terminalu, należy skorzystać z komendy

Jak nazywa się atak na sieć komputerową, który polega na przechwytywaniu przesyłanych w niej pakietów?

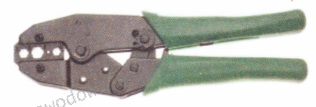

Do jakiego typu wtyków przeznaczona jest zaciskarka pokazana na ilustracji?

Złocenie styków złącz HDMI ma na celu

Granice domeny kolizyjnej nie są określane przez porty takich urządzeń jak

Aby mieć możliwość tworzenia kont użytkowników, komputerów oraz innych obiektów, a także centralnego przechowywania informacji o nich, konieczne jest zainstalowanie na serwerze Windows roli

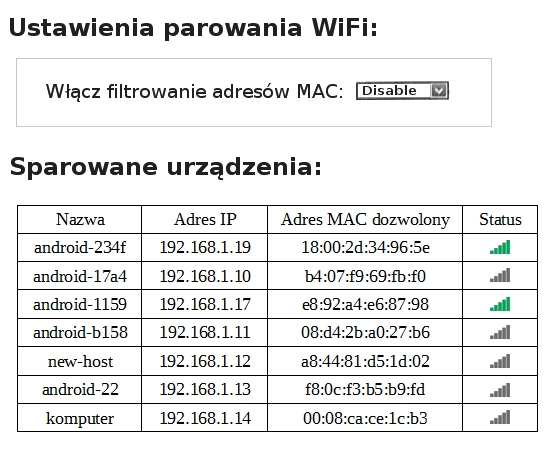

Na rysunku przedstawiono konfigurację urządzenia WiFi. Wskaż, które z poniższych stwierdzeń dotyczących tej konfiguracji jest poprawne?

Umożliwienie stacjom roboczym Windows, OS X oraz Linux korzystania z usług drukowania Linuxa i serwera plików zapewnia serwer

Nazwa licencji oprogramowania komputerowego, które jest dystrybuowane bezpłatnie, lecz z ograniczoną przez twórcę funkcjonalnością w porównaniu do pełnej, płatnej wersji, gdzie po upływie 30 dni zaczynają się wyświetlać reklamy oraz przypomnienia o konieczności rejestracji, to

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z