Pytanie 1

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?

Jaką wartość w systemie szesnastkowym ma liczba 1101 0100 0111?

Cienki klient (thin client) to?

Jak nazywa się program, który pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym?

Jakie urządzenie powinno się wykorzystać, aby rozszerzyć zasięg sieci bezprzewodowej w obiekcie?

Który z poniższych protokołów reprezentuje protokół warstwy aplikacji w modelu ISO/OSI?

Okablowanie strukturalne klasyfikuje się jako część infrastruktury

Jakie narzędzie służy do delikatnego wyginania blachy obudowy komputera oraz przykręcania śruby montażowej w miejscach trudno dostępnych?

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji oświetleniowej powinna wynosić

Wtyczka zasilająca SATA ma uszkodzony żółty przewód. Jakie to niesie za sobą konsekwencje dla napięcia na złączu?

Jakie urządzenia dotyczą terminy SLI?

Jakie będzie rezultatem dodawania liczb 10011012 i 110012 w systemie binarnym?

W którym modelu płyty głównej można zamontować procesor o podanych parametrach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

Narzędzie diagnostyczne tracert służy do ustalania

Aby stworzyć bezpieczny wirtualny tunel pomiędzy dwoma komputerami korzystającymi z Internetu, należy użyć technologii

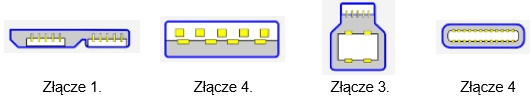

Wskaż kształt złącza USB typu C.

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

Które narzędzie jest przeznaczone do lekkiego odgięcia blachy obudowy komputera oraz zamocowania śruby montażowej w trudno dostępnym miejscu?

Jakie napięcie zasilające mają pamięci DDR2?

Adresy IPv6 są reprezentowane jako liczby

Która usługa pozwala na zdalne zainstalowanie systemu operacyjnego?

Jakiemu zapisowi w systemie heksadecymalnym odpowiada binarny zapis adresu komórki pamięci 0111 1100 1111 0110?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

Jaka jest maksymalna liczba komputerów, które mogą być zaadresowane w podsieci z adresem 192.168.1.0/25?

Zapis liczby w systemie oznaczonym jako #108 to

Komputer jest podłączony do sieci Internet, a na jego pokładzie brak oprogramowania antywirusowego. Jak można sprawdzić, czy ten komputer jest zainfekowany wirusem, nie zmieniając ustawień systemowych?

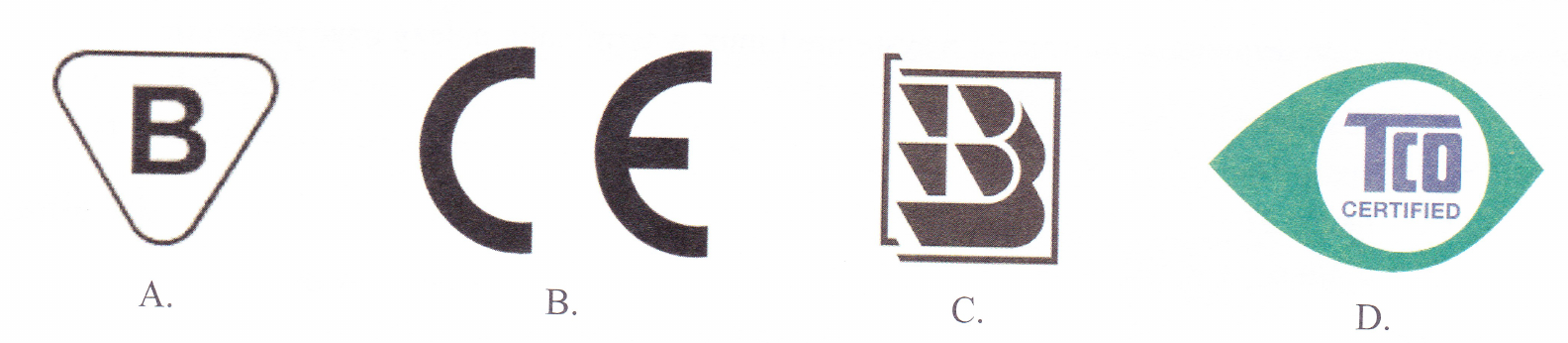

Wskaż symbol umieszczany na urządzeniach elektrycznych, które są przeznaczone do obrotu i sprzedaży na terenie Unii Europejskiej?

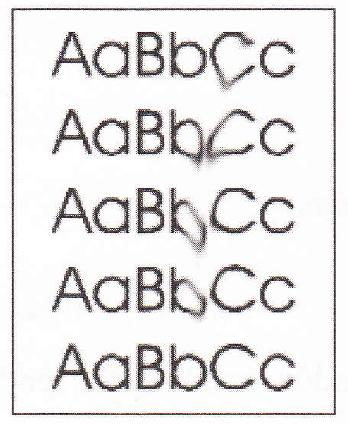

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

Diagnostykę systemu Linux można przeprowadzić używając polecenia

Architecture: x86_64 CPU op-mode(s): 32-bit, 64-bit Byte Order: Little Endian CPU(s): 8 On-line CPU(s) list: 0-7 Thread(s) per core: 2 Core(s) per socket: 4 Socket(s): 1 NUMA node(s): 1 Vendor ID: GenuineIntel CPU family: 6 Model: 42 Stepping: 7 CPU MHz: 1600.000 BogoMIPS: 6784.46 Virtualization: VT-x L1d cache: 32K L1i cache: 32K L2 cache: 256K L3 cache: 8192K NUMA node0 CPU(s): 0-7

Który standard złącza DVI pozwala na przesyłanie wyłącznie sygnałów analogowych?

Najczęstszą przyczyną niskiej jakości wydruku z drukarki laserowej, która objawia się widocznym rozmazywaniem tonera, jest

Wskaż zewnętrzny protokół rutingu?

Jak wiele adresów IP można wykorzystać do przypisania komputerom w sieci o adresie 192.168.100.0 z maską 255.255.255.0?

Rejestry procesora są resetowane poprzez

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST zgłosi błąd odczytu lub zapisu w pamięci CMOS?

W systemie Linux, co oznacza znak "~" w ścieżce dostępu do plików?

Ustawienia wszystkich kont użytkowników na komputerze znajdują się w gałęzi rejestru oznaczonej akronimem