Pytanie 1

Sprzęt, który umożliwia konfigurację sieci VLAN, to

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Sprzęt, który umożliwia konfigurację sieci VLAN, to

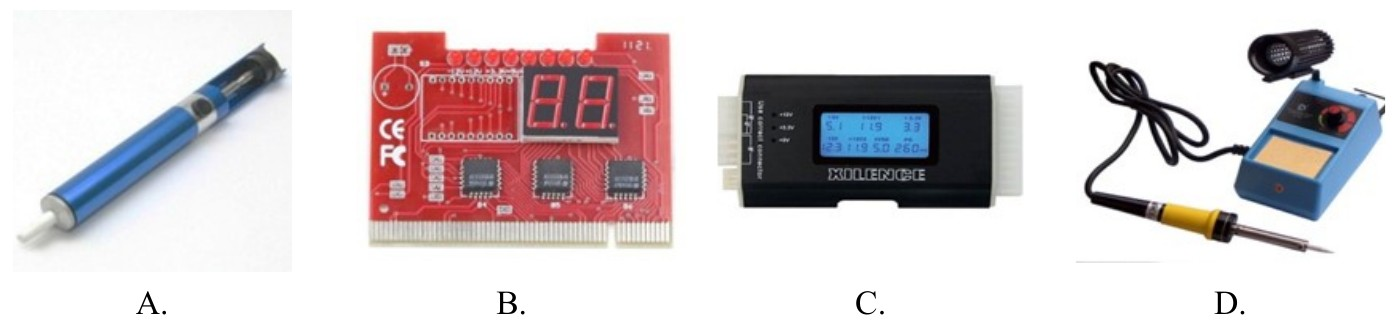

Jakie zastosowanie ma przedstawione narzędzie?

Jakie są zasadnicze różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

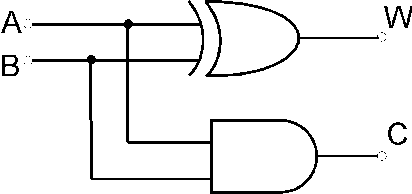

Wynikiem działania przedstawionego układu logicznego po podaniu na wejściach A i B sygnałów logicznych A=1 i B=1 są wartości logiczne:

Miarą wyrażaną w decybelach, która określa różnicę pomiędzy mocą sygnału wysyłanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej, jest

Adres IP 192.168.2.0/24 został podzielony na 8 podsieci. Jaką maskę należy zastosować dla tych nowych podsieci?

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

Na rysunku widoczny jest symbol graficzny

Jakie oznaczenie na schematach sieci LAN przypisuje się punktom rozdzielczym dystrybucyjnym znajdującym się na różnych kondygnacjach budynku według normy PN-EN 50173?

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

Rezultatem wykonania przedstawionego fragmentu skryptu jest:

#!/bin/sh mkdir kat1 touch kat1/plik.txt

Przy zgrywaniu filmu kamera cyfrowa przesyła na dysk 220 MB na minutę. Wybierz z diagramu interfejs o najniższej prędkości transferu, który umożliwia taką transmisję

Na ilustracji pokazano część efektu działania programu przeznaczonego do testowania sieci. Sugeruje to użycie polecenia diagnostycznego w sieci

TCP 192.168.0.13:51614 bud02s23-in-f8:https ESTABLISHED TCP 192.168.0.13:51615 edge-star-mini-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51617 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51619 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51620 93.184.220.29:http TIME_WAIT TCP 192.168.0.13:51621 bud02s23-in-f206:https TIME_WAIT TCP 192.168.0.13:51622 xx-fbcdn-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51623 108.161.188.192:https ESTABLISHED TCP 192.168.0.13:51626 23.111.9.32:https TIME_WAIT TCP 192.168.0.13:51628 lg-in-f155:https ESTABLISHED TCP 192.168.0.13:51629 waw02s06-in-f68:https ESTABLISHED

Liczba FAFC w systemie heksadecymalnym odpowiada wartości liczbowej

Standard sieci bezprzewodowej WiFi 802.11 a/n operuje w zakresie

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Aby zweryfikować w systemie Windows działanie nowo zainstalowanej drukarki, co należy zrobić?

Atak DDoS (ang. Disributed Denial of Service) na serwer doprowadzi do

W architekturze sieci lokalnych opartej na modelu klient - serwer

Sieć lokalna posiada adres IP 192.168.0.0/25. Który adres IP odpowiada stacji roboczej w tej sieci?

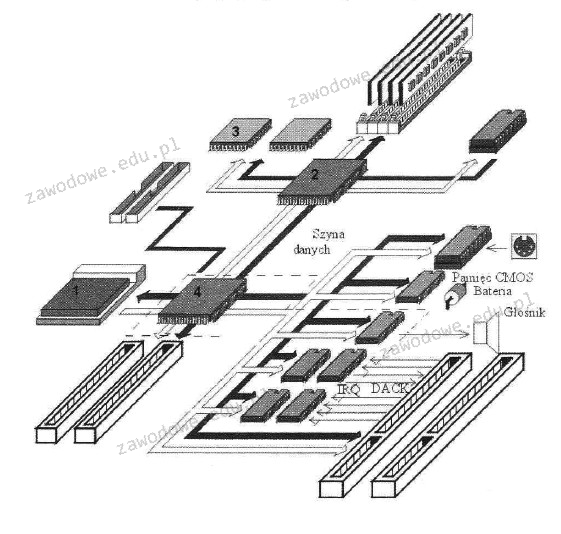

Jaką liczbą oznaczono procesor na diagramie płyty głównej komputera?

Dysk twardy podczas pracy stuka i można zaobserwować bardzo powolne uruchamianie systemu oraz odczytywanie danych. Aby naprawić tę usterkę, po zabezpieczeniu danych na nośniku zewnętrznym należy

Protokół, który pozwala urządzeniom na uzyskanie od serwera informacji konfiguracyjnych, takich jak adres IP bramy sieciowej, to

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows umożliwi wyświetlenie szczegółów wszystkich zasobów udostępnionych na komputerze lokalnym?

W systemie Windows przypadkowo usunięto konto użytkownika, ale katalog domowy pozostał. Czy możliwe jest odzyskanie niezaszyfrowanych danych z katalogu domowego tego użytkownika?

Zakres adresów IPv4 od 224.0.0.0 do 239.255.255.255 jest przeznaczony do jakiego rodzaju transmisji?

Jakie będą wydatki na materiały potrzebne do produkcji 20 kabli typu patchcord o długości 50 cm?

| Nazwa towaru | Cena jedn. brutto |

|---|---|

| wtyk RJ45 | 1,00 zł / szt. |

| koszulka ochronna na wtyk RJ45 | 1,00 zł / szt. |

| skrętka UTP | 1,20 zł / m |

Serwer, który realizuje żądania w protokole komunikacyjnym HTTP, to serwer

Jeżeli rozmiar jednostki alokacji wynosi 1024 bajty, to ile klastrów zajmą pliki umieszczone w tabeli na dysku?

| Nazwa | Wielkość |

|---|---|

| Ala.exe | 50 B |

| Dom.bat | 1024 B |

| Wirus.exe | 2 kB |

| Domes.exr | 350 B |

Bezprzewodową komunikację komputerów w sieci lokalnej zapewnia

Najczęstszym powodem, dla którego toner rozmazuje się na wydrukach z drukarki laserowej, jest

Symbol graficzny przedstawiony na ilustracji oznacza jaką bramkę logiczną?

W systemie Windows, gdzie należy ustalić wymagania dotyczące złożoności hasła?

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu ustawienia kolejności uruchamiania systemów operacyjnych, konieczna jest modyfikacja zawartości

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Wynikiem przeprowadzenia polecenia arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

Jaki port na tylnym panelu płyty głównej jest w dokumentacji określany jako port zgodny z normą RS232C?

Który z protokołów jest stosowany w procesie rozpoczęcia sesji VoIP?

W projekcie sieci komputerowej przewiduje się użycie fizycznych adresów kart sieciowych. Która warstwa modelu ISO/OSI odnosi się do tych adresów w komunikacji?