Pytanie 1

Do interfejsów pracujących równolegle należy interfejs

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Do interfejsów pracujących równolegle należy interfejs

Aby zweryfikować w systemie Windows działanie nowo zainstalowanej drukarki, co należy zrobić?

Według normy JEDEC, napięcie zasilające dla modułów pamięci RAM DDR3L wynosi

Stacja robocza powinna znajdować się w tej samej podsieci co serwer o adresie IP 192.168.10.150 i masce 255.255.255.192. Który adres IP powinien być skonfigurowany w ustawieniach protokołu TCP/IP karty sieciowej stacji roboczej?

W celu poprawy efektywności procesora Intel można wykorzystać procesor oznaczony literą

Jaką postać ma liczba szesnastkowa: FFFF w systemie binarnym?

Narzędzie pokazane na ilustracji służy do

Pamięć, która nie traci danych, może być elektrycznie kasowana i programowana, znana jest pod skrótem

W przypadku dysku twardego, w jakiej jednostce wyrażana jest wartość współczynnika MTBF (Mean Time Between Failure)?

Przedstawione na ilustracji narzędzie jest przeznaczone do

Podaj standard interfejsu wykorzystywanego do przewodowego łączenia dwóch urządzeń.

Jeżeli w konfiguracji karty graficznej zostanie wybrane odświeżanie obrazu większe od zalecanego, monitor CRT spełniający normy TCO 99

Interfejs SLI (ang. Scalable Link Interface) jest wykorzystywany do łączenia

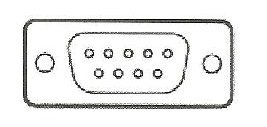

Na ilustracji przedstawiono złącze

Jakie elementy łączy okablowanie pionowe w sieci LAN?

Złącze SC stanowi standard w cablach

Która operacja może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Aby przetestować w systemie Windows poprawność działania nowo zainstalowanej drukarki, należy

Czym jest NAS?

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

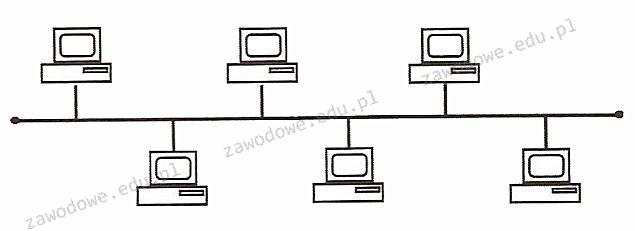

Na ilustracji ukazano sieć o układzie

To narzędzie może być wykorzystane do

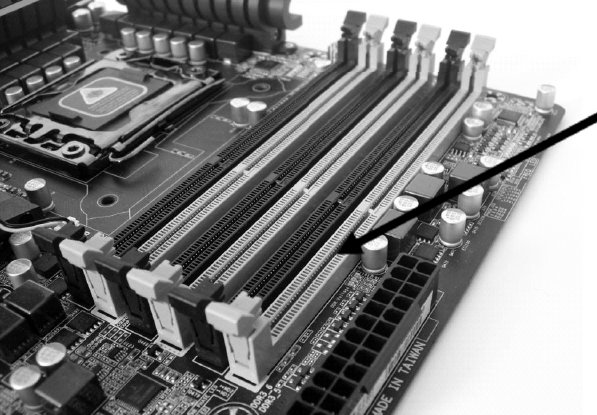

Jaki typ pamięci powinien być umieszczony na płycie głównej komputera w miejscu, które wskazuje strzałka?

W serwerach warto korzystać z dysków, które obsługują tryb Hot plugging, ponieważ

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Na stabilność wyświetlanego obrazu w monitorach CRT istotny wpływ ma

Aby poprawić niezawodność oraz efektywność przesyłania danych na serwerze, należy

Dane z HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

Aby możliwe było przekierowanie drukowanego dokumentu na dysk twardy, należy w opcjach konfiguracyjnych drukarki wybrać drukowanie do portu

Z jaką minimalną efektywną częstotliwością taktowania mogą działać pamięci DDR2?

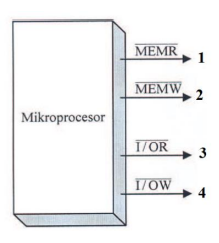

Sygnał kontrolny generowany przez procesor, umożliwiający zapis do urządzeń wejściowych i wyjściowych, został na diagramie oznaczony numerem

Podstawowym zadaniem mechanizmu Plug and Play jest

Urządzenie używane do zestawienia 6 komputerów w sieci lokalnej to:

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Częścią zestawu komputerowego, która zajmuje się zarówno przetwarzaniem danych wejściowych, jak i wyjściowych, jest

Oprogramowanie, które jest przypisane do konkretnego komputera lub jego komponentu i nie pozwala na reinstalację na nowszym sprzęcie zakupionym przez tego samego użytkownika, nosi nazwę

Jakie narzędzie jest najbardziej odpowiednie do delikatnego zgięcia blachy obudowy komputera oraz przykręcenia śruby montażowej w trudno dostępnej lokalizacji?

Z informacji przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi

| 184 styki |

| 64-bitowa szyna danych |

| Pojemność 1024 MB |

| Przepustowość 3200 MB/s |