Pytanie 1

Osoba pragnąca jednocześnie drukować dokumenty w wersji oryginalnej oraz trzech kopiach na papierze samokopiującym, powinna nabyć drukarkę

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Osoba pragnąca jednocześnie drukować dokumenty w wersji oryginalnej oraz trzech kopiach na papierze samokopiującym, powinna nabyć drukarkę

Do przechowywania fragmentów dużych plików programów oraz danych, które nie mieszczą się w całości w pamięci, wykorzystywany jest

Niskopoziomowe formatowanie dysku IDE HDD polega na

Karta rozszerzeń przedstawiona na ilustracji może być zainstalowana w komputerze, jeśli na płycie głównej znajduje się przynajmniej jeden dostępny slot

Która z wymienionych czynności konserwacyjnych związana jest wyłącznie z drukarką laserową?

Jakie urządzenie wykorzystuje się do pomiaru napięcia w zasilaczu?

Które medium transmisyjne charakteryzuje się najmniejszym ryzykiem narażenia na zakłócenia elektromagnetyczne przesyłanego sygnału?

Jakie są zakresy częstotliwości oraz maksymalne prędkości przesyłu danych w standardzie 802.11g WiFi?

Jakie polecenie w systemie Linux pozwala na dodanie istniejącego użytkownika nowak do grupy technikum?

Na ilustracji przedstawiono część procesu komunikacji z serwerem, która została przechwycona przez aplikację Wireshark. Jaki to serwer?

Discover - Transaction ID 0x6a16b7a5 Offer - Transaction ID 0x6a16b7a5 Request - Transaction ID 0x6a16b7a5 ACK - Transaction ID 0x6a16b7a5

Wynikiem przeprowadzenia polecenia arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

Jakie zastosowanie ma oprogramowanie Microsoft Hyper-V?

Do ilu sieci należą komputery o adresach IP i maskach sieci przedstawionych w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji protokołów TCP/IP lub innych przesyłanych lub odbieranych w sieci komputerowej, do której jest podłączony komputer użytkownika?

Rysunek ilustruje rezultaty sprawdzania działania sieci komputerowej przy użyciu polecenia

Badanie wp.pl [212.77.100.101] z użyciem 32 bajtów danych: Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=27ms TTL=249

Polecenie to zostało wydane przez Administratora systemu operacyjnego w trakcie ręcznej konfiguracji sieciowego interfejsu. Wynikiem wykonania tego polecenia jest ```netsh interface ip set address name="Glowna" static 151.10.10.2 255.255.0.0 151.10.0.1```

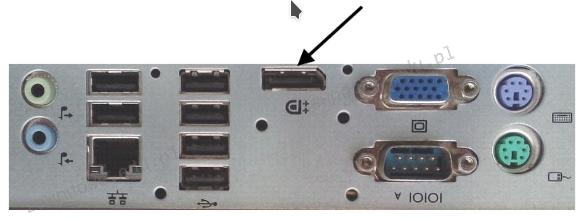

Na ilustracji ukazany jest tylny panel stacji roboczej. Strzałką wskazano port

Ile urządzeń będzie można zaadresować w każdej podsieci, jeśli sieć 172.16.6.0 zostanie podzielona przy pomocy maski /27 na jak największą liczbę podsieci?

W jakich jednostkach opisuje się przesłuch zbliżny NEXT?

Aby użytkownicy lokalnej sieci mogli korzystać z przeglądarek do odwiedzania stron WWW za pomocą protokołów HTTP i HTTPS, brama internetowa musi umożliwiać ruch na portach

Użytkownicy w sieciach bezprzewodowych mogą być uwierzytelniani zdalnie przy pomocy usługi

W systemie dziesiętnym liczba 110011(2) przedstawia się jako

Jaki typ grupy jest automatycznie przypisany dla nowo tworzonej grupy w kontrolerze domeny systemu Windows Server?

Jak nazywa się pamięć podręczna?

Do czynności konserwacyjnych związanych z użytkowaniem skanera płaskiego należy

Zarządzanie pasmem (ang. bandwidth control) w switchu to funkcjonalność

Które z poniższych zdań charakteryzuje protokół SSH (Secure Shell)?

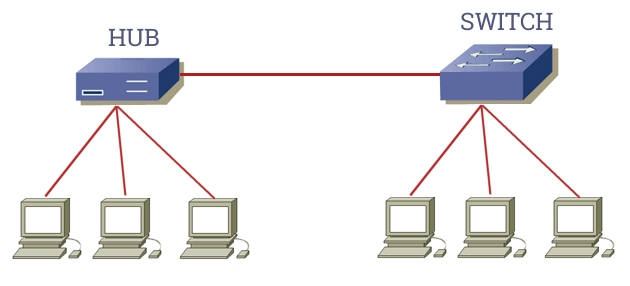

Ile kolizji domenowych występuje w sieci przedstawionej na ilustracji?

Jaką maksymalną liczbę adresów można przypisać urządzeniom w sieci 10.0.0.0/22?

Elementem płyty głównej, który odpowiada za wymianę informacji pomiędzy procesorem a innymi komponentami płyty, jest

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

Technologia procesorów serii Intel Core stosowana w modelach i5, i7 oraz i9, pozwalająca na zwiększenie taktowania w przypadku gdy komputer potrzebuje wyższej mocy obliczeniowej, to

Jak nazywa się rodzaj licencji, który sprawia, że program jest w pełni funkcjonalny, ale można go uruchomić jedynie określoną, niewielką liczbę razy od momentu instalacji?

Która z licencji umożliwia korzystanie przez każdego użytkownika z programu bez ograniczeń wynikających z autorskich praw majątkowych?

W systemie Linux program top umożliwia

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

W systemie Linux do monitorowania użycia procesora, pamięci, procesów i obciążenia systemu służy polecenie

Która z wymienionych czynności konserwacyjnych drukarek dotyczy tylko drukarki laserowej?

Aby uzyskać adres IPv4, za pomocą usługi DHCP, komputer kliencki wysyła żądania z portu

Bezprzewodową komunikację komputerów w sieci lokalnej zapewnia