Pytanie 1

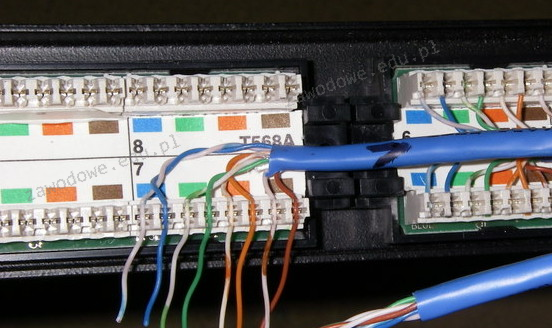

Na ilustracji widać patchpanel - panel krosowy kategorii 5E bez ekranowania, który posiada złącze szczelinowe typu LSA. Jakie narzędzie należy zastosować do wkładania kabli w te złącza?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji widać patchpanel - panel krosowy kategorii 5E bez ekranowania, który posiada złącze szczelinowe typu LSA. Jakie narzędzie należy zastosować do wkładania kabli w te złącza?

Kontrola pasma (ang. bandwidth control) w switchu to funkcjonalność

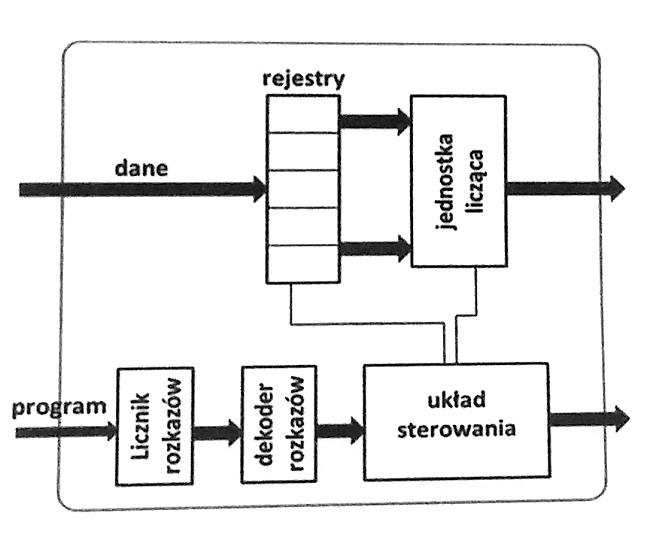

Złącze widoczne na obrazku pozwala na podłączenie

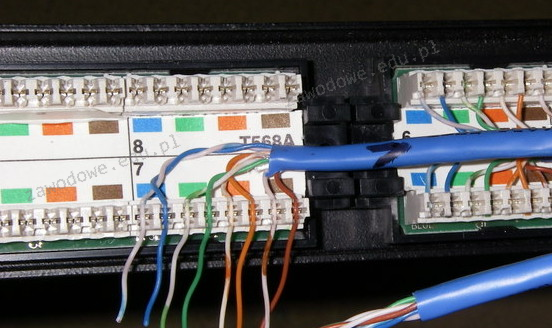

Rejestry przedstawione na diagramie procesora mają zadanie

Aktywacja opcji Udostępnienie połączenia internetowego w systemie Windows powoduje automatyczne przydzielanie adresów IP dla komputerów (hostów) z niej korzystających. W tym celu używana jest usługa

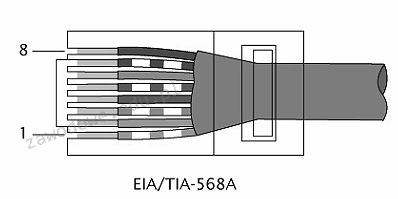

W technologii Ethernet 100BaseTX do przesyłania danych wykorzystywane są żyły kabla UTP podłączone do pinów

Narzędzie pokazane na ilustracji służy do

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

W systemie Linux, aby wyszukać wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i zaczynają się na literę a lub literę b lub literę c, należy wydać polecenie

Wykonanie komendy perfmon w konsoli systemu Windows spowoduje

Zbiór zasad określających metodę wymiany danych w sieci to

Aby chronić systemy sieciowe przed atakami z zewnątrz, należy zastosować

Która z usług serwerowych oferuje automatyczne ustawienie parametrów sieciowych dla stacji roboczych?

Jakie urządzenie łączy sieć lokalną z siecią rozległą?

Podczas zmiany ustawień rejestru Windows w celu zapewnienia bezpieczeństwa operacji, na początku należy

Która norma odnosi się do okablowania strukturalnego?

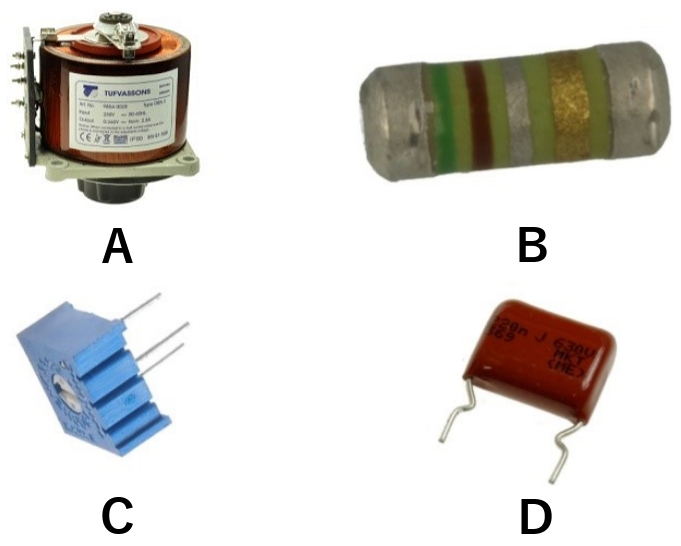

Wskaż ilustrację przedstawiającą kondensator stały?

Komputer uzyskuje dostęp do Internetu za pośrednictwem sieci lokalnej. Gdy użytkownik wpisuje w przeglądarkę internetową adres www.wp.pl, nie może otworzyć strony WWW, natomiast podanie adresu IP, przykładowo 212.77.100.101, umożliwia otwarcie tej strony. Jakie mogą być tego powody?

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Program do odzyskiwania danych, stosowany w warunkach domowych, umożliwia przywrócenie danych z dysku twardego w sytuacji

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Do właściwego funkcjonowania procesora konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

W czterech różnych sklepach ten sam model komputera oferowany jest w różnych cenach. Gdzie można go kupić najtaniej?

Oblicz koszt brutto materiałów niezbędnych do połączenia w sieć w topologii gwiazdy 3 komputerów wyposażonych w karty sieciowe, wykorzystując przewody o długości 2m. Ceny materiałów podano w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu "skrętka" | 1 zł za 1 metr |

Czym jest mapowanie dysków?

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny jedynie za archiwizację danych zgromadzonych na dysku serwera?

Funkcje z różnych dziedzin (data i czas, finanse, tekst, matematyka, statystyka) są składnikiem

Jaka licencja ma charakter zbiorowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, rządowym, charytatywnym na nabycie większej liczby programów firmy Microsoft na korzystnych warunkach?

Jeżeli podczas uruchamiania systemu BIOS od AWARD komputer wydał długi sygnał oraz dwa krótkie, co to oznacza?

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Na dysku konieczne jest zapisanie 100 tysięcy pojedynczych plików, każdy o wielkości 2570 bajtów. Zajętość zapisanych plików będzie minimalna na dysku o jednostce alokacji wynoszącej

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Jakie są zasadnicze różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

Ile maksymalnie urządzeń, wliczając w nie huby oraz urządzenia końcowe, może być podłączonych do interfejsu USB za pomocą magistrali utworzonej przy użyciu hubów USB?

Element na karcie graficznej, który ma za zadanie przekształcenie cyfrowego sygnału wytwarzanego przez kartę na analogowy sygnał, zdolny do wyświetlenia na monitorze to

Jakie polecenie w systemach operacyjnych Windows służy do prezentacji konfiguracji interfejsów sieciowych?

Jakiego rodzaju złącze powinna mieć płyta główna, aby umożliwić zainstalowanie karty graficznej przedstawionej na rysunku?

Jakim materiałem eksploatacyjnym dysponuje ploter solwentowy?

W systemie Windows, aby założyć nową partycję podstawową, trzeba skorzystać z przystawki