Pytanie 1

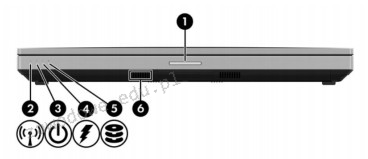

Na ilustracji zaprezentowane jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Podaj numer kontrolki, która świeci się w czasie ładowania akumulatora?

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji zaprezentowane jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Podaj numer kontrolki, która świeci się w czasie ładowania akumulatora?

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

Jak nazywa się pamięć podręczną procesora?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Do przeprowadzenia ręcznej konfiguracji interfejsu sieciowego w systemie Linux konieczne jest użycie polecenia

Jakie medium transmisyjne jest związane z adapterem przedstawionym na ilustracji?

Który z protokołów jest używany podczas rozpoczynania sesji VoIP?

Jakie polecenie w systemie Linux pozwala na zweryfikowanie adresu IP przypisanego do interfejsu sieciowego?

Narzędziem wiersza poleceń w systemie Windows, umożliwiającym zamianę tablicy partycji GPT na MBR, jest program

Które z tych określeń nie odpowiada charakterystyce kabla światłowodowego?

Która norma odnosi się do okablowania strukturalnego?

Przed rozpoczęciem instalacji sterownika dla urządzenia peryferyjnego system Windows powinien weryfikować, czy dany sterownik ma podpis

Okablowanie wertykalne w sieci strukturalnej łączy

Aby zamontować katalog udostępniony w sieci komputerowej w systemie Linux, należy wykorzystać komendę

Komputer zainstalowany w domenie Active Directory nie jest w stanie nawiązać połączenia z kontrolerem domeny, na którym znajduje się profil użytkownika. Jaki rodzaj profilu użytkownika zostanie stworzony na tym urządzeniu?

Jakie aktywne urządzenie pozwoli na nawiązanie połączenia z lokalną siecią dla 15 komputerów, drukarki sieciowej oraz rutera, wykorzystując kabel UTP?

Jeśli sieć 172.16.6.0/26 zostanie podzielona na dwie równe podsieci, to ile adresowalnych hostów będzie w każdej z nich?

Co umożliwia połączenie trunk dwóch przełączników?

Element drukujący, składający się z wielu dysz połączonych z mechanizmem drukującym, znajduje zastosowanie w drukarce

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Podaj właściwe przyporządkowanie usługi z warstwy aplikacji oraz standardowego numeru portu, na którym ta usługa działa?

Aby umożliwić połączenie między urządzeniem mobilnym a komputerem za pomocą interfejsu Bluetooth, co należy zrobić?

Wykonanie polecenia net use z:\\192.168.20.2\data /delete, spowoduje

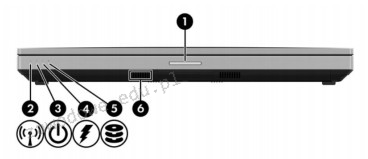

Wpis w dzienniku zdarzeń przedstawiony na ilustracji należy zakwalifikować do zdarzeń typu

W standardzie IEEE 802.3af metoda zasilania różnych urządzeń sieciowych została określona przez technologię

Tworzenie zaszyfrowanych połączeń pomiędzy hostami przez publiczną sieć Internet, wykorzystywane w rozwiązaniach VPN (Virtual Private Network), to

Jakie polecenie trzeba wydać w systemie Windows 7, aby uruchomić program Zapora systemu Windows z zabezpieczeniami zaawansowanymi bezpośrednio z wiersza poleceń?

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Aby ustalić fizyczny adres karty sieciowej, w terminalu systemu Microsoft Windows należy wpisać komendę

Jakie urządzenie powinno być użyte do połączenia komputerów w układzie gwiazdowym?

W architekturze sieci lokalnych opartej na modelu klient - serwer

Wynikiem działania funkcji logicznej XOR na dwóch liczbach binarnych \( 1010_2 \) i \( 1001_2 \) jest czterobitowa liczba

Termin określający zdolność do rozbudowy sieci to

Podczas uruchamiania komputera ukazuje się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL skutkuje

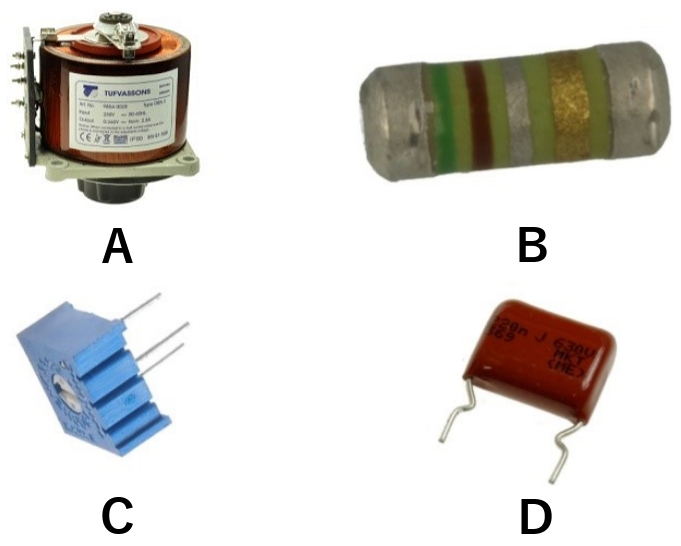

Wskaż ilustrację przedstawiającą kondensator stały?

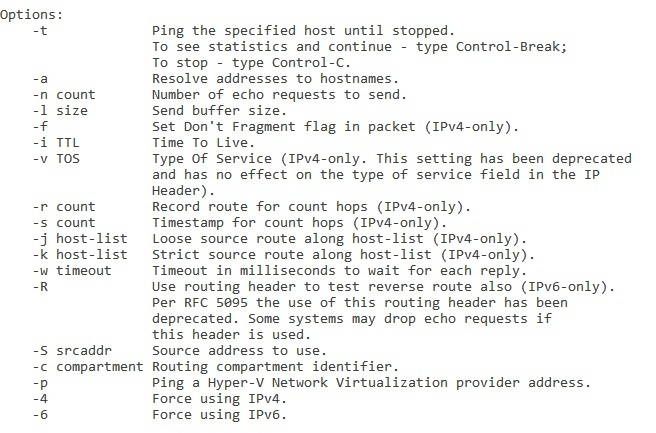

Aby wyświetlić przedstawione opcje polecenia ping, należy w wierszu polecenia systemu Windows zapisać

Jaką funkcję pełni polecenie tee w systemie Linux?

Udostępnienie drukarki sieciowej codziennie o tej samej porze należy ustawić we właściwościach drukarki, w zakładce

Jakie urządzenie służy do pomiaru wartości mocy zużywanej przez komputerowy zestaw?

Który z poniższych adresów IP należy do grupy C?