Pytanie 1

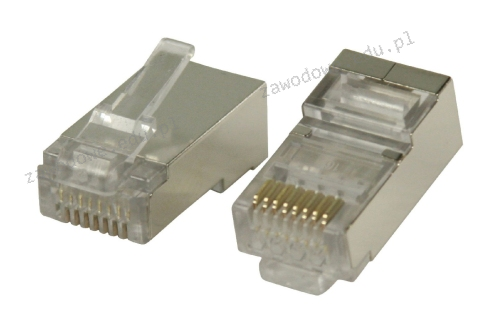

Wtyczka (modularne złącze męskie) przedstawiona na rysunku stanowi zakończenie przewodu

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Wtyczka (modularne złącze męskie) przedstawiona na rysunku stanowi zakończenie przewodu

W biurze rachunkowym znajduje się sześć komputerów w jednym pomieszczeniu, połączonych kablem UTP Cat 5e z koncentratorem. Pracownicy korzystający z tych komputerów muszą mieć możliwość drukowania bardzo dużej ilości dokumentów monochromatycznych (powyżej 5 tys. stron miesięcznie). Aby zminimalizować koszty zakupu i eksploatacji sprzętu, najlepszym wyborem będzie:

Jaka jest podstawowa funkcja protokołu SMTP?

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Jak nazywa się technika modyfikowania ramek sieciowych polegająca na oznaczaniu ich identyfikatorem sieci VLAN nadawcy według standardu IEEE 802.1Q?

Aby umożliwić transfer danych między dwiema odmiennymi sieciami, należy zastosować

Analiza tłumienia w torze transmisyjnym na kablu umożliwia ustalenie

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma możliwości uruchomienia systemu operacyjnego, ponieważ brakuje dysku twardego oraz napędów optycznych, a system operacyjny uruchamia się z lokalnej sieci. W celu odzyskania utraconej funkcjonalności należy zainstalować w komputerze

Oblicz koszt realizacji okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego, wliczając wykonanie kabli łączących dla stacji roboczych. Użyto przy tym 50 m skrętki UTP. Każdy punkt abonencki posiada 2 gniazda typu RJ45.

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

Jakie narzędzie powinno się wykorzystać w systemie Windows, aby uzyskać informacje o problemach z systemem?

Który standard Ethernet określa Gigabit Ethernet dla okablowania UTP?

Zestaw uzupełniający, składający się ze strzykawki z fluidem, igły oraz rękawiczek zabezpieczających, służy do uzupełnienia pojemników z nośnikiem drukującym w drukarkach

Jakie elementy łączy okablowanie pionowe w sieci LAN?

Sprzęt, który pozwala na komunikację pomiędzy hostami w tej samej sieci a hostami w różnych sieciach, to

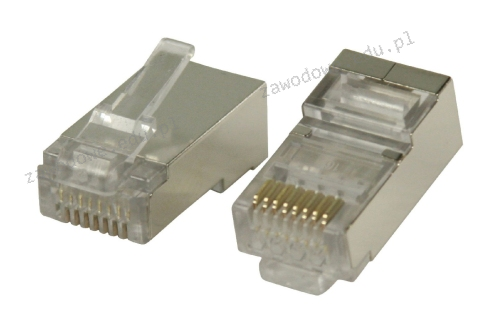

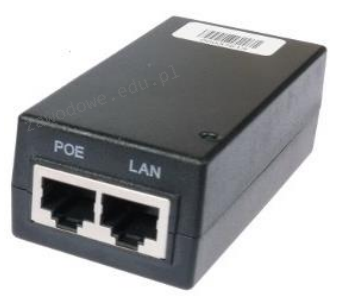

Urządzenie pokazane na ilustracji służy do

Którą kartę rozszerzeń w komputerze przedstawia to zdjęcie?

Komputer zainstalowany w domenie Active Directory nie jest w stanie nawiązać połączenia z kontrolerem domeny, na którym znajduje się profil użytkownika. Jaki rodzaj profilu użytkownika zostanie stworzony na tym urządzeniu?

Termin "10 W" w dokumentacji technicznej dotyczącej głośnika komputerowego wskazuje na jego

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Symbol umieszczony na obudowie komputera stacjonarnego wskazuje na ostrzeżenie dotyczące

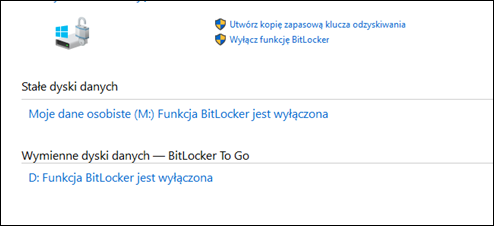

Przedstawione wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate służy do

Który kabel powinien być użyty do budowy sieci w lokalach, gdzie występują intensywne pola zakłócające?

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Uruchomienie systemu Windows w trybie debugowania pozwala na

Zanim przystąpimy do prac serwisowych dotyczących modyfikacji rejestru systemu Windows, konieczne jest wykonanie

Aby poprawić bezpieczeństwo prywatnych danych sesji na stronie internetowej, zaleca się dezaktywację w ustawieniach przeglądarki

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Polecenie chmod +x test

Zarządzaniem czasem procesora dla różnych zadań zajmuje się

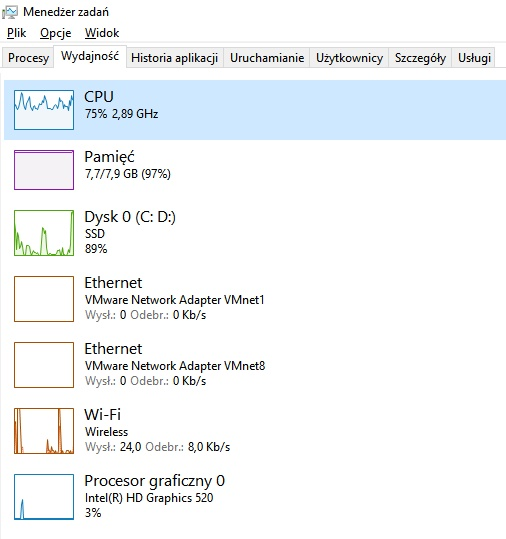

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Do efektywnego zrealizowania macierzy RAID 1 wymagane jest minimum

Na ilustracji pokazano interfejs w komputerze dedykowany do podłączenia

Który z interfejsów umożliwia transfer danych zarówno w formacie cyfrowym, jak i analogowym pomiędzy komputerem a wyświetlaczem?

Jakie składniki systemu komputerowego muszą być usuwane w wyspecjalizowanych zakładach przetwarzania ze względu na obecność niebezpiecznych substancji lub chemicznych pierwiastków?

Komunikat o błędzie KB/Interface, wyświetlany na monitorze komputera podczas BIOS POST firmy AMI, wskazuje na problem

Jakie jednostki stosuje się do wyrażania przesłuchu zbliżonego NEXT?

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

Najlepszym narzędziem służącym do podgrzania znajdującego się na karcie graficznej elementu SMD, który ma zostać usunięty, jest

Która z poniższych czynności NIE przyczynia się do personalizacji systemu operacyjnego Windows?

Jakiego parametru w poleceniu ping należy użyć, aby uzyskać rezultat pokazany na zrzucie ekranu?