Pytanie 1

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Po przeprowadzeniu eksportu klucza HKCR zostanie utworzona kopia rejestru, zawierająca dane dotyczące konfiguracji

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Kiedy użytkownik systemu Windows wybiera opcję przywrócenia do określonego punktu, które pliki utworzone po tym punkcie nie będą podlegać zmianom w wyniku tej operacji?

Aby osiągnąć przepustowość 4 GB/s w obydwie strony, konieczne jest zainstalowanie w komputerze karty graficznej używającej interfejsu

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

W sieciach opartych na standardzie, jaką metodę dostępu do medium wykorzystuje CSMA/CA?

Klawiatura QWERTY, która pozwala na wprowadzanie znaków typowych dla języka polskiego, nazywana jest także klawiaturą

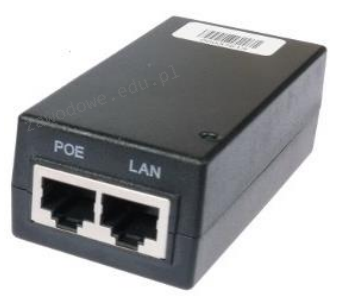

Urządzenie pokazane na ilustracji służy do

Który z wymienionych protokołów umożliwia nawiązanie szyfrowanego połączenia z witryną internetową?

Sieć, w której funkcjonuje komputer o adresie IP 192.168.100.50/28, została podzielona na 4 podsieci. Jakie są poprawne adresy tych podsieci?

Jakie czynności należy wykonać, aby oczyścić zatkane dysze kartridża w drukarce atramentowej?

Jakie są nazwy licencji, które umożliwiają korzystanie z programu w pełnym zakresie, ale ograniczają liczbę uruchomień do określonej, niewielkiej ilości od momentu instalacji?

Aby skanera działał prawidłowo, należy

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

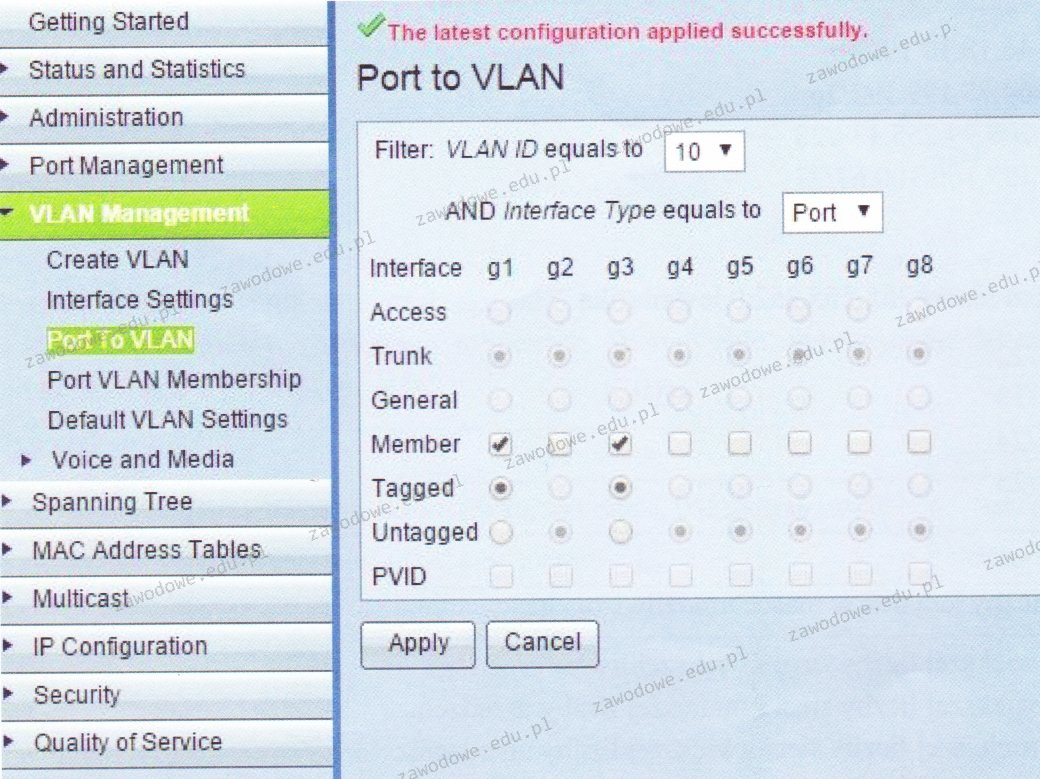

Na ilustracji przedstawiona jest konfiguracja

Przedstawiona na diagramie strategia zapisu kopii zapasowych na nośnikach nosi nazwę

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Kod BREAK interpretowany przez system elektroniczny klawiatury wskazuje na

Jakie oprogramowanie służy do sprawdzania sterowników w systemie Windows?

Aby zmienić port drukarki zainstalowanej w systemie Windows, która funkcja powinna zostać użyta?

Aby zapewnić maksymalną ochronę danych przy użyciu dokładnie 3 dysków, powinny one być przechowywane w macierzy RAID

W przypadku sieci strukturalnej rekomendowane jest zainstalowanie jednego punktu abonenckiego na obszarze wynoszącym

Jaką liczbę dziesiętną reprezentuje liczba 11110101U2)?

Awaria klawiatury może być spowodowana przez uszkodzenie

Dobrze zaplanowana sieć komputerowa powinna pozwalać na rozbudowę, co oznacza, że musi charakteryzować się

Znak przedstawiony na ilustracji, zgodny z normą Energy Star, wskazuje na urządzenie

Router Wi-Fi działający w technologii 802.11n umożliwia osiągnięcie maksymalnej prędkości przesyłu danych

Który z protokołów jest stosowany w procesie rozpoczęcia sesji VoIP?

Program testujący wydajność sprzętu komputerowego to

Jaką maksymalną długość może mieć kabel miedziany UTP kategorii 5e łączący bezpośrednio dwa urządzenia w sieci, według standardu Fast Ethernet 100Base-TX?

System S.M.A.R.T jest stworzony do kontrolowania działania i identyfikacji usterek

Jak skonfigurować dziennik w systemie Windows Server, aby rejestrować zarówno udane, jak i nieudane próby logowania użytkowników oraz działania na zasobach dyskowych?

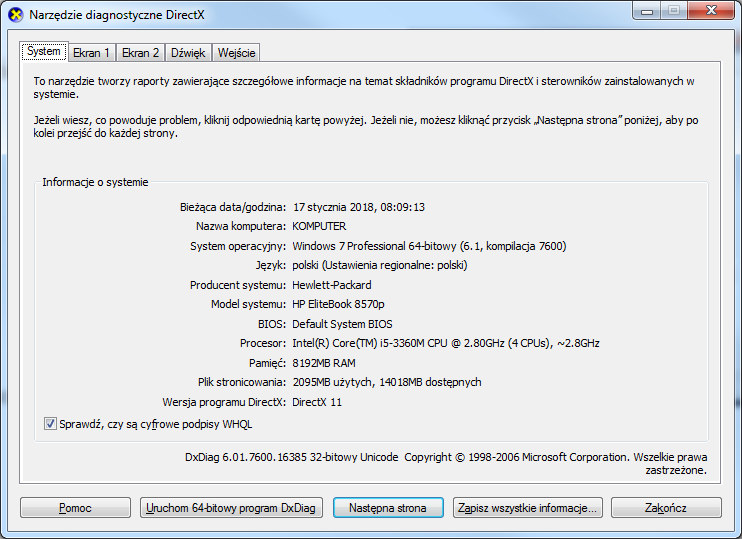

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Jakie protokoły przesyłają regularne kopie tablic routingu do sąsiednich ruterów, nie zawierając pełnych informacji o odległych urządzeniach routujących?

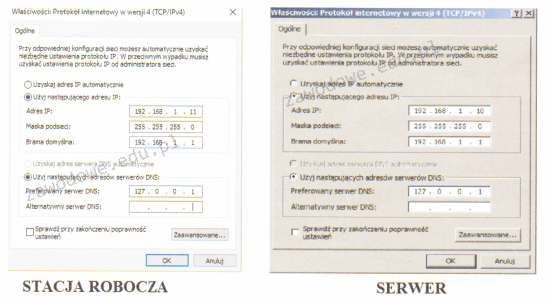

Na rysunku widać ustawienia protokołu TCP/IP serwera oraz komputera roboczego. Na serwerze działa rola serwera DNS. Wykonanie polecenia ping www.cke.edu.pl na serwerze zwraca wynik pozytywny, natomiast na stacji roboczej wynik jest negatywny. Co należy zmienić, aby usługa DNS na stacji pracowała poprawnie?

Urządzeniem, które chroni przed różnorodnymi atakami sieciowymi oraz może wykonywać dodatkowe zadania, takie jak szyfrowanie przesyłanych informacji lub automatyczne informowanie administratora o próbie włamania, jest

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

Jakie parametry otrzyma interfejs sieciowy eth0 po wykonaniu poniższych poleceń w systemie Linux?

Który z symboli wskazuje na zastrzeżenie praw autorskich?

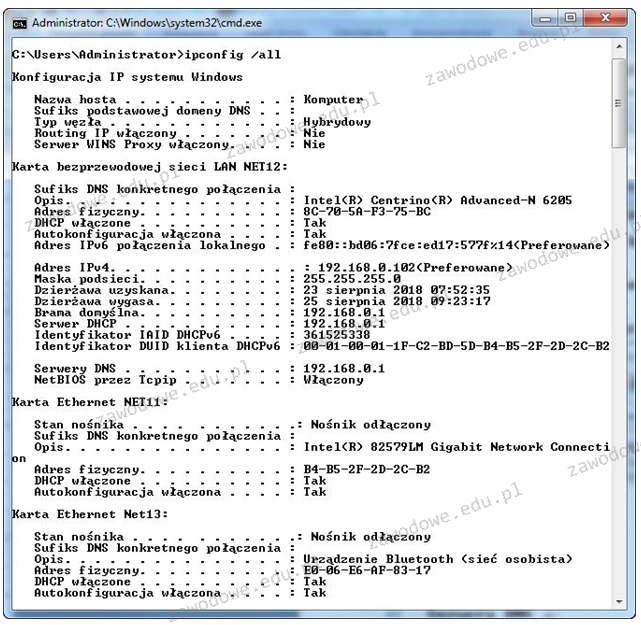

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych na komputerze, można zauważyć, że