Pytanie 1

Aby zapisać wynik dzielenia dowolnych dwóch liczb różnych od zera, należy użyć zmiennej typu

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Aby zapisać wynik dzielenia dowolnych dwóch liczb różnych od zera, należy użyć zmiennej typu

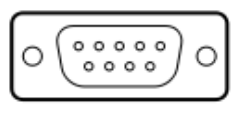

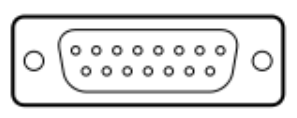

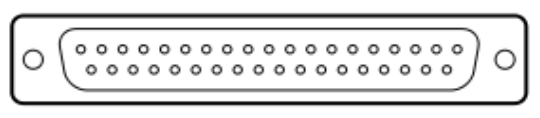

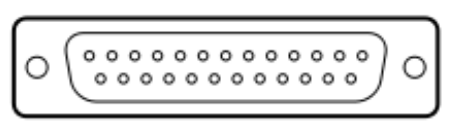

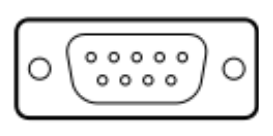

Do którego interfejsu (komunikacja z komputerem odbywa się poprzez port RS 232) należy podłączyć cykloergometr przeznaczony do współpracy z systemem do badań wysiłkowych?

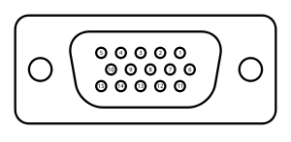

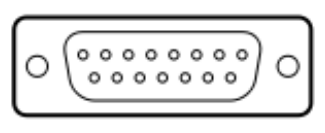

Zgodnie z przedstawionym opisem, gniazdo interfejsu służące do podłączenia audiometru ze stanowiskiem komputerowym przedstawione jest na rysunku

| Opis: |

| − 125 Hz ÷ 8.000 Hz − -10 dB do 120 dB HL na wyjściu − połączenie z komputerem PC – interfejs RS232 − połączenie z drukarką laserową − połączenie z drukarką atramentową |

Z przedstawionej dokumentacji pamięci wynika że jest ona przeznaczona do

rodzaj pamięci : SO-DIMM standard : DDR3-1333 (PC3-10600) pojemność pojedynczego modułu : 4 GB |

Pamięć statyczna RAM ma zastosowanie jako pamięć

Jakie jest przeznaczenie drukarki, której dotyczy zamieszczony fragment specyfikacji?

| Głowica drukująca | 24-igłowa |

| Średnica przewodu | 0,2 mm |

| Kierunek druku | Dwukierunkowe/bezkierunkowe drukowanie |

| Rozdzielczość grafiki | Maks. 360 (wys.) x 360 (szer.) dpi |

| Szybkość drukowania | High Speed Draft: 607 znaków/s, tryb Utility: 485 znaków/s, tryb Near Letter Quality: 245 znaków/s, Letter Quality: 165 znaków/s |

| Gęstość przesunięć wierszy | 4,23 mm (1/6"), 3,18 mm (1/8"), n x 0,42 mm (m/60") (m=0-127), n x 0,14 mm (n/180") (n=0-255), n x 0,12 mm (n/216") (n=0-255), n x 0,07 mm (n/360") (n=0-255) |

| Szybkość podajnika | 10 cali na sekundę |

| Pobieranie papieru | Ręczne (góra), traktor pchający (góra), traktor pchający (tył), traktor pchający (dół), podajnik pojedynczych arkuszy (tył) |

| Gęstość znaków | High Speed Draft: 10,0 zn./cal 18,0 zn./cal Jakość użytkowa: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20 zn./cal Tryb Near Letter Quality: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20,0 zn./cal Tryb Letter Quality: 10 zn./cal 12 zn./cal 15 zn./cal 17,1 zn./cal 20 zn./cal, proporcjonalnie |

| Szerokość druku | 136 zn./linia przy ANK 10 zn./cal |

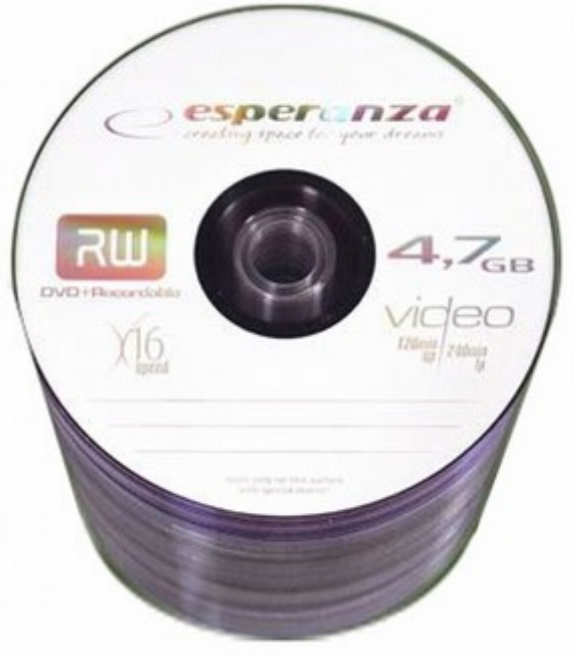

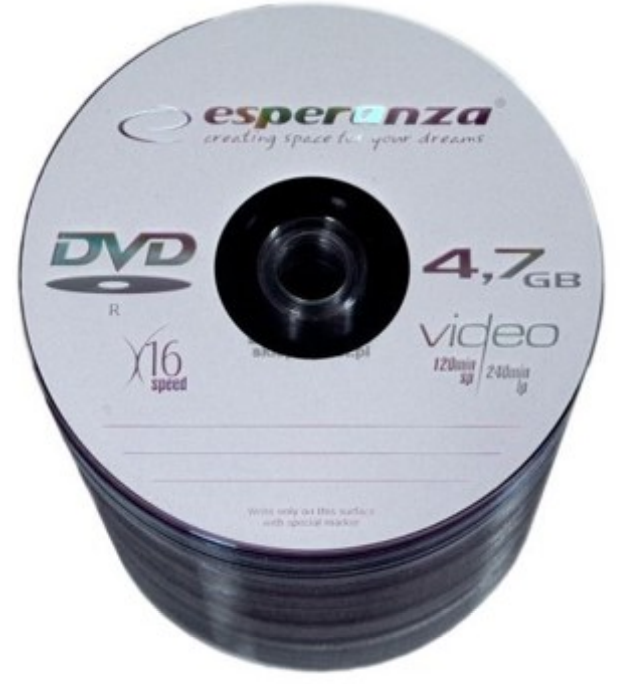

Który z nośników danych umożliwia wielokrotny zapis i ma największą pojemność?

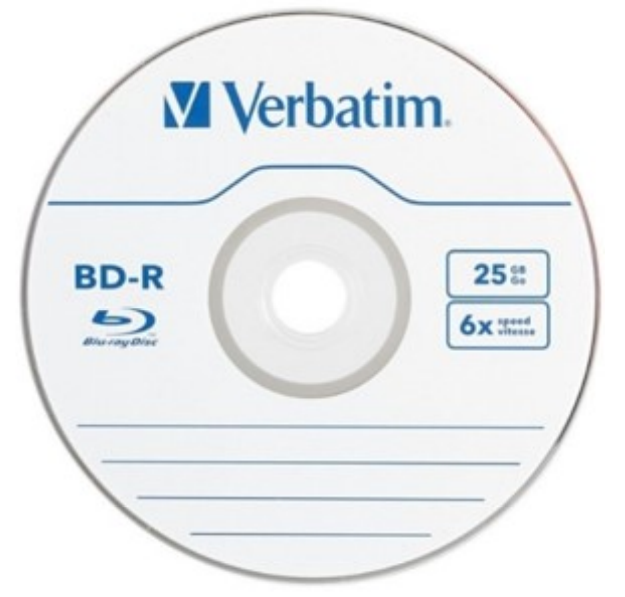

Niezbędna jest archiwizacja danych na płycie Blue-Ray jednokrotnego zapisu. Płyta taka ma oznaczenie

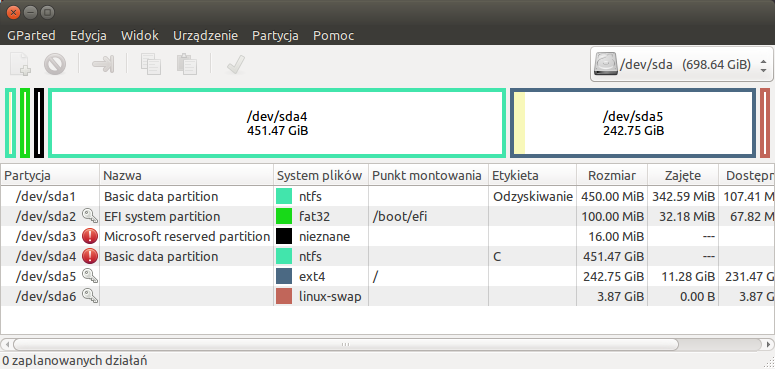

Ile dysków i z jakim interfejsem zostało wykazanych na zrzucie programu GParted?

W dokumentacji skanera zapisano „rozdzielczość optyczna 600 x 600 [dpi]”. Skrót dpi określa liczbę punktów

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

Wymianą informacji pomiędzy układami znajdującymi się na płycie głównej komputera steruje

W dokumentacji Medycznego Systemu Informatycznego zapisano, że „przed użyciem programów instalacyjnych należy się upewnić, że niektóre porty w środowisku są dostępne do użycia z instalowanym oprogramowaniem pośrednim.” W celu sprawdzenia dostępności portu należy użyć programu narzędziowego

W celu podłączenia monitora do systemu wizualizacji obrazów wymagany jest interfejs Display Port. Ile takich interfejsów posiada karta graficzna przedstawiona na rysunku?

Z przedstawionego zrzutu wynika, że na dyskach zastosowano partycjonowanie

Który interfejs nie umożliwia podłączenia urządzeń peryferyjnych w standardzie „plug and play”?

Wynikiem działania funkcji F(n) będzie

funkcja F(n) jeżeli n>1 F(n)=3*F(n-1) w przeciwnym wypadku F(n)=3 |

W celu określenia trasy, przez jakie routery przechodzi sygnał pomiędzy komputerami w sieci szpitalnej, można zastosować polecenie

Które działanie nie odnosi się do podstawowej funkcji komputera?

Które polecenie w systemie Windows tworzy folder Dane?

W systemie komputerowym przeznaczonym do pracy z dużymi plikami graficznymi należy zwiększyć ilość

W celu połączenia komputera z systemem do badań wysiłkowych komunikującym się za pomocą interfejsu opisanego przedstawionym symbolem, należy w ustawieniach systemu włączyć

Która usługa serwera przydziela adresy IP komputerom w sieci LAN?

W jakim celu stosuje się podział użytkowników na grupy w systemie operacyjnym?

Podczas tworzenia tabeli w bazie danych klucz podstawowy określa się jako

Pojedynczy zapis w medycznej bazie danych, zawierający informację na temat jednego pacjenta, nazywa się

| id | imię | nazwisko | adres |

|---|---|---|---|

| 2354 | Konrad | Marek | ul. Kwiatowa15 Krzywodrogi |

| 2355 | Jakub | Warek | ul. Leśna 23 Krzywodrogi |

| 2356 | Krzysztof | Jurek | ul. Polna 14 Krzywodrogi |

Technologia dual channel dotyczy pracy dwóch takich samych

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

System informatyczny wymaga zabezpieczenia danych poprzez tworzenie kopii zapasowych. Dysponując 2 dyskami, można je połączyć w

Który system plików zapewnia największe bezpieczeństwo danych w systemie Windows?

Aby system komputerowy współpracujący z ultrasonografem mógł nagrywać na jednej płycie DVD dane z kolejnych, wykonywanych na bieżąco badań, musi być wyposażony w nagrywanie

Który system bazodanowy uniemożliwia bezpłatne zastosowanie komercyjne?

Które polecenie SQL nie modyfikuje tabeli bazy danych?

Które polecenie SQL pozwoli na utworzenie tabeli pacjentów w bazie przychodnia?

Która konsola MMC pozwala na zmianę ważności hasła i ustawienie blokady hasła po określonej liczbie logowań?

W celu zmiany hasła użytkownika w systemie Linux należy użyć polecenia

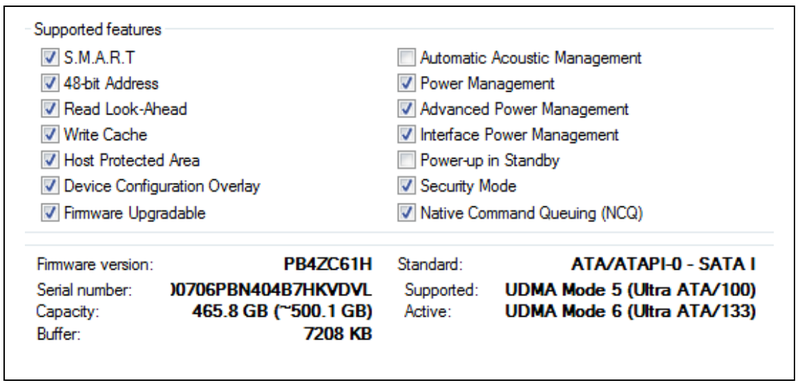

Przedstawiony zrzut ekranu prezentuje parametry

Który system informatyki medycznej umożliwia archiwizację obrazów?

Proces, w którym w bazie danych są usuwane nadmiarowe dane, jest określany jako

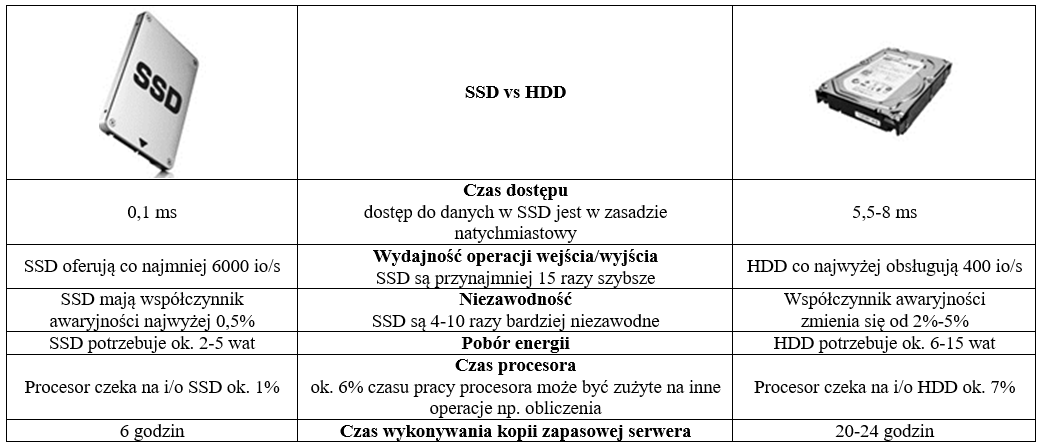

W tabeli zestawiono parametry pamięci półprzewodnikowej i pamięci magnetycznej. Zastosowanie którego rodzaju pamięci umożliwi szybszą pracę komputera?