Pytanie 1

Jak dużo bitów minimum będzie potrzebnych w systemie binarnym do reprezentacji liczby heksadecymalnej 110h?

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Jak dużo bitów minimum będzie potrzebnych w systemie binarnym do reprezentacji liczby heksadecymalnej 110h?

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

Jakie medium transmisyjne nosi nazwę 100BaseTX i jaka jest maksymalna prędkość danych, która może być w nim osiągnięta?

Włączenie systemu Windows w trybie diagnostycznym umożliwia

EN IEC 60276:2019 to przykład oznaczenia normy

Zasilacz UPS o mocy nominalnej 480 W nie powinien być używany do zasilania

Jaką fizyczną topologię sieci komputerowej przedstawiono na załączonym rysunku?

Przedstawiony skaner należy podłączyć do komputera przy użyciu złącza

Jaką czynność można wykonać podczas konfiguracji przełącznika CISCO w interfejsie CLI, bez przechodzenia do trybu uprzywilejowanego, na poziomie dostępu widocznym w powyższej ramce?

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Protokół transportowy bezpołączeniowy to

Co oznacza skrót 'RAID' w kontekście systemów komputerowych?

Przynależność komputera do konkretnej wirtualnej sieci nie może być ustalona na podstawie

Monitor CRT jest podłączany do karty graficznej przy użyciu złącza

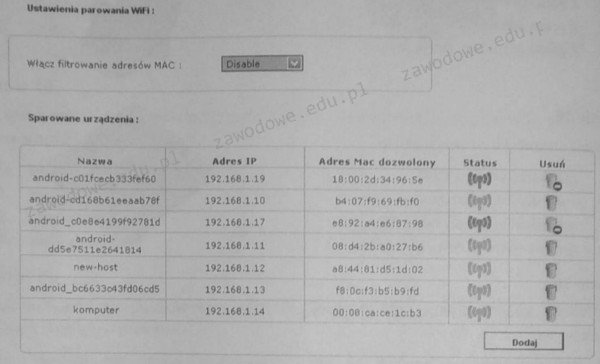

Schemat ilustruje ustawienia urządzenia WiFi. Wskaż, które z poniższych stwierdzeń na temat tej konfiguracji jest prawdziwe?

Jakie składniki systemu komputerowego wymagają utylizacji w wyspecjalizowanych zakładach przetwarzania z powodu obecności niebezpiecznych substancji lub pierwiastków chemicznych?

Który z zapisów stanowi pełną formę maski z prefiksem 25?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Ile minimalnie pamięci RAM powinien mieć komputer, aby możliwe było uruchomienie 32-bitowego systemu operacyjnego Windows 7 w trybie graficznym?

Rzeczywistą kalibrację sprzętową monitora można wykonać

Jakiego systemu operacyjnego powinien nabyć użytkownik, aby zmodernizowany komputer miał możliwość uruchamiania gier obsługujących DirectX12?

Jaką pojemność ma dwuwarstwowa płyta Blu-ray?

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

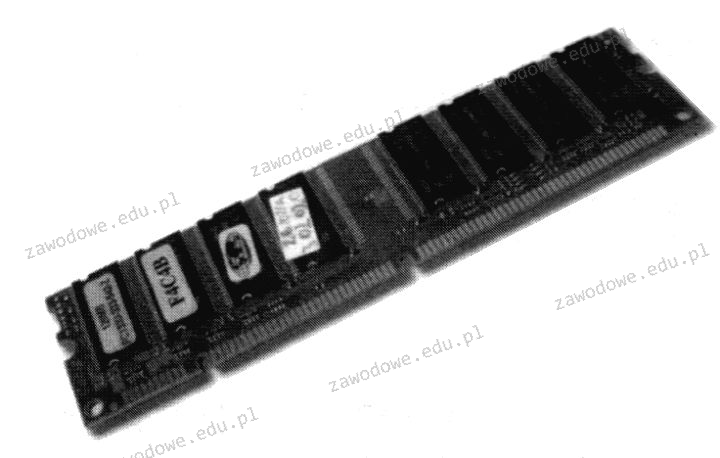

Na fotografii ukazana jest pamięć o 168 stykach

Protokół transportowy bez połączenia w modelu ISO/OSI to

Jaki rezultat uzyskamy po wykonaniu odejmowania dwóch liczb heksadecymalnych 60A (h) - 3BF (h)?

Komenda "mmc" w systemach Windows 2000 oraz Windows XP uruchamia aplikację do tworzenia, zapisywania i otwierania

Symbol graficzny przedstawiony na ilustracji oznacza jaką bramkę logiczną?

Urządzenie przedstawione na rysunku

Impulsator pozwala na testowanie uszkodzonych systemów logicznych w komputerze, między innymi poprzez

Które cechy ma licencja bezpłatnego oprogramowania zwana freemium?

Która z kart graficznych nie będzie kompatybilna z monitorem, posiadającym złącza pokazane na ilustracji (zakładając, że nie można użyć adaptera do jego podłączenia)?

Jakiego rodzaju adresację stosuje protokół IPv6?

Jakie będzie całkowite koszty materiałów potrzebnych do zbudowania sieci lokalnej dla 6 komputerów, jeśli do realizacji sieci wymagane są 100 m kabla UTP kat. 5e oraz 20 m kanału instalacyjnego? Ceny komponentów sieci zostały przedstawione w tabeli

| Elementy sieci | j.m. | cena brutto |

|---|---|---|

| Kabel UTP kat. 5e | m | 1,00 zł |

| Kanał instalacyjny | m | 8,00 zł |

| Gniazdo komputerowe | szt. | 5,00 zł |

Ile maksymalnie hostów można przydzielić w sieci o masce 255.255.255.192?

Przesyłanie informacji przy użyciu fal radiowych w pasmie ISM odbywa się w standardzie

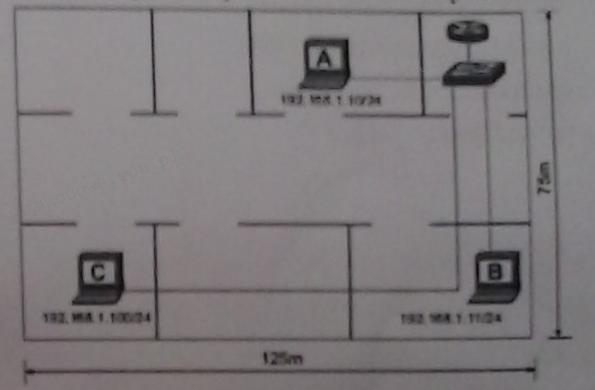

Na ilustracji przedstawiono sieć lokalną zbudowaną na kablach kat. 6. Stacja robocza "C" nie ma możliwości komunikacji z siecią. Jaki problem w warstwie fizycznej może powodować brak połączenia?

Który z poniższych mechanizmów zapewni najwyższy stopień ochrony sieci bezprzewodowych w standardzie 802.11n?

Polecenie do zmiany adresu MAC karty sieciowej w systemie Linux to

Jakie znaczenie ma parametr NVP (Nominal Velocity of Propagation) podczas pomiarów okablowania strukturalnego?