Pytanie 1

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

Aby skaner działał prawidłowo, co należy zrobić?

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

W wyniku polecenia net accounts /MINPWLEN:11 w systemie Windows, wartość 11 będzie przypisana do

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

W systemie Linux polecenie chmod służy do

Administrator systemu Windows zauważył znaczne spowolnienie działania komputera spowodowane niską ilością dostępnej pamięci RAM. W celu zidentyfikowania programu, który zużywa jej najwięcej, powinien skorzystać z narzędzia

Cena wydruku jednej strony tekstu wynosi 95 gr, a koszt wykonania jednej płyty CD to 1,54 zł. Jakie wydatki poniesie firma, tworząc płytę z prezentacjami oraz poradnik liczący 120 stron?

Oblicz całkowity koszt za realizację poniższych czynności serwisowych, przy założeniu, że stawka za jedną roboczogodzinę wynosi 120,00 zł netto, a podatek VAT wynosi 23%.

| LP | Zrealizowane czynności serwisowe | Ilość roboczogodzin |

|---|---|---|

| 1. | Diagnozowanie usterki | 0,2 |

| 2. | Wymiana zasilacza | 0,5 |

| 3. | Przygotowanie drukarki do eksploatacji | 0,6 |

| 4. | Konserwacja urządzenia drukującego | 1,0 |

| 5. | Sprawdzanie po zakończeniu naprawy | 0,2 |

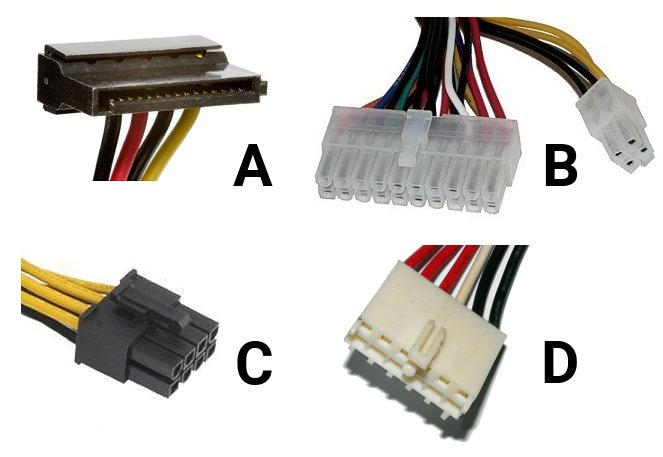

Wskaż rodzaj wtyczki zasilającej, którą należy podłączyć do napędu optycznego podczas montażu komputera.

Na wyświetlaczu drukarki pojawił się komunikat „PAPER JAM”. Aby usunąć usterkę, należy w pierwszej kolejności

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Układy sekwencyjne stworzone z grupy przerzutników, najczęściej synchronicznych typu D, które mają na celu przechowywanie danych, to

Które narzędzie systemu Windows służy do zdefiniowania polityki haseł dostępowych do kont użytkowników?

Jaką długość w bitach ma adres logiczny IPv6?

Prawo majątkowe przysługujące twórcy programu komputerowego

Oprogramowanie, które jest przypisane do konkretnego komputera lub jego komponentu i nie pozwala na reinstalację na nowszym sprzęcie zakupionym przez tego samego użytkownika, nosi nazwę

Niskopoziomowe formatowanie dysku IDE HDD polega na

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 zapisany jest w formacie

W hierarchicznym modelu sieci komputery użytkowników stanowią część warstwy

Który z poniższych systemów operacyjnych nie jest wspierany przez system plików ext4?

AppLocker to funkcjonalność dostępna w systemach Windows Server, która umożliwia

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Aby zmagazynować 10 GB danych na pojedynczej płycie DVD, jaki typ nośnika powinien być wykorzystany?

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

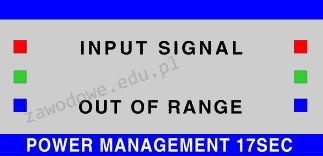

Gdy sprawny monitor zostaje podłączony do innego komputera, na ekranie ukazuje się komunikat widoczny na rysunku. Co powoduje pojawienie się tego komunikatu?

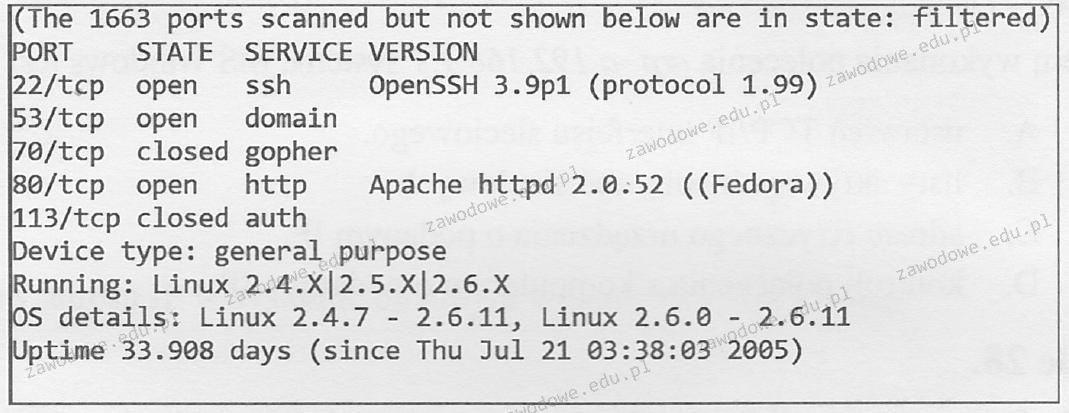

Jaki program został wykorzystany w systemie Linux do szybkiego skanowania sieci?

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Który z protokołów służy do synchronizacji czasu?

Jak wiele urządzeń może być podłączonych do interfejsu IEEE1394?

Aby podłączyć 6 komputerów do sieci przy użyciu światłowodu, potrzebny jest kabel z co najmniej taką ilością włókien:

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Drukarka została zainstalowana w systemie z rodziny Windows. Aby skonfigurować m.in. domyślną orientację druku, ilość stron na arkusz oraz kolory, w trakcie jej ustawiania należy skorzystać z opcji

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

Który adres IP jest powiązany z nazwą mnemoniczna localhost?

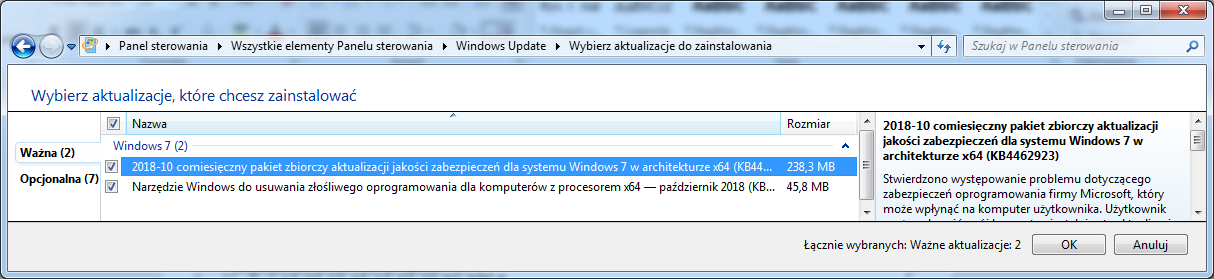

Głównie które aktualizacje zostaną zainstalowane po kliknięciu na przycisk OK prezentowany na zrzucie ekranu?

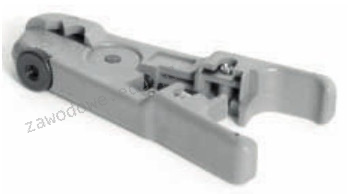

Na ilustracji zaprezentowane jest urządzenie do

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.