Pytanie 1

Parametr dysku twardego określany skrótem MTBF oznacza średni czas

Wynik: 38/40 punktów (95,0%)

Wymagane minimum: 20 punktów (50%)

Parametr dysku twardego określany skrótem MTBF oznacza średni czas

Z przedstawionego zrzutu wynika, że na dyskach zastosowano partycjonowanie

Jaki wpływ na organizm ludzki ma krioterapia?

Pod wpływem przegrzania organizmu dochodzi do

System informatyczny wymaga zabezpieczenia danych poprzez tworzenie kopii zapasowych. Dysponując 2 dyskami, można je połączyć w

Aby system komputerowy współpracujący z ultrasonografem mógł nagrywać na jednej płycie DVD dane z kolejnych, wykonywanych na bieżąco badań, musi być wyposażony w nagrywanie

W zabiegu jonoforezy leki są transportowane przez skórę do głębiej położonych warstw poprzez zastosowanie

Operacja warunkowa w większości języków programowania wysokiego poziomu zaczyna się słowem

Elementem sieci komputerowej w topologii gwiazdy, pozwalającym przyłączyć wiele urządzeń sieciowych, jest

Pod wpływem zwiększenia natężenia promieniowania widzialnego (bodźca świetlnego) źrenica zdrowego oka ludzkiego

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

Nie uzyskamy pomocy na temat polecenia „net” w wierszu poleceń systemu Windows wpisując

Która część narządu wzroku rejestruje światło widzialne?

Przedstawiony na rysunku kolimator stanowi część

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Technologia dual channel dotyczy pracy dwóch takich samych

Rejestr rozkazów procesora przechowuje

Wymieniając bezpiecznik w medycznym module zasilającym, wymagającym zastosowania wkładki topikowej zwłocznej, należy użyć elementu oznaczonego symbolem literowym

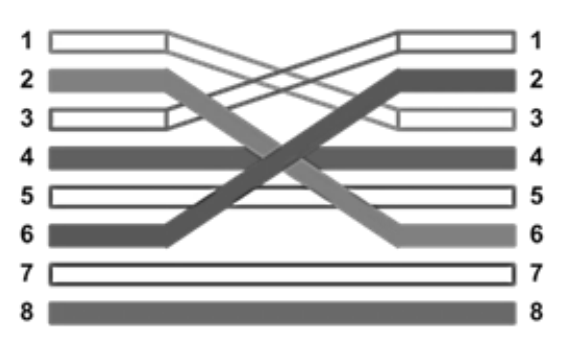

Przedstawiony na rysunku kabel krosowany jest wykorzystany do połączenia

W systemie bazodanowym wymagane jest dodatkowe sprzętowe zabezpieczenie danych przed ich utratą. Która macierz dyskowa pozwala uodpornić się na utratę danych w przypadku awarii wszystkich dysków poza jednym?

Aby uruchomić w systemie linux program nazwa.py, należy wpisać

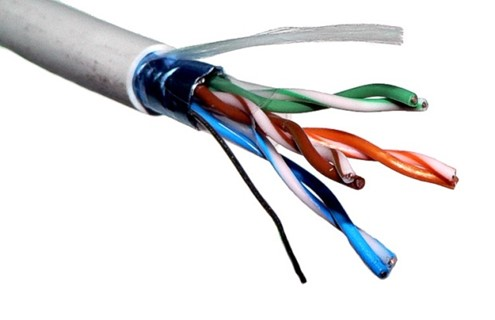

Który typ przewodu przedstawiono na rysunku?

Jak nazywa się terapia stosowana w przypadku niewydolności nerek, polegająca na oczyszczaniu krwi ze zbędnych składników przemiany materii?

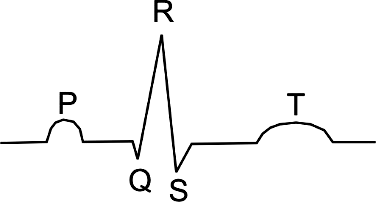

Ile elektrod wykorzystuje się podczas wykonywania standardowego badania EKG przy pomocy 12 odprowadzeń?

Na rysunku przedstawiono kartę rozszerzeń umożliwiającą

Pojęcie „Architektura Harvardska” odnosi się do

Na rysunku przedstawiono przyrząd, którym przeprowadza się test i kontrolę

Który rozdzielacz sygnału należy zastosować w celu wykorzystania jednego przewodu U/UTP5e do podłączenia dwóch urządzeń do sieci LAN?

W opisanym programie zostaną wykonane 4

for (i=0;i<=3;i++) suma=suma+i; |

Które polecenia są charakterystyczne dla instrukcji iteracyjnych?

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

W celu podłączenia monitora do systemu wizualizacji obrazów wymagany jest interfejs Display Port. Ile takich interfejsów posiada karta graficzna przedstawiona na rysunku?

Którego nośnika pamięci należy użyć w komputerze, aby zapewnić najszybsze ładowanie się systemu operacyjnego podczas jego uruchamiania?

W sygnale elektrokardiograficznym za repolaryzację mięśnia komór odpowiada załamek

Konserwacja oprogramowania nie obejmuje

Rysunek przedstawia raport sprawdzający połączenie pomiędzy stacjami monitorującymi informatycznego systemu medycznego. Którego polecenia należy użyć aby go uzyskać?

Materiałem eksploatacyjnym w drukarce laserowej jest

Który system plików zapewnia największe bezpieczeństwo danych w systemie Windows?

Które działanie nie odnosi się do podstawowej funkcji komputera?

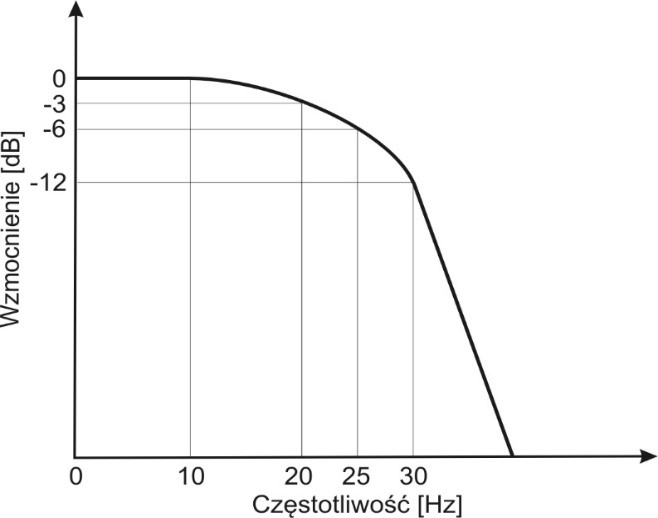

Przedstawiony fragment dokumentacji dotyczy

Częstotliwość: 2.0-10.0MHz; Tryb obrazowania: B, B/B, B/M, M, 4B; Dynamiczne 4-stopniowe ogniskowanie; |