Pytanie 1

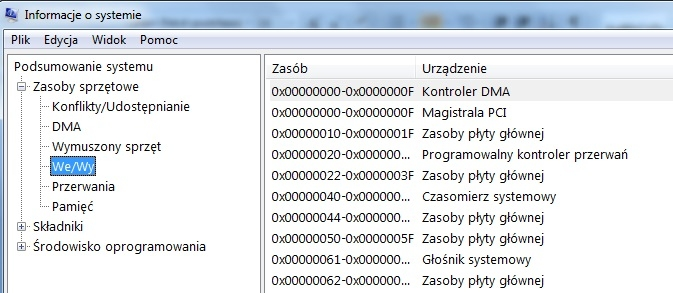

W którym systemie liczbowym zapisano zakresy We/Wy przedstawione na ilustracji?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

W którym systemie liczbowym zapisano zakresy We/Wy przedstawione na ilustracji?

W systemie DNS, aby powiązać nazwę hosta z adresem IPv4, konieczne jest stworzenie rekordu

Jednym z czynników, dla których zapis na dysku SSD jest szybszy niż na dysku HDD, jest

Aby stworzyć partycję w systemie Windows, należy skorzystać z narzędzia

Jakie rodzaje partycji mogą występować w systemie Windows?

Jest to najnowsza edycja klienta wieloplatformowego, docenianego przez użytkowników na całym świecie, serwera wirtualnej sieci prywatnej, umożliwiającego nawiązanie połączenia między hostem a komputerem lokalnym, obsługującego uwierzytelnianie z wykorzystaniem kluczy, certyfikatów, nazwy użytkownika oraz hasła, a także, w wersji dla Windows, dodatkowych zakładek. Który z programów został wcześniej opisany?

Jak określamy atak na sieć komputerową, który polega na łapaniu pakietów przesyłanych w sieci?

Podczas zamykania systemu operacyjnego na ekranie pojawił się błąd, tak zwany bluescreen, 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN – niepowodzenie zamykania systemu, spowodowane brakiem pamięci. Błąd ten może wskazywać na

Jakie ustawienie należy wprowadzić przy konfiguracji serwera DHCP?

Oblicz całkowity koszt kabla UTP Cat 6, który będzie użyty do połączenia 5 punktów abonenckich z punktem dystrybucji, mając na uwadze, że średnia odległość pomiędzy każdym punktem abonenckim a punktem dystrybucji wynosi 8 m oraz że cena za 1 m kabla wynosi 1 zł. W obliczeniach uwzględnij zapas 2 m kabla na każdy punkt abonencki.

Jaki akronim oznacza program do tworzenia graficznych wykresów ruchu, który odbywa się na interfejsach urządzeń sieciowych?

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?

Po przeprowadzeniu eksportu klucza HKCR zostanie utworzona kopia rejestru, zawierająca dane dotyczące konfiguracji

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Zjawisko przesłuchu w sieciach komputerowych polega na

Na podstawie tabeli wskaż, który model przełącznika Cisco Catalyst, zawiera 48 portów i możliwość doposażenia o wkładki światłowodowe.

| Configurations of Cisco Catalyst 2960 Series Switches with LAN Base Software | ||

|---|---|---|

| Cisco Catalyst 2960 Switch Model | Description | Uplinks |

| 1 Gigabit Uplinks with 10/100 Ethernet Connectivity | ||

| Cisco Catalyst 2960-48PST-L | 48 Ethernet 10/100 PoE ports | 2 One Gigabit Ethernet SFP ports and 2 fixed Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24PC-L | 24 Ethernet 10/100 PoE ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24LT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24TC-L | 24 Ethernet 10/100 ports | 2 dual-purpose ports |

| Cisco Catalyst 2960-48TC-L | 48 Ethernet 10/100 ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24TT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-48TT-L | 48 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

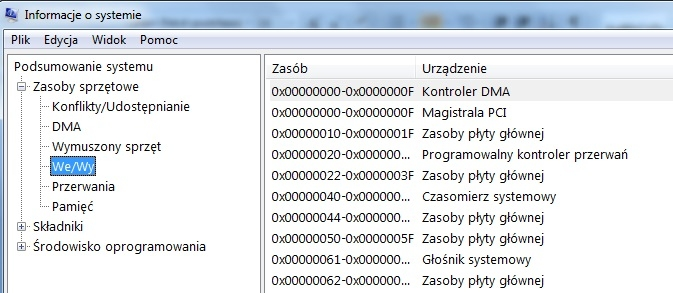

Jaki jest rezultat realizacji którego polecenia w systemie operacyjnym z rodziny Windows, przedstawiony na poniższym rysunku?

Z jaką minimalną efektywną częstotliwością taktowania mogą działać pamięci DDR2?

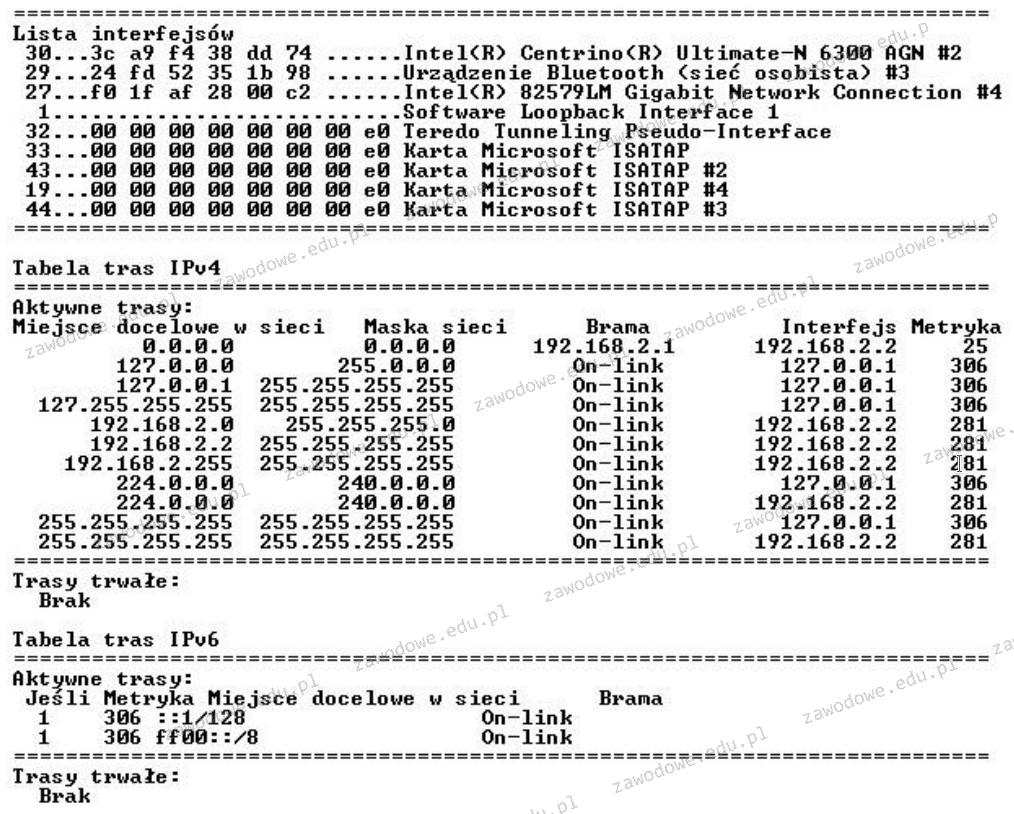

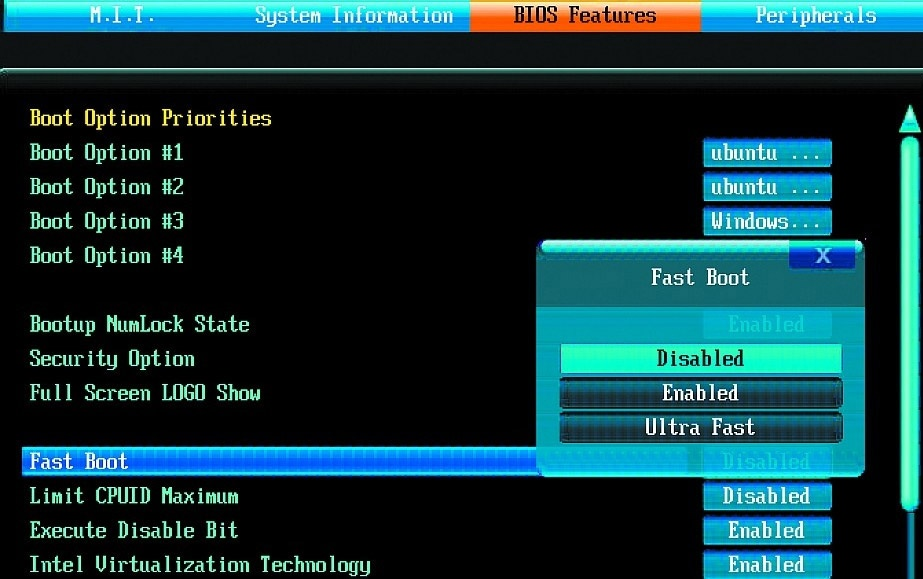

Co spowoduje zmiana opcji Fast Boot na wartość Enabledw konfiguracji BIOS przedstawionej na ilustracji?

W systemie Windows za pomocą komendy assoc można

Aby skonfigurować usługę rutingu w systemie Windows Serwer, należy zainstalować rolę

Jakie oprogramowanie służy do sprawdzania sterowników w systemie Windows?

Aby podłączyć 6 komputerów do sieci przy użyciu światłowodu, potrzebny jest kabel z co najmniej taką ilością włókien:

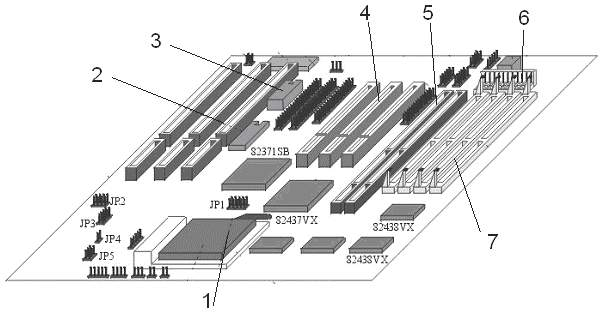

Na schemacie płyty głównej port PCI oznaczony jest numerem

Jakie polecenie systemu Windows przedstawione jest na ilustracji?

Adres fizyczny Nazwa transportu

===========================================================

00-23-AE-09-47-CF Nośnik rozłączony

00-23-4D-CB-B4-BB Brak

00-23-4D-CB-B4-BB Nośnik rozłączonyJaki jest powód sytuacji widocznej na przedstawionym zrzucie ekranu, mając na uwadze adres IP serwera, na którym umieszczona jest domena www.wp.pl, wynoszący 212.77.98.9?

C:\>ping 212.77.98.9

Pinging 212.77.98.9 with 32 bytes of data:

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=30ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Ping statistics for 212.77.98.9:

Packets: Sent = 4, Received = 4, Lost = 0 (0% loss),

Approximate round trip times in milli-seconds:

Minimum = 29ms, Maximum = 30ms, Average = 29ms

C:\>ping www.wp.pl

Ping request could not find host www.wp.pl. Please check the name and try again.Który sterownik drukarki jest niezależny od urządzenia i systemu operacyjnego oraz jest standardem w urządzeniach poligraficznych?

Aby jednocześnie zmienić tło pulpitu, kolory okien, dźwięki oraz wygaszacz ekranu na komputerze z systemem Windows, należy użyć

Jakie urządzenie należy zastosować do pomiaru mocy zużywanej przez komputer?

Aby monitorować przesył danych w sieci komputerowej, należy wykorzystać program klasy

W systemie Linux dane dotyczące okresu ważności hasła są przechowywane w pliku

Drukarka została zainstalowana w systemie z rodziny Windows. Aby skonfigurować m.in. domyślną orientację druku, ilość stron na arkusz oraz kolory, w trakcie jej ustawiania należy skorzystać z opcji

W sekcji zasilania monitora LCD, powiększone kondensatory elektrolityczne mogą prowadzić do uszkodzenia

Standard zwany IEEE 802.11, używany w lokalnych sieciach komputerowych, określa typ sieci:

Przydzielaniem adresów IP w sieci zajmuje się serwer

Jak nazywa się metoda dostępu do medium transmisyjnego z detekcją kolizji w sieciach LAN?

Programem wykorzystywanym w systemie Linux do odtwarzania muzyki jest

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Jaki protokół stosują komputery, aby informować rutera o przynależności do konkretnej grupy multicastowej?