Pytanie 1

Najskuteczniejszym sposobem na ochronę komputera przed wirusami jest zainstalowanie

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Najskuteczniejszym sposobem na ochronę komputera przed wirusami jest zainstalowanie

Usługa RRAS serwera Windows 2019 jest przeznaczona do

Metoda przesyłania danych pomiędzy urządzeniami CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

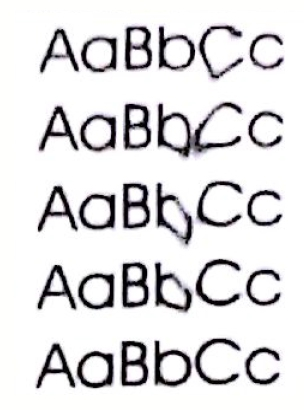

Aby przygotować ikony zaprezentowane na załączonym obrazku do wyświetlania na Pasku zadań w systemie Windows, należy skonfigurować

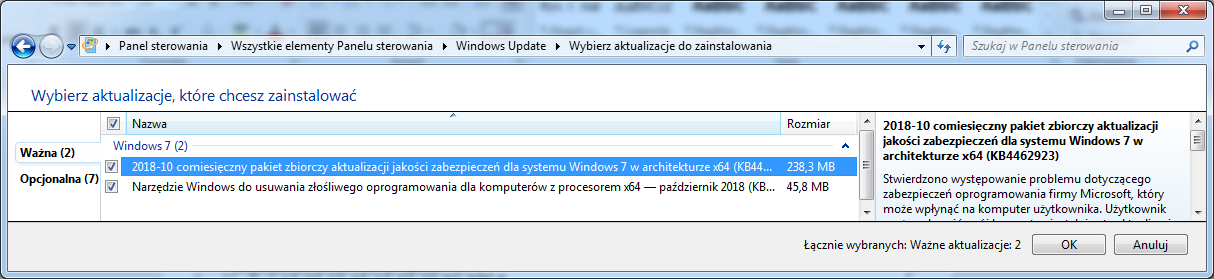

Głównie które aktualizacje zostaną zainstalowane po kliknięciu na przycisk OK prezentowany na zrzucie ekranu?

Który z materiałów eksploatacyjnych nie jest stosowany w ploterach?

Jakiej kategorii skrętka pozwala na przesył danych w zakresie częstotliwości nieprzekraczającym 100 MHz przy szybkości do 1 Gb/s?

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Wypukłe kondensatory elektrolityczne w module zasilania monitora LCD mogą doprowadzić do uszkodzenia

Osoba odpowiedzialna za zarządzanie siecią komputerową pragnie ustalić, jakie połączenia są aktualnie nawiązywane na komputerze z systemem operacyjnym Windows oraz które porty są wykorzystywane do nasłuchu. W tym celu powinna użyć polecenia

Określ najprawdopodobniejszą przyczynę pojawienia się komunikatu: CMOS checksum error press F1 to continue press DEL to setup podczas uruchamiania systemu

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows wyświetla dane dotyczące wszystkich zasobów udostępnionych na komputerze lokalnym?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakim skrótem określane są czynności samokontroli komputera po uruchomieniu zasilania?

W dokumentacji jednego z komponentów komputera zawarto informację, że urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

Urządzenie, które łączy różne segmenty sieci i przekazuje ramki pomiędzy nimi, wybierając odpowiedni port docelowy dla przesyłanych ramek, to

Który z protokołów nie działa w warstwie aplikacji modelu ISO/OSI?

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Jakie jest odpowiednik maski 255.255.252.0 w postaci prefiksu?

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

Użytkownik napotyka trudności z uruchomieniem systemu Windows. W celu rozwiązania tego problemu skorzystał z narzędzia System Image Recovery, które

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

Internet Relay Chat (IRC) to protokół wykorzystywany do

W jakim typie członkostwa w VLAN port może należeć do wielu sieci VLAN?

Protokół stosowany w sieciach komputerowych do zarządzania zdalnym terminalem w modelu klient-serwer, który nie gwarantuje bezpieczeństwa przekazywanych danych i funkcjonuje tylko w formacie tekstowym, to

Który protokół zamienia adresy IP na adresy MAC, używane w sieciach Ethernet?

Po zainstalowaniu systemu Windows 7 zmieniono konfigurację dysku SATA w BIOS-ie komputera z AHCI na IDE. Przy ponownym uruchomieniu komputera system będzie

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

Zaprezentowane właściwości karty sieciowej sugerują, że karta

| Kod Producenta | WN-370USB |

| Interfejs | USB |

| Zgodność ze standardem | IEEE 802.11 b/g/n |

| Ilość wyjść | 1 szt. |

| Zabezpieczenia | WEP 64/128, WPA, WPA2 |

| Wymiary | 49(L) x 26(W) x 10(H) mm |

Jakim złączem zasilany jest wewnętrzny dysk twardy typu IDE?

Jeśli rozdzielczość myszy wynosi 200dpi, a monitor ma rozdzielczość Full HD, to aby przesunąć kursor wzdłuż ekranu, należy przesuń mysz o

Czym są programy GRUB, LILO, NTLDR?

Najbardziej prawdopodobnym powodem niskiej jakości druku z drukarki laserowej, objawiającym się widocznym rozmazywaniem tonera, jest

Na wydrukach uzyskanych z drukarki laserowej można zauważyć pasma wzdłużne oraz powtarzające się defekty. Jedną z możliwych przyczyn niskiej jakości druku jest wada

Aby zmienić port drukarki zainstalowanej w systemie Windows, która funkcja powinna zostać użyta?

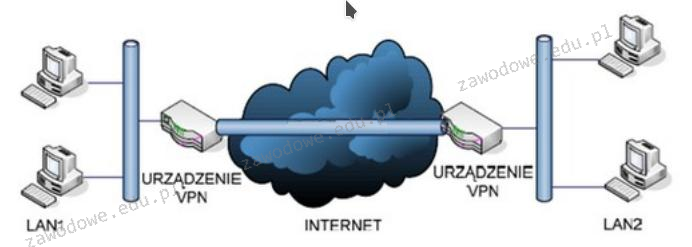

Schemat ilustruje zasadę funkcjonowania sieci VPN o nazwie

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

Komputer jest połączony z myszą bezprzewodową, a kursor w trakcie używania nie porusza się płynnie, tylko "skacze" po ekranie. Możliwą przyczyną awarii urządzenia może być

Jak na diagramach sieciowych LAN oznaczane są punkty dystrybucyjne znajdujące się na różnych kondygnacjach budynku, zgodnie z normą PN-EN 50173?

Aby uzyskać więcej wolnego miejsca na dysku bez tracenia danych, co należy zrobić?