Pytanie 1

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Wynik: 5/40 punktów (12,5%)

Wymagane minimum: 20 punktów (50%)

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Standard WIFI 802.11 b/g używa pasma

Jakie urządzenie zapewnia zabezpieczenie przed różnorodnymi atakami z sieci i może również realizować dodatkowe funkcje, takie jak szyfrowanie danych przesyłanych lub automatyczne informowanie administratora o włamaniu?

Wartość sumy liczb binarnych 1010 i 111 zapisana w systemie dziesiętnym to

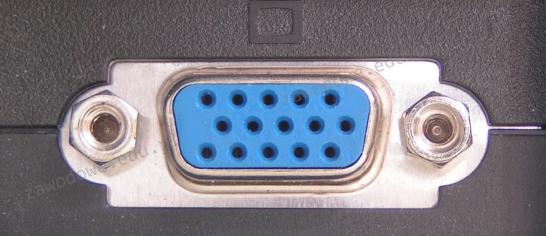

Złącze widoczne na ilustracji służy do podłączenia

Producent wyświetlacza LCD stwierdził, że spełnia on wymagania klasy II według normy ISO 13406-2. Na podstawie danych przedstawionych w tabeli określ, ile pikseli z defektem typu 3 musi wystąpić na wyświetlaczu o naturalnej rozdzielczości 1280x800 pikseli, aby uznać go za uszkodzony?

| Klasa | Maksymalna liczba dopuszczalnych błędów na 1 milion pikseli | ||

|---|---|---|---|

| Typ 1 | Typ 2 | Typ 3 | |

| I | 0 | 0 | 0 |

| II | 2 | 2 | 5 |

| III | 5 | 15 | 50 |

| IV | 50 | 150 | 500 |

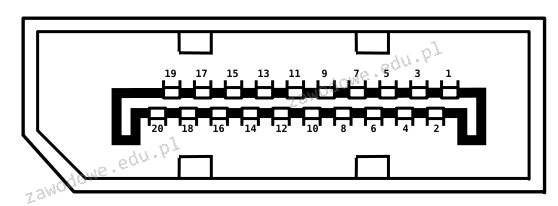

Na ilustracji pokazano złącze:

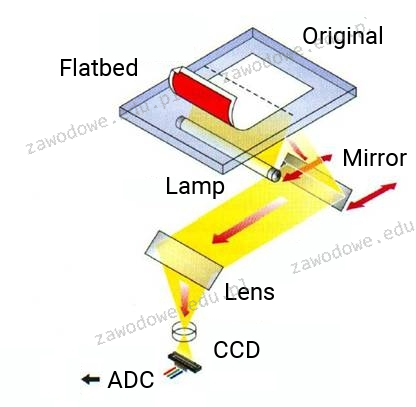

Zaprezentowany schemat ilustruje funkcjonowanie

Jaką cechę posiada przełącznik sieciowy?

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który zmusza go do automatycznej aktualizacji, są

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

NAT64 (Network Address Translation 64) to proces, który przekształca adresy

Aby przywrócić dane z sformatowanego dysku twardego, konieczne jest zastosowanie programu

Analizując ruch w sieci, zauważono, że na adres serwera kierowano tysiące zapytań DNS na sekundę z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego zjawiska był atak typu

Liczby zapisane w systemie binarnym jako 10101010 oraz w systemie heksadecymalnym jako 2D odpowiadają następującym wartościom:

Jaki adres IPv4 identyfikuje urządzenie funkcjonujące w sieci o adresie 14.36.64.0/20?

Poprzez użycie polecenia ipconfig /flushdns można przeprowadzić konserwację urządzenia sieciowego, która polega na

W systemie Linux do monitorowania użycia procesora, pamięci, procesów i obciążenia systemu służy polecenie

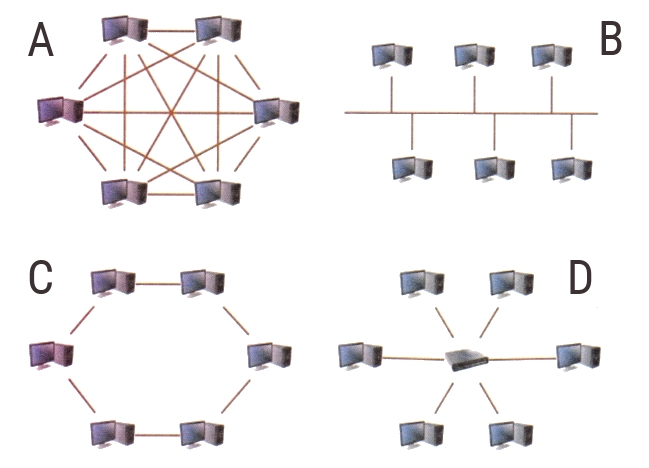

Która z przedstawionych na rysunkach topologii jest topologią siatkową?

Aby prawidłowo uzupełnić składnię przedstawionego polecenia, które udostępnia folder 'Dane' pod nazwą 'test', w miejsce kropek należy wpisać odpowiednie słowo:

net ... test=C:\Dane

Optyczna rozdzielczość to jeden z właściwych parametrów

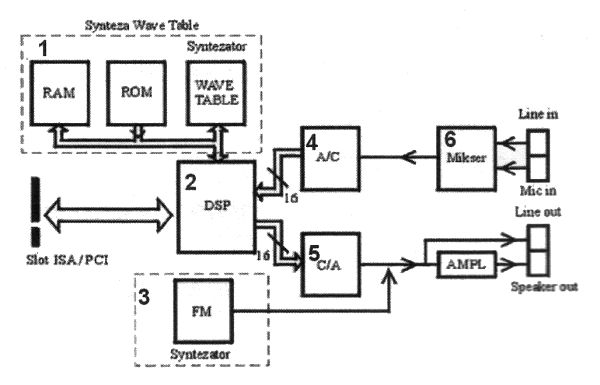

Na diagramie blokowym karty dźwiękowej komponent odpowiedzialny za konwersję sygnału analogowego na cyfrowy jest oznaczony numerem

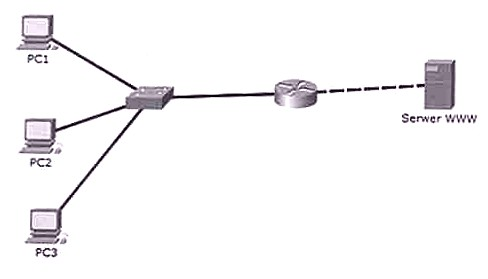

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają dostępu do serwera WWW. Wynik polecenia ping z komputerów bramy jest pozytywny. Który komponent sieci NIE MOŻE być powodem problemu?

Liczba BACA zapisana w systemie heksadecymalnym odpowiada liczbie

Jaka licencja ma charakter zbiorowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, rządowym, charytatywnym na nabycie większej liczby programów firmy Microsoft na korzystnych warunkach?

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Jakie polecenie należy użyć w systemie Windows, aby przeprowadzić śledzenie trasy pakietów do serwera internetowego?

Jakiego protokołu używa warstwa aplikacji w modelu TCP/IP?

Zestaw narzędzi niezbędnych do instalacji okablowania miedzianego typu "skrętka" w lokalnej sieci powinien obejmować

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

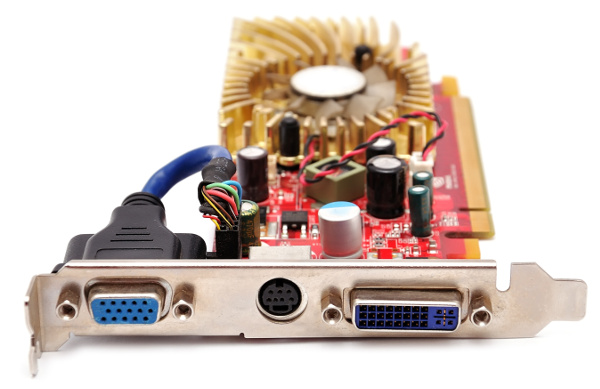

Na przedstawionej fotografii karta graficzna ma widoczne złącza

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Protokół Transport Layer Security (TLS) jest rozwinięciem standardu

Ustanowienie połączenia pomiędzy dwoma oddalonymi hostami za pomocą publicznej sieci, takiej jak Internet, w sposób, że węzły tej sieci nie wpływają na przesyłane pakiety, to

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

Wskaż zdanie, które jest nieprawdziwe:

W systemie Linux wykonanie polecenia chmod 321 start spowoduje przyznanie następujących uprawnień plikowi start:

Domyślnie dostęp anonimowy do zasobów serwera FTP umożliwia

Ikona z wykrzyknikiem, którą widać na ilustracji, pojawiająca się przy nazwie urządzenia w Menedżerze urządzeń, wskazuje, że to urządzenie