Pytanie 1

Jaki protokół jest używany przez komendę ping?

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Jaki protokół jest używany przez komendę ping?

Jaką maskę powinno się zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

W nagłówku ramki standardu IEEE 802.3, który należy do warstwy łącza danych, znajduje się

Symbol przedstawiony na ilustracji oznacza produkt

Firma planuje stworzenie lokalnej sieci komputerowej, która będzie obejmować serwer, drukarkę oraz 10 stacji roboczych bez kart bezprzewodowych. Internet będzie udostępniany przez ruter z modemem ADSL i czterema portami LAN. Które z wymienionych elementów sieciowych jest konieczne, aby sieć mogła prawidłowo działać i uzyskać dostęp do Internetu?

Dezaktywacja automatycznych aktualizacji systemu Windows skutkuje

Najszybszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Kontrola pasma (ang. bandwidth control) w switchu to funkcjonalność

Jaki adres stanowi adres rozgłoszeniowy dla hosta o IP 171.25.172.29 oraz masce sieci 255.255.0.0?

Jakie narzędzie w systemie Windows służy do wykonania poleceń, wykorzystując logikę obiektową oraz cmdlety?

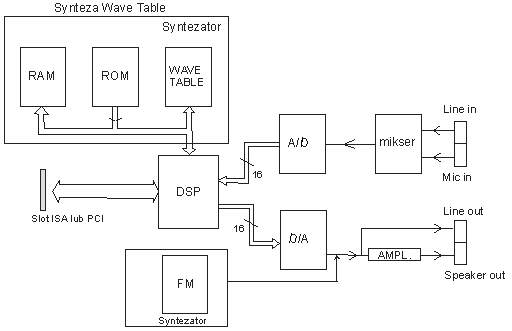

Na które wyjście powinniśmy podłączyć aktywne głośniki w karcie dźwiękowej, której schemat przedstawiony jest na rysunku?

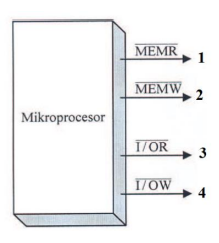

Sygnał kontrolny generowany przez procesor, umożliwiający zapis do urządzeń wejściowych i wyjściowych, został na diagramie oznaczony numerem

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Na ilustracji ukazano narzędzie systemowe w Windows 7, które jest używane do

Protokół trasowania wewnętrznego, który wykorzystuje metrykę wektora odległości, to

Co wskazuje oznaczenie danego procesora?

Wykorzystane kasety od drukarek powinny być

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jak prezentuje się adres IP 192.168.1.12 w formacie binarnym?

Jaką topologię fizyczną wykorzystuje się w sieciach o logice Token Ring?

Aby zamontować przedstawioną kartę graficzną, potrzebna jest płyta główna posiadająca złącze

Wprowadzając w wierszu poleceń systemu Windows Server komendę convert, można wykonać

Które z urządzeń używanych w sieci komputerowej NIE WPŁYWA na liczbę domen kolizyjnych?

W metodzie dostępu do medium CSMA/CD (Carrier Sense Multiple Access with Collision Detection) stacja, która planuje rozpocząć transmisję, nasłuchuje, czy w sieci występuje aktywność, a następnie

Aby zminimalizować różnice w kolorach pomiędzy zeskanowanymi obrazami prezentowanymi na monitorze a ich wersjami oryginalnymi, należy przeprowadzić

Active Directory w systemach MS Windows Server 2000 oraz MS Windows Server 2003 to

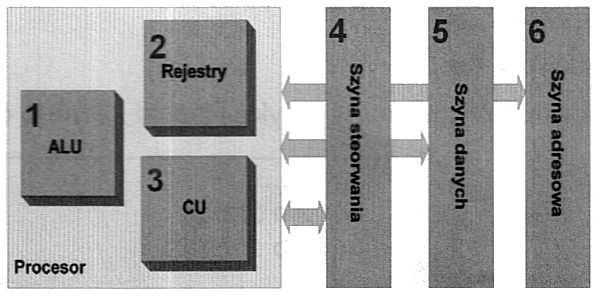

Na diagramie element odpowiedzialny za dekodowanie poleceń jest oznaczony liczbą

Aby dostęp do systemu Windows Serwer 2016 był możliwy dla 50 urządzeń, bez względu na liczbę użytkowników, należy w firmie zakupić licencję

Jaki rodzaj fizycznej topologii w sieciach komputerowych jest pokazany na ilustracji?

Podczas realizacji projektu sieci LAN zastosowano medium transmisyjne zgodne ze standardem Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

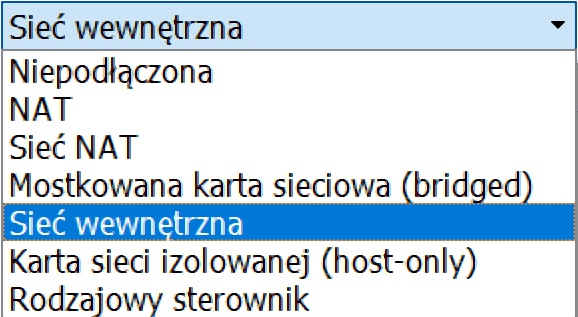

Na ilustracji przedstawiono opcje karty sieciowej w oprogramowaniu VirtualBox. Ustawienie na wartość sieć wewnętrzna, spowoduje, że

Który z protokołów w systemach operacyjnych Linux jest używany w sieciach lokalnych?

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Zgodnie z wytycznymi dotyczącymi karty graficznej, jej możliwości pracy z systemem AGP 2X/4X pozwalają na

Zjawisko przenikania, które ma miejsce w sieciach komputerowych, polega na

Wskaż znak umieszczany na urządzeniach elektrycznych przeznaczonych do obrotu i sprzedaży w Unii Europejskiej.

Parametry katalogowe przedstawione w ramce dotyczą dysku twardego

| ST31000528AS |

| Seagate Barracuda 7200.12 ,32 MB, |

| Serial ATA/300, Heads 4, Capacity 1TB |

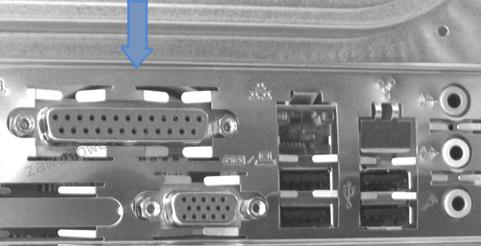

Na ilustracji, strzałka wskazuje na złącze interfejsu

Jakie typy połączeń z Internetem mogą być współdzielone w sieci lokalnej?