Pytanie 1

Na ilustracji widoczna jest pamięć operacyjna

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji widoczna jest pamięć operacyjna

W czterech różnych sklepach dostępny jest ten sam komputer w odmiennych cenach. Gdzie można go kupić najtaniej?

| Sklep | Cena netto | Podatek | Informacje dodatkowe |

|---|---|---|---|

| A. | 1500 zł | 23% | Rabat 5% |

| B. | 1600 zł | 23% | Rabat 15% |

| C. | 1650 zł | 23% | Rabat 20% |

| D. | 1800 zł | 23% | Rabat 25 % |

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

Do serwisu komputerowego przyniesiono laptop z matrycą, która bardzo słabo wyświetla obraz. Dodatkowo obraz jest niezwykle ciemny i widoczny jedynie z bliska. Co może być przyczyną tej usterki?

Na ilustracji zaprezentowane jest urządzenie do

Który protokół jest wykorzystywany do konwersji między adresami IP publicznymi a prywatnymi?

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz maską 26 bitową?

Jaką usługę można wykorzystać do zdalnej pracy na komputerze z systemem Windows, korzystając z innego komputera z tym samym systemem, który jest podłączony do tej samej sieci lub do Internetu?

Po uruchomieniu komputera, procedura POST wskazuje 512 MB RAM. Natomiast w ogólnych właściwościach systemu operacyjnego Windows wyświetla się wartość 480 MB RAM. Jakie są powody tej różnicy?

Jaki adres IPv4 wykorzystuje się do testowania protokołów TCP/IP na jednym hoście?

Jakie funkcje posiada program tar?

Który z dynamicznych protokołów rutingu został stworzony jako protokół bramy zewnętrznej do łączenia różnych dostawców usług internetowych?

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

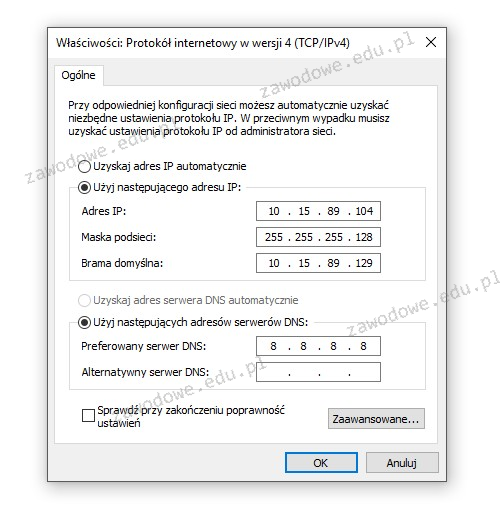

Na rysunku przedstawiono ustawienia karty sieciowej urządzenia z adresem IP 10.15.89.104/25. Co z tego wynika?

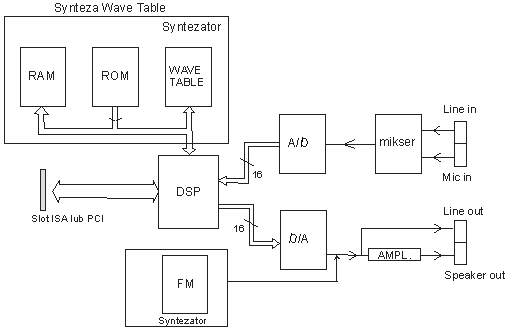

Który z elementów przedstawionych na diagramie karty dźwiękowej na rysunku jest odpowiedzialny za cyfrowe przetwarzanie sygnałów?

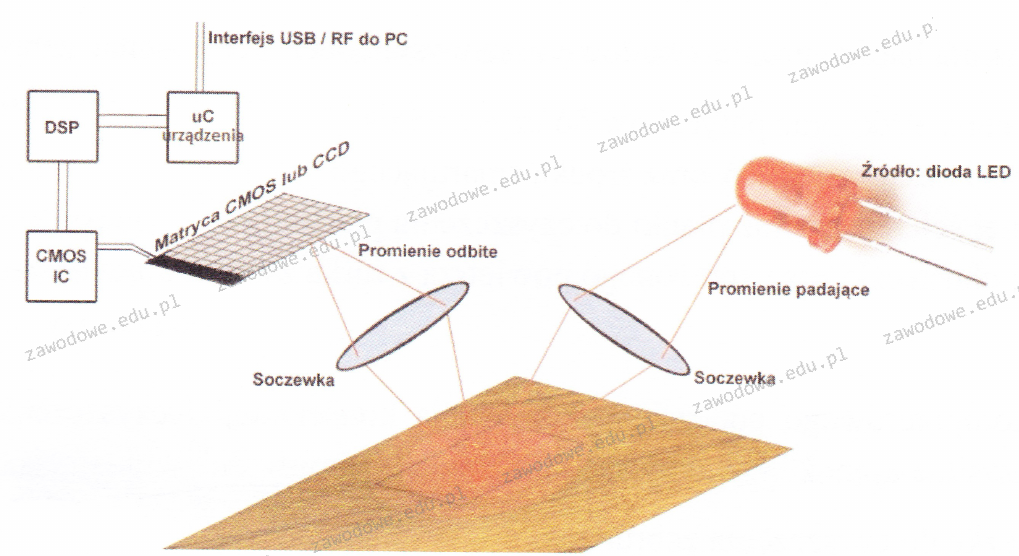

Zilustrowany schemat przedstawia zasadę funkcjonowania

Aby zapobiec uszkodzeniu sprzętu w trakcie modernizacji laptopa polegającej na wymianie modułów pamięci RAM, należy

Interfejs UDMA to interfejs

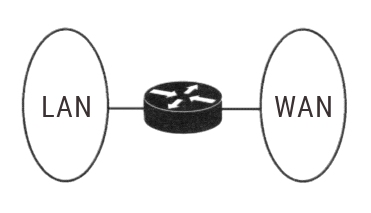

Jakie urządzenie sieciowe zostało pokazane na diagramie sieciowym?

Drukarka do zdjęć ma mocno zabrudzoną obudowę oraz ekran. Aby oczyścić zanieczyszczenia bez ryzyka ich uszkodzenia, należy zastosować

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

Jakie polecenie w systemie Linux nie pozwala na diagnozowanie sprzętu komputerowego?

Na zdjęciu widać

W systemie NTFS do zmiany nazwy pliku konieczne jest posiadanie uprawnienia

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

Które z poniższych poleceń w systemie Linux NIE pozwala na przeprowadzenie testów diagnostycznych sprzętu komputerowego?

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

Który z wewnętrznych protokołów routingu bazuje na metodzie wektora odległości?

Odmianą pamięci, która zapewnia tylko odczyt i może być usunięta przy użyciu światła ultrafioletowego, jest pamięć

Aby stworzyć kontroler domeny w środowisku systemów Windows Server na lokalnym serwerze, konieczne jest zainstalowanie roli

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

Który z wymienionych formatów płyt głównych charakteryzuje się najmniejszymi wymiarami?

Zasady filtrowania ruchu w sieci przez firewall określane są w formie

W przypadku planowania wykorzystania przestrzeni dyskowej komputera do przechowywania oraz udostępniania danych, takich jak pliki oraz aplikacje dostępne w internecie, a także ich zarządzania, komputer powinien być skonfigurowany jako

Narzędzie systemów operacyjnych Windows używane do zmiany ustawień interfejsów sieciowych, na przykład przekształcenie dynamicznej konfiguracji karty sieciowej w konfigurację statyczną, to

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny wyłącznie za archiwizację danych przechowywanych na serwerowym dysku?

Do jakiego pomiaru wykorzystywany jest watomierz?