Pytanie 1

Narzędzie pokazane na ilustracji służy do

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Narzędzie pokazane na ilustracji służy do

Aby przywrócić dane z sformatowanego dysku twardego, konieczne jest zastosowanie programu

Aby prawidłowo uzupełnić składnię przedstawionego polecenia, które udostępnia folder 'Dane' pod nazwą 'test', w miejsce kropek należy wpisać odpowiednie słowo:

net ... test=C:\Dane

Program firewall nie zapewnia ochrony przed

Tryb działania portu równoległego, oparty na magistrali ISA, który umożliwia transfer danych do 2,4 MB/s, przeznaczony dla skanerów oraz urządzeń wielofunkcyjnych, to

Które z poniższych stwierdzeń NIE odnosi się do pamięci cache L1?

Aby dezaktywować transmitowanie nazwy sieci Wi-Fi, należy w punkcie dostępowym wyłączyć opcję

Gdy system operacyjny laptopa działa normalnie, na ekranie wyświetla się komunikat o konieczności sformatowania wewnętrznego dysku twardego. Może to sugerować

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Aby wymienić uszkodzony moduł pamięci RAM, najpierw trzeba

Aby komputery mogły udostępniać swoje zasoby w sieci, muszą mieć przypisane różne

Który z standardów korzysta z częstotliwości 5 GHz?

Zgodnie z ustawą z 14 grudnia 2012 roku o odpadach, wymagane jest

Jakie narzędzie powinno się wykorzystać w systemie Windows, aby uzyskać informacje o problemach z systemem?

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Jakie jest główne zadanie programu Wireshark?

Program do odzyskiwania danych, stosowany w warunkach domowych, umożliwia przywrócenie danych z dysku twardego w sytuacji

Liczba FAFC w systemie heksadecymalnym odpowiada wartości liczbowej

Jakie zadanie pełni router?

Na zamieszczonym zdjęciu widać

Jakie rodzaje partycji mogą występować w systemie Windows?

Jakie zakresy adresów IPv4 mogą być używane jako adresy prywatne w lokalnej sieci?

Czym nie jest program antywirusowy?

Jaką kwotę łącznie pochłonie robocizna związana z montażem 20 modułów RJ45 z krawędziowym złączem narzędziowym na przewodach 4-parowych, jeśli stawka godzinowa montera wynosi 15 zł/h, a według tabeli KNR czas montażu pojedynczego modułu to 0,10 r-g?

Aby zmierzyć moc zużywaną przez komputer, należy zastosować

Wskaż ilustrację obrazującą typowy materiał eksploatacyjny używany w drukarkach żelowych?

Ile wynosi pojemność jednowarstwowej płyty Blu-ray?

Użytkownik uszkodził płytę główną z gniazdem dla procesora AM2. Płytę z uszkodzeniami można wymienić na model z gniazdem, nie zmieniając procesora oraz pamięci

Jakim poleceniem w systemie Linux można utworzyć nowych użytkowników?

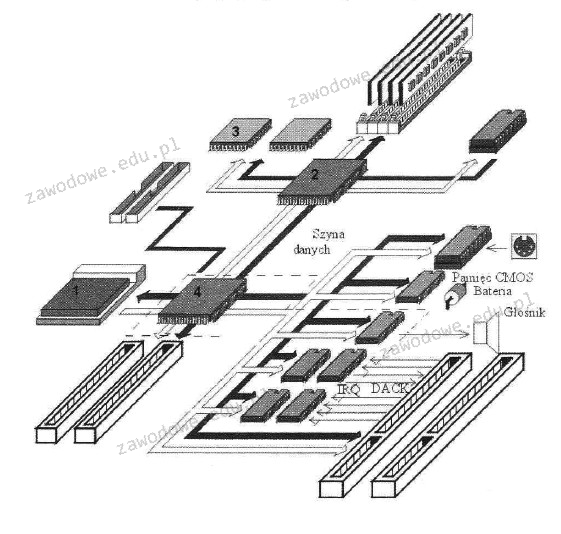

Jaką liczbą oznaczono procesor na diagramie płyty głównej komputera?

Wskaź, które zdanie dotyczące zapory sieciowej jest nieprawdziwe?

Jakim wynikiem jest suma liczb binarnych 1001101 oraz 11001?

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

Którego z poniższych zadań nie wykonują serwery plików?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaki typ zabezpieczeń w sieciach WiFi oferuje najwyższy poziom ochrony?

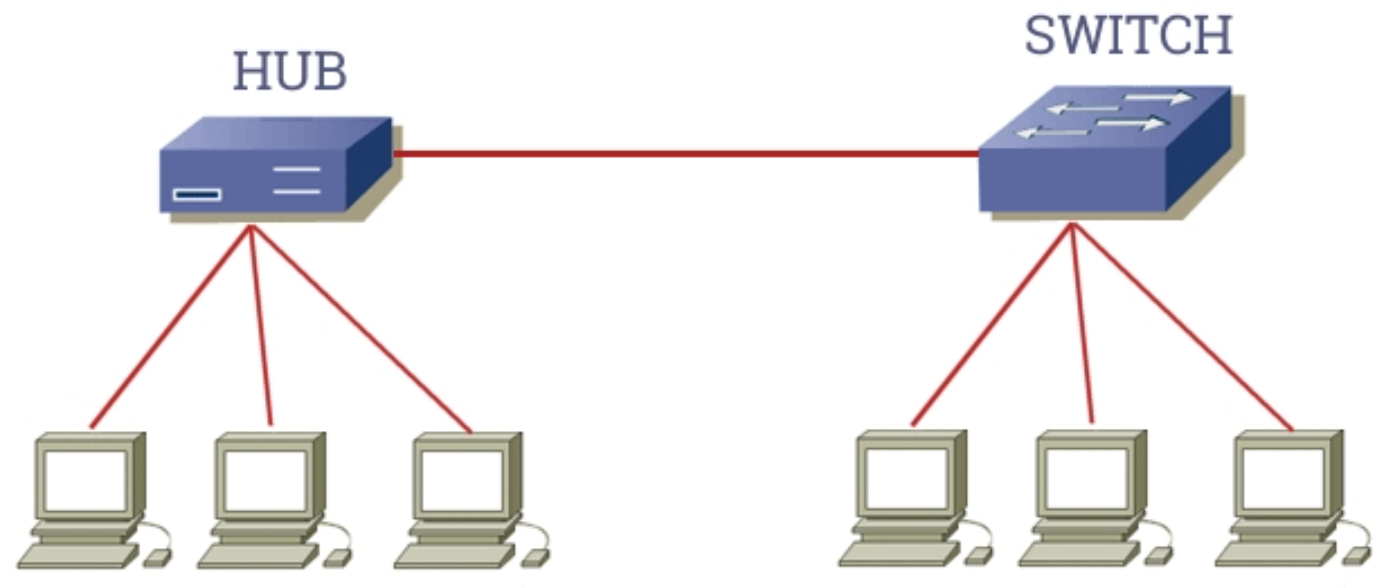

Ile domen kolizyjnych występuje w sieci pokazanej na rysunku?

Jaki typ grupy jest automatycznie przypisany dla nowo tworzonej grupy w kontrolerze domeny systemu Windows Server?

Użytkownik systemu Windows może logować się na każdym komputerze w sieci, korzystając z profilu, który jest przechowywany na serwerze i może być zmieniany przez użytkownika. Jak nazywa się ten profil?

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm