Pytanie 1

Zapis w dokumentacji kardiotokografu „prezentacja sygnału FHR” dotyczy

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Zapis w dokumentacji kardiotokografu „prezentacja sygnału FHR” dotyczy

Metoda diagnostyczna, w której rejestruje się rozpad radioizotopu wprowadzonego do organizmu, to

Symbole: 1U, 2U, 3U stosowane do oznaczenia modułów w szafach typu rack określają

Aby system komputerowy współpracujący z ultrasonografem mógł nagrywać na jednej płycie DVD dane z kolejnych, wykonywanych na bieżąco badań, musi być wyposażony w nagrywanie

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

Które działanie nie odnosi się do podstawowej funkcji komputera?

W dokumentacji Medycznego Systemu Informatycznego zapisano, że „przed użyciem programów instalacyjnych należy się upewnić, że niektóre porty w środowisku są dostępne do użycia z instalowanym oprogramowaniem pośrednim.” W celu sprawdzenia dostępności portu należy użyć programu narzędziowego

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

W celu rejestracji promieniowania radioizotopu nagromadzonego w narządach stosowana jest

Moduł EKG do badań wysiłkowych został wyposażony w interfejs Bluetooth w celu przesyłania wyników badań. Aby połączyć moduł z stanowiskiem komputerowym, należy wybrać interfejs oznaczony symbolem

Zabieg diametrii krótkofalowej powoduje

Znak ~ na początku ciągu znaków w systemach uniksowych oznacza

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

Które polecenie SQL nie modyfikuje tabeli bazy danych?

Technologia OLED znajduje zastosowanie w

Z przedstawionej dokumentacji pamięci wynika że jest ona przeznaczona do

rodzaj pamięci : SO-DIMM standard : DDR3-1333 (PC3-10600) pojemność pojedynczego modułu : 4 GB |

Parametr CL (czas opóźnienia, jaki upływa między wysłaniem przez kontroler RAM żądania dostępu do kolumny pamięci a otrzymaniem danych z tej kolumny) jest wyrażany w

Jakie jest przeznaczenie drukarki, której dotyczy zamieszczony fragment specyfikacji?

| Głowica drukująca | 24-igłowa |

| Średnica przewodu | 0,2 mm |

| Kierunek druku | Dwukierunkowe/bezkierunkowe drukowanie |

| Rozdzielczość grafiki | Maks. 360 (wys.) x 360 (szer.) dpi |

| Szybkość drukowania | High Speed Draft: 607 znaków/s, tryb Utility: 485 znaków/s, tryb Near Letter Quality: 245 znaków/s, Letter Quality: 165 znaków/s |

| Gęstość przesunięć wierszy | 4,23 mm (1/6"), 3,18 mm (1/8"), n x 0,42 mm (m/60") (m=0-127), n x 0,14 mm (n/180") (n=0-255), n x 0,12 mm (n/216") (n=0-255), n x 0,07 mm (n/360") (n=0-255) |

| Szybkość podajnika | 10 cali na sekundę |

| Pobieranie papieru | Ręczne (góra), traktor pchający (góra), traktor pchający (tył), traktor pchający (dół), podajnik pojedynczych arkuszy (tył) |

| Gęstość znaków | High Speed Draft: 10,0 zn./cal 18,0 zn./cal Jakość użytkowa: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20 zn./cal Tryb Near Letter Quality: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20,0 zn./cal Tryb Letter Quality: 10 zn./cal 12 zn./cal 15 zn./cal 17,1 zn./cal 20 zn./cal, proporcjonalnie |

| Szerokość druku | 136 zn./linia przy ANK 10 zn./cal |

Elementem sieci komputerowej w topologii gwiazdy, pozwalającym przyłączyć wiele urządzeń sieciowych, jest

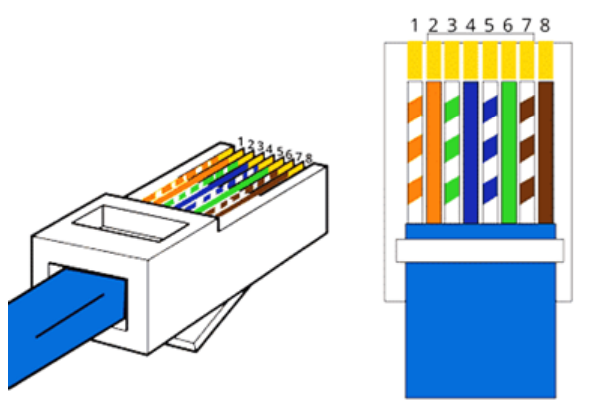

W którym standardzie jest wykonane zakończenie przewodu sieciowego przedstawione na rysunku?

| 1. White Orange | 5. White Blue |

| 2. Orange | 6. Green |

| 3. White Green | 7. White Brown |

| 4. Blue | 8. Brown |

Dla której wartości z wymienionych rezystancji, zastosowanie układu poprawnie mierzonego prądu zapewnia najmniejszy błąd pomiaru?

W programowaniu, aby przerwać wykonywanie pętli i wyjść z niej, należy użyć polecenia

W dokumencie urządzenia elektroniki medycznej podano następujące informacje:

Interfejs obrazu DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. • Szybkość przesyłania obrazów: 2 MB/s. Interfejs RIS/CIS zgodny z DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. |

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Którą metodę montażu należy zastosować w celu zakończenia przewodu zasilającego końcówkami przedstawionymi na fotografii?

Narzędzie przedstawione na rysunku służy do

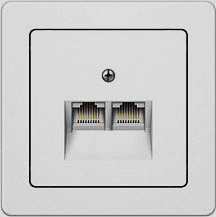

W sieci centralnego monitoringu zamontowane są gniazda przedstawione na rysunku. Jakiego typu wtykami muszą być zakończone kable?

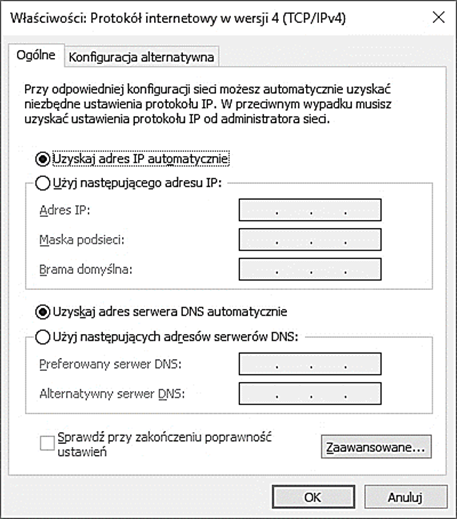

Aby karta sieciowa automatycznie uzyskiwała adres IP, ruter musi mieć włączony serwer

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

Które badanie endoskopowe należy wykorzystać do wizualizacji jamy stawu?

Pod wpływem zwiększenia natężenia promieniowania widzialnego (bodźca świetlnego) źrenica zdrowego oka ludzkiego

Który system bazodanowy uniemożliwia bezpłatne zastosowanie komercyjne?

Na rysunku przedstawiono urządzenie z dodatkową kartą pamięci. Który rodzaj karty może zostać zastosowany w urządzeniu?

Która usługa serwera przydziela adresy IP komputerom w sieci LAN?

Aby uruchomić w systemie linux program nazwa.py, należy wpisać

Usterka programowa uniemożliwia uruchomienie systemu Windows. W celu diagnozy i usunięcia usterki wskazane jest

Wynikiem działania funkcji F(n) będzie

funkcja F(n) jeżeli n>1 F(n)=3*F(n-1) w przeciwnym wypadku F(n)=3 |

Podczas tworzenia bazy danych pacjentów polem unikatowym pełniącym rolę klucza podstawowego jest pole zawierające informacje o

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia