Pytanie 1

Aby aktywować funkcję S.M.A.R.T. dysku twardego, która odpowiada za monitorowanie i wczesne ostrzeganie przed awariami, należy skorzystać z

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Aby aktywować funkcję S.M.A.R.T. dysku twardego, która odpowiada za monitorowanie i wczesne ostrzeganie przed awariami, należy skorzystać z

W przypadku drukarki igłowej, jaki materiał eksploatacyjny jest używany?

Shareware to typ licencji, która polega na

Jaki adres IP należy do grupy A?

W specyfikacji głośników komputerowych producent mógł podać informację, że maksymalne pasmo przenoszenia wynosi

Jakie działanie może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

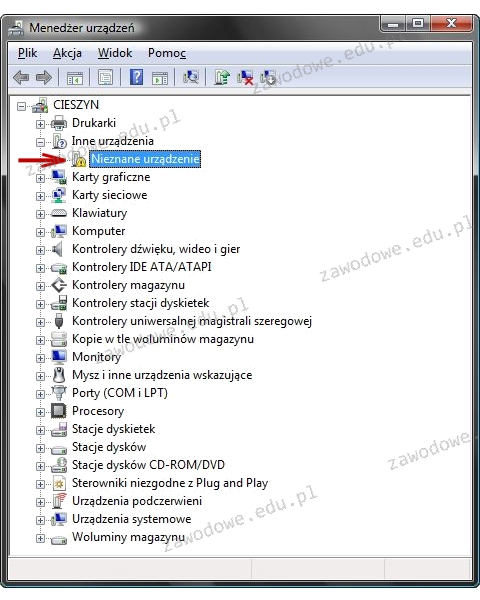

Ikona z wykrzyknikiem, pokazana na ilustracji, która pojawia się obok nazwy sprzętu w Menedżerze urządzeń, wskazuje, że to urządzenie

Jaką maksymalną ilość GB pamięci RAM może obsłużyć 32-bitowa edycja systemu Windows?

W systemie Linux narzędzie fsck umożliwia

Narzędziem do monitorowania, które umożliwia przechwytywanie, rejestrowanie oraz dekodowanie różnych pakietów sieciowych, jest

Każdorazowo automatycznie szyfrowany staje się plik, który został zaszyfrowany przez użytkownika za pomocą systemu NTFS 5.0, w momencie

Czym jest prefetching?

Celem złocenia styków złącz HDMI jest

Pierwszym krokiem koniecznym do ochrony rutera przed nieautoryzowanym dostępem do jego panelu konfiguracyjnego jest

Aktywacja opcji Udostępnienie połączenia internetowego w systemie Windows powoduje automatyczne przydzielanie adresów IP dla komputerów (hostów) z niej korzystających. W tym celu używana jest usługa

Ile maksymalnie hostów można przydzielić w sieci o masce 255.255.255.192?

Atak na system komputerowy przeprowadzany jednocześnie z wielu maszyn w sieci, który polega na zablokowaniu działania tego systemu przez zajęcie wszystkich dostępnych zasobów, określany jest mianem

Które środowisko graficzne przeznaczone dla systemu Linux charakteryzuje się najmniejszymi wymaganiami parametrów pamięci RAM?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Wskaż tryb operacyjny, w którym komputer wykorzystuje najmniej energii

Jak na diagramach sieciowych LAN oznaczane są punkty dystrybucyjne znajdujące się na różnych kondygnacjach budynku, zgodnie z normą PN-EN 50173?

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

Norma TIA/EIA-568-B.2 definiuje parametry specyfikacji transmisyjnej

W systemie binarnym liczba 51(10) przyjmuje formę

Symbol przedstawiony na ilustracji oznacza rodzaj złącza

Jak można skonfigurować sieć VLAN?

Jakie oprogramowanie do wirtualizacji jest dostępne jako rola w systemie Windows Server 2012?

W strukturze sieciowej zaleca się umiejscowienie jednego punktu abonenckiego na powierzchni wynoszącej

Na rysunku ukazany jest diagram blokowy zasilacza

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

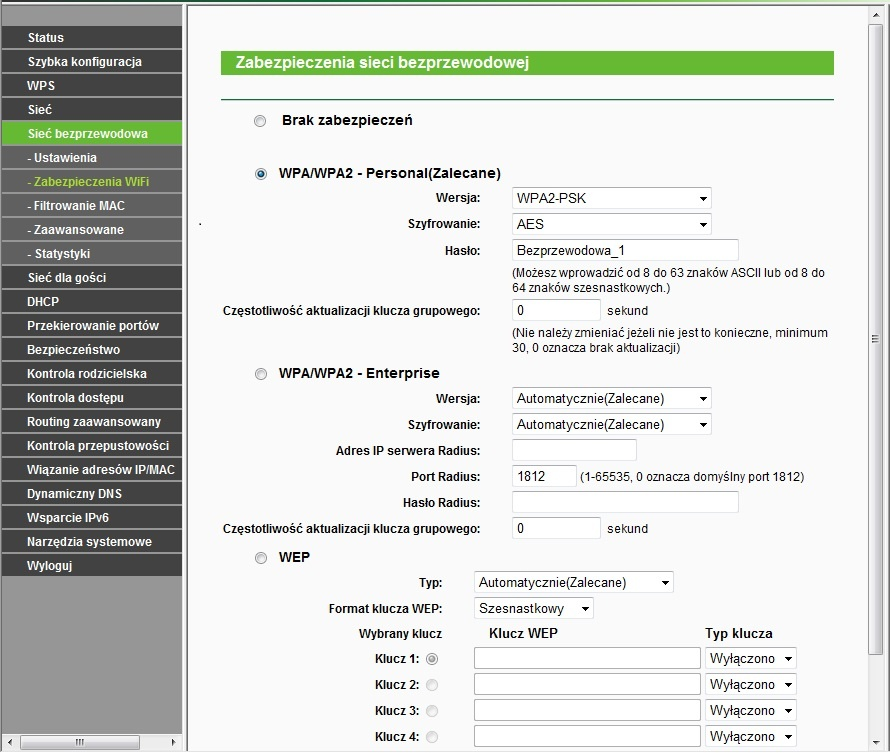

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

Autorskie prawo osobiste twórcy do programu komputerowego

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

Jakie urządzenie pozwala na podłączenie drukarki, która nie ma karty sieciowej, do lokalnej sieci komputerowej?

Do zarządzania konfiguracją grup komputerowych oraz użytkowników w systemach Windows Server, należy wykorzystać narzędzie

W ramce przedstawiono treść jednego z plików w systemie operacyjnym MS Windows. Jest to plik

| [boot loader] Time out=30 Default=Multi(0)disk(0)rdisk(0)partition(1)WINDOWS [operating system] Multi(0)disk(0)rdisk(0)partition(1)WINDOWS="Microsoft Windows XP Home Edition"/ fastdetect/NoExecute=OptOut |

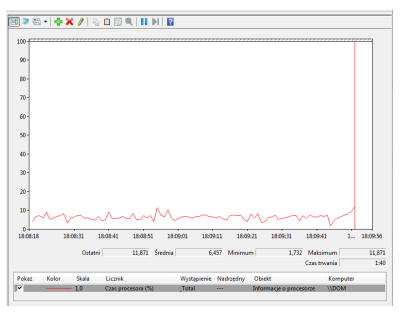

Aby zainicjować w systemie Windows oprogramowanie do monitorowania wydajności komputera przedstawione na ilustracji, należy otworzyć

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosowany jest mechanizm

Która z kopii w trakcie archiwizacji plików pozostawia ślad archiwizacji?

Jakie urządzenie sieciowe powinno zastąpić koncentrator, aby podzielić sieć LAN na cztery odrębne domeny kolizji?