Pytanie 1

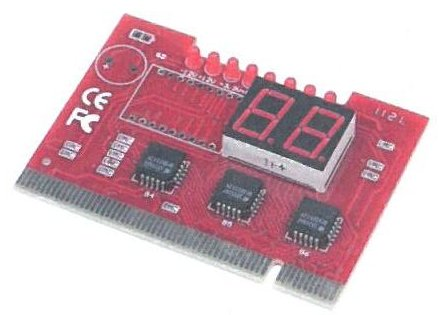

Na ilustracji zaprezentowano

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji zaprezentowano

Jakie jest główne zadanie systemu DNS w sieci komputerowej?

Metoda transmisji żetonu (ang. token) znajduje zastosowanie w topologii

W jakiej topologii fizycznej sieci każde urządzenie ma dokładnie dwa połączenia, jedno z najbliższymi sąsiadami, a dane są przesyłane z jednego komputera do kolejnego w formie pętli?

Które medium transmisyjne umożliwia izolację galwaniczną pomiędzy systemami przesyłu danych?

Osoba korzystająca z komputera udostępnia w sieci Internet pliki, które posiada. Prawa autorskie będą złamane, gdy udostępni

W celu zrealizowania instalacji sieciowej na stacjach roboczych z systemem operacyjnym Windows, należy na serwerze zainstalować usługi

Który z symboli w systemach operacyjnych z rodziny Windows powinien być użyty przy udostępnianiu zasobu ukrytego w sieci?

Jaką liczbę adresów IP należy wykorzystać, aby 4 komputery podłączone do switcha mogły się swobodnie komunikować?

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

Komunikat "BIOS checksum error" pojawiający się podczas uruchamiania komputera zazwyczaj wskazuje na

W systemie Windows, domyślne konto administratora po jego dezaktywowaniu oraz ponownym uruchomieniu komputera

Które z poniższych zdań charakteryzuje protokół SSH (Secure Shell)?

W systemie Windows 7 konfigurację interfejsu sieciowego można przeprowadzić, używając rozwinięcia polecenia

W podejściu archiwizacji danych określanym jako Dziadek – Ojciec – Syn na poziomie Dziadek wykonuje się kopię danych na koniec

Ile bitów trzeba wydzielić z części hosta, aby z sieci o adresie IPv4 170.16.0.0/16 utworzyć 24 podsieci?

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Port zgodny z standardem RS-232, działający w trybie asynchronicznym, to

Diagnostykę systemu Linux można przeprowadzić za pomocą komendy

| Thread(s) per core: | 1 |

| Core(s) per socket: | 4 |

| Socket(s): | 1 |

| NUMA node(s): | 1 |

Nie jest możliwe wykonywanie okresowych kopii zapasowych dysków serwera na nośnikach wymiennych typu

Jakie urządzenie powinno być zainstalowane w serwerze, aby umożliwić automatyczne archiwizowanie danych na taśmach magnetycznych?

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

W systemie Windows XP, aby zmienić typ systemu plików z FAT32 na NTFS, należy użyć programu

W systemie Windows 7 aby skopiować folder c:\test wraz z jego podfolderami na dysk zewnętrzny f:\, należy zastosować polecenie

Jaką komendę należy wykorzystać, aby uzyskać informację o rekordzie MX dla podanej domeny?

Który z protokołów służy do synchronizacji czasu?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

ACPI to interfejs, który pozwala na

Która z poniższych czynności NIE przyczynia się do personalizacji systemu operacyjnego Windows?

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który wymusza jego automatyczne aktualizacje, są

Jakie urządzenie sieciowe umożliwia połączenie lokalnej sieci LAN z rozległą siecią WAN?

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

W przypadku okablowania strukturalnego opartego na skrętce UTP kat.6, jakie gniazda sieciowe powinny być używane?

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

Jakie urządzenie elektroniczne ma zdolność do magazynowania ładunku elektrycznego?

Równoważnym zapisem 232 bajtów jest zapis

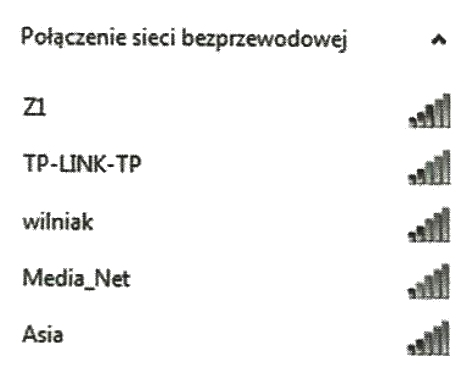

Użytkownik laptopa z systemem Windows 7 widzi dostępne sieci Wi-Fi, jak przedstawiono na ilustracji. Przy konfiguracji połączenia z siecią Z1 musi wprowadzić

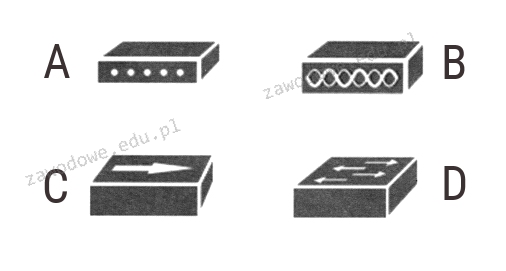

Który symbol reprezentuje przełącznik?

W standardzie Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP przypisane do pinów

Najczęstszym powodem rozmazywania się tonera na wydrukach z drukarki laserowej jest