Pytanie 1

Użytkownik systemu Windows doświadcza komunikatów o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Użytkownik systemu Windows doświadcza komunikatów o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Jakiej klasy adresów IPv4 dotyczą adresy, które mają dwa najbardziej znaczące bity ustawione na 10?

Który komponent mikroprocesora odpowiada m.in. za odczytywanie instrukcji z pamięci oraz generowanie sygnałów kontrolnych?

Podanie nieprawidłowych napięć do płyty głównej może skutkować

W załączonej ramce przedstawiono opis technologii

| Technologia ta to rewolucyjna i nowatorska platforma, która pozwala na inteligentne skalowanie wydajności podsystemu graficznego poprzez łączenie mocy kilku kart graficznych NVIDIA pracujących na płycie głównej. Dzięki wykorzystaniu zastrzeżonych algorytmów oraz wbudowanej w każdy z procesorów graficznych NVIDIA dedykowanej logiki sterującej, która odpowiada za skalowanie wydajności, technologia ta zapewnia do 2 razy (w przypadku dwóch kart) lub 2,8 razy (w przypadku trzech kart) wyższą wydajność niż w przypadku korzystania z pojedynczej karty graficznej. |

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Która norma odnosi się do okablowania strukturalnego?

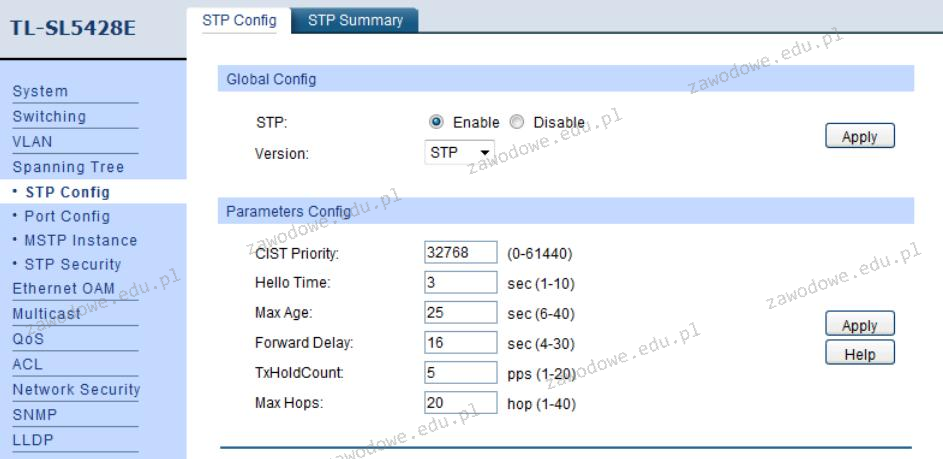

Na podstawie zrzutu ekranu ilustrującego ustawienia przełącznika można wnioskować, że

Plik ma wielkość 2 KiB. Co to oznacza?

Narzędzie służące do przechwytywania oraz ewentualnej analizy ruchu w sieci to

Program o nazwie dd, którego przykład użycia przedstawiono w systemie Linux, umożliwia:

dd if=/dev/sdb of=/home/uzytkownik/Linux.iso

Po wykonaniu podanego polecenia w systemie Windows:

net accounts /MINPWLEN:11liczba 11 zostanie przydzielona dla:

Najskuteczniejszym sposobem na ochronę komputera przed wirusami jest zainstalowanie

Laptopy zazwyczaj są wyposażone w bezprzewodowe sieci LAN. Ograniczenia ich stosowania dotyczą emisji fal radiowych, które mogą zakłócać działanie innych, istotnych dla bezpieczeństwa, urządzeń?

Jaką minimalną ilość pamięci RAM musi mieć komputer, aby móc uruchomić 64-bitowy system operacyjny Windows 7 w trybie graficznym?

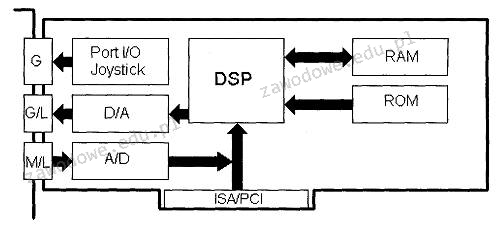

Element funkcjonalny opisany jako DSP w załączonym diagramie blokowym to

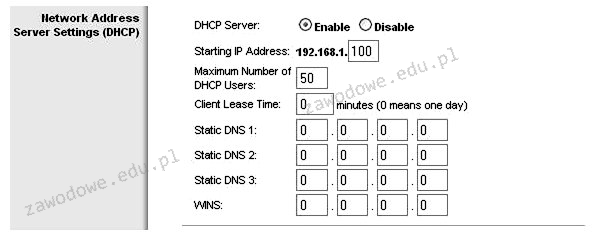

Aktywacja opcji Udostępnienie połączenia internetowego w systemie Windows powoduje automatyczne przydzielanie adresów IP dla komputerów (hostów) z niej korzystających. W tym celu używana jest usługa

Aby zabezpieczyć komputery w lokalnej sieci przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Aby przekształcić zeskanowany obraz na tekst, należy użyć oprogramowania, które stosuje techniki

Który z elementów szafy krosowniczej został pokazany na ilustracji?

Wykonane polecenia, uruchomione w interfejsie CLI rutera marki CISCO, spowodują ```Router#configure terminal Router(config)#interface FastEthernet 0/0 Router(config-if)#ip address 10.0.0.1 255.255.255.0 Router(config-if)#ip nat inside```

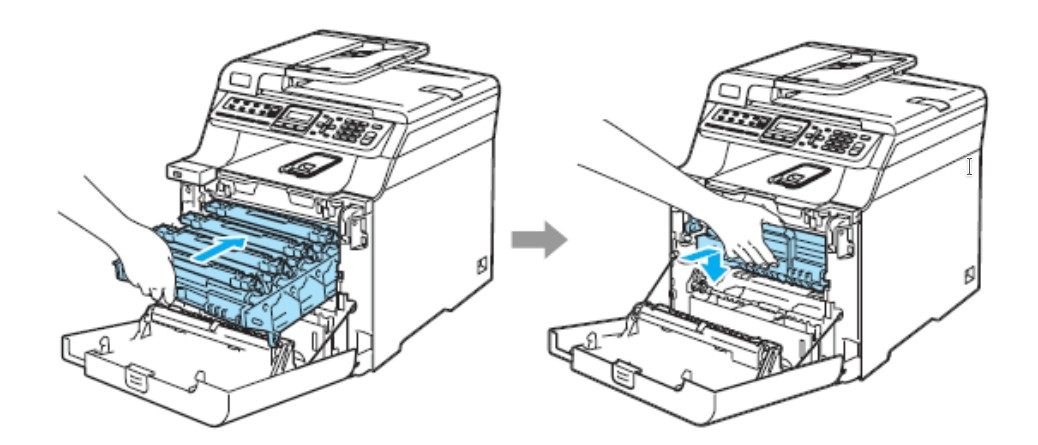

Czynność przedstawiona na ilustracjach dotyczy mocowania

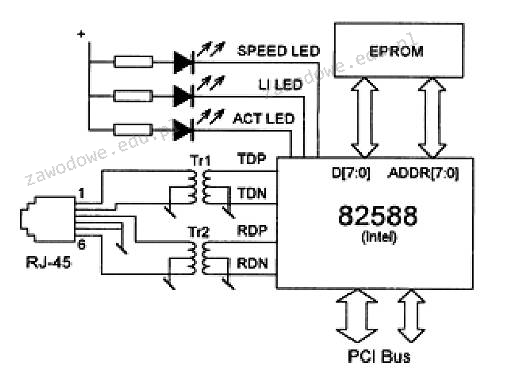

Jaką rolę pełnią elementy Tr1 i Tr2, które są widoczne na schemacie ilustrującym kartę sieciową Ethernet?

Wprowadzając w wierszu poleceń systemu Windows Server komendę convert, można wykonać

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Jakie aktywne urządzenie pozwoli na nawiązanie połączenia z lokalną siecią dla 15 komputerów, drukarki sieciowej oraz rutera, wykorzystując kabel UTP?

Za pomocą przedstawionego urządzenia można przeprowadzić diagnostykę działania

Który zakres adresów pozwala na komunikację multicast w sieciach z użyciem adresacji IPv6?

Jaką standardową wartość maksymalnej odległości można zastosować pomiędzy urządzeniami sieciowymi, które są ze sobą połączone przewodem UTP kat.5e?

Ilustracja pokazuje panel ustawień bezprzewodowego urządzenia dostępowego, który umożliwia

Aby zmierzyć moc zużywaną przez komputer, należy zastosować

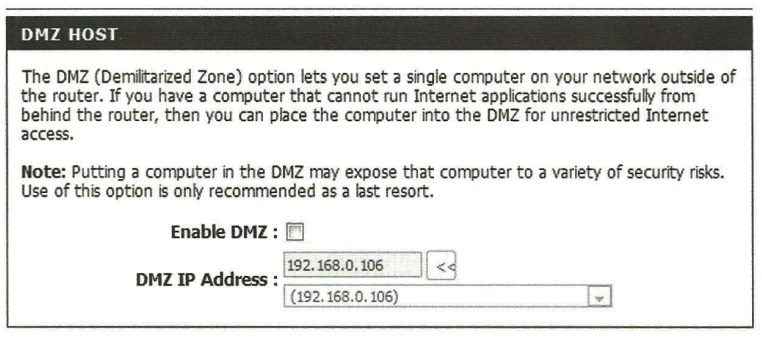

Na ilustracji zaprezentowano zrzut ekranu z ustawień DMZ na routerze. Aktywacja opcji "Enable DMZ" spowoduje, że komputer o adresie IP 192.168.0.106

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Które z poniższych kont nie jest wbudowane w system Windows XP?

Co oznacza dziedziczenie uprawnień?

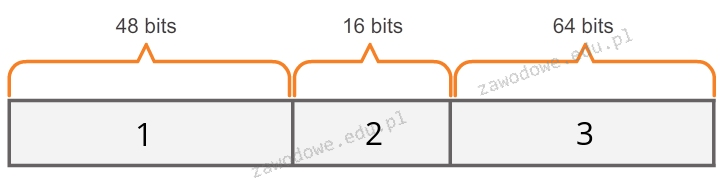

Jaką sekwencję mają elementy adresu globalnego IPv6 typu unicast ukazanym na diagramie?

Jaką funkcję pełni protokół ARP (Address Resolution Protocol)?

Jaki protokół jest stosowany do przesyłania danych w warstwie transportowej modelu ISO/OSI?

Jaki protokół służy do przesyłania plików bez konieczności tworzenia połączenia?

W przypadku dłuższych przestojów drukarki atramentowej, pojemniki z tuszem powinny