Pytanie 1

Jaką rolę pełni serwer FTP?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Jaką rolę pełni serwer FTP?

W celu zrealizowania instalacji sieciowej na stacjach roboczych z systemem operacyjnym Windows, należy na serwerze zainstalować usługi

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Elementem, który jest odpowiedzialny za utrwalanie tonera na kartce podczas drukowania z drukarki laserowej, jest

Zaproponowany fragment ustawień zapory sieciowej umożliwia przesył danych przy użyciu protokołów ```iptables -A INPUT --protocol tcp --dport 443 -j ACCEPT iptables -A INPUT --protocol tcp --dport 143 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 443 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 143 -j ACCEPT```

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Jak brzmi nazwa klucza rejestru w systemie Windows, gdzie zapisane są relacje między typami plików a programami je obsługującymi?

Jakie urządzenie powinno być zainstalowane w serwerze, aby umożliwić automatyczne archiwizowanie danych na taśmach magnetycznych?

Co należy zrobić przed przystąpieniem do prac serwisowych związanych z edytowaniem rejestru systemu Windows?

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Jakie informacje zwraca polecenie netstat -a w systemie Microsoft Windows?

Numer 22 umieszczony w adresie http://www.adres_serwera.pl:22 wskazuje na

W systemach operacyjnych Windows konto z najwyższymi uprawnieniami domyślnymi przynależy do grupy

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Papier termotransferowy to materiał eksploatacyjny stosowany w drukarkach

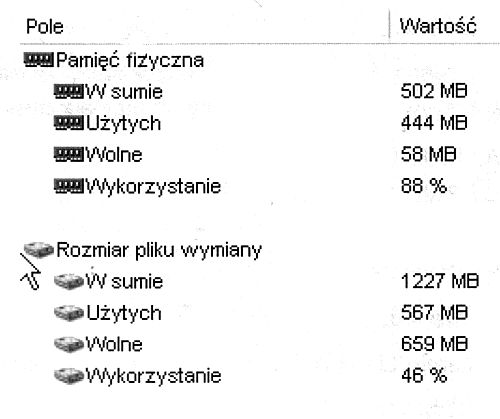

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

W sytuacji, gdy nie ma możliwości uruchomienia programu BIOS Setup, jak przywrócić domyślne ustawienia płyty głównej?

W której fizycznej topologii awaria jednego komputera powoduje przerwanie pracy całej sieci?

Interfejs SATA 2 (3 Gb/s) gwarantuje prędkość transferu

W systemach Windows profil użytkownika tymczasowego jest

Przerywając działalność na komputerze, możemy szybko wrócić do pracy, wybierając w systemie Windows opcję:

Który rodzaj złącza nie występuje w instalacjach światłowodowych?

Serwer zajmuje się rozgłaszaniem drukarek w sieci, organizowaniem zadań do wydruku oraz przydzielaniem uprawnień do korzystania z drukarek

Który protokół zamienia adresy IP na adresy MAC, używane w sieciach Ethernet?

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

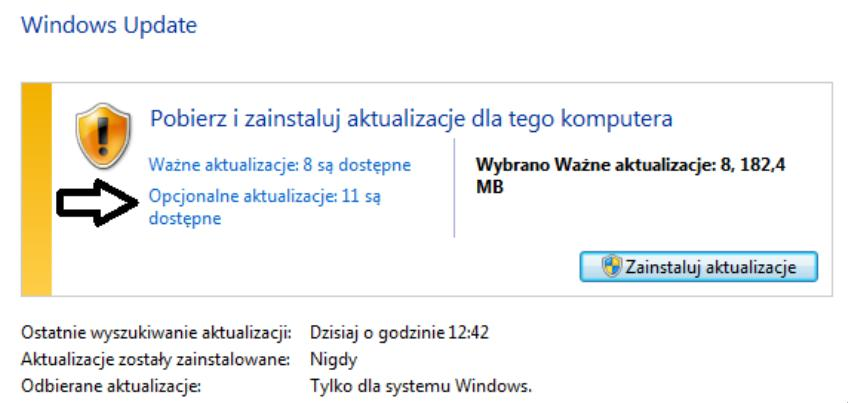

Jeżeli użytkownik zdecyduje się na pozycję wskazaną przez strzałkę, uzyska możliwość zainstalowania aktualizacji?

Martwy piksel, który jest defektem w monitorach LCD, to punkt, który ciągle ma ten sam kolor

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Gniazdo w sieciach komputerowych, które jednoznacznie identyfikuje dany proces na urządzeniu, stanowi kombinację

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Która operacja może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Jakie urządzenie powinno być użyte, aby poprawić zasięg sieci bezprzewodowej w obiekcie?

Który z parametrów twardego dysku NIE ma wpływu na jego wydajność?

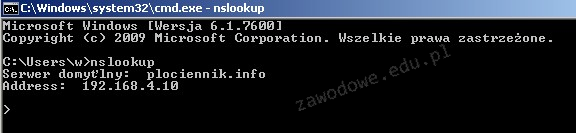

W terminalu systemu operacyjnego wydano komendę nslookup. Jakie dane zostały uzyskane?

Oprogramowanie, które jest dodatkiem do systemu Windows i ma na celu ochronę przed oprogramowaniem szpiegującym oraz innymi niechcianymi elementami, to

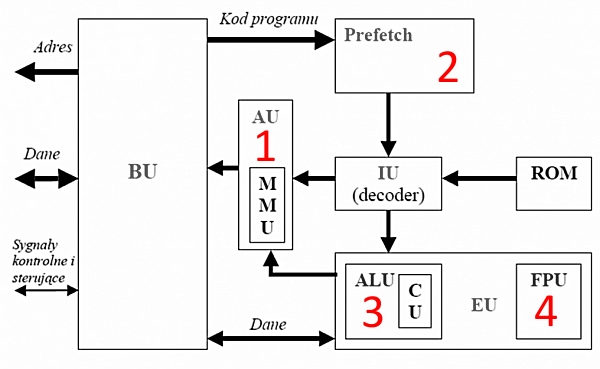

Koprocesor arytmetyczny, który pełni funkcję wykonywania obliczeń na liczbach zmiennoprzecinkowych w mikroprocesorze, został na schemacie oznaczony cyfrą

Wskaż procesor współpracujący z przedstawioną płytą główną.

Protokół transportowy bezpołączeniowy to

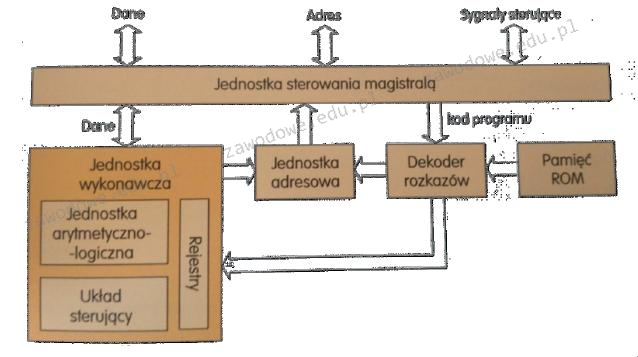

Na ilustracji przedstawiono schemat konstrukcji logicznej

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?