Pytanie 1

W systemie Linux narzędzie do śledzenia zużycia CPU, pamięci, procesów oraz obciążenia systemu z poziomu terminala to

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux narzędzie do śledzenia zużycia CPU, pamięci, procesów oraz obciążenia systemu z poziomu terminala to

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?

int a;

Podaną zmienną wyświetl na 2 sposoby.

W jakim systemie występuje jądro hybrydowe (kernel)?

W systemie Windows za pomocą komendy assoc można

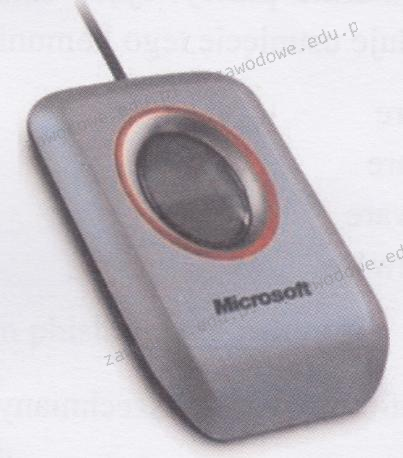

Urządzeniem peryferyjnym pokazanym na ilustracji jest skaner biometryczny, który wykorzystuje do identyfikacji

Co umożliwia zachowanie równomiernego rozkładu ciepła pomiędzy procesorem a radiatorem?

Pierwszą usługą, która jest instalowana na serwerze, to usługa domenowa w Active Directory. W trakcie instalacji kreator automatycznie poprosi o zainstalowanie usługi serwera.

Jaki będzie najniższy koszt zakupu kabla UTP, potrzebnego do okablowania kategorii 5e, aby połączyć panel krosowniczy z dwoma podwójnymi gniazdami natynkowymi 2 x RJ45, które są oddalone odpowiednio o 10 m i 20 m od panelu, jeśli cena 1 m kabla wynosi 1,20 zł?

Które z urządzeń sieciowych jest przedstawione na grafice?

Określenie najlepszej trasy dla połączenia w sieci to

Który z standardów korzysta z częstotliwości 5 GHz?

System limitów dyskowych, umożliwiający kontrolowanie wykorzystania zasobów dyskowych przez użytkowników, nazywany jest

Główny punkt, z którego odbywa się dystrybucja okablowania szkieletowego, to punkt

Główna rola serwera FTP polega na

Do przeprowadzenia ręcznej konfiguracji interfejsu sieciowego w systemie Linux konieczne jest użycie polecenia

Standard sieci bezprzewodowej WiFi 802.11 a/n operuje w zakresie

Ile warstw zawiera model ISO/OSI?

Aby umożliwić jedynie wybranym urządzeniom dostęp do sieci WiFi, konieczne jest w punkcie dostępowym

Który z poniższych adresów IP należy do grupy C?

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

Rysunek ilustruje rezultaty sprawdzania działania sieci komputerowej przy użyciu polecenia

Badanie wp.pl [212.77.100.101] z użyciem 32 bajtów danych: Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=27ms TTL=249

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby zaktualizować wszystkie pakiety (cały system) do najnowszej wersji, łącznie z nowym jądrem?

Przy zmianach w rejestrze Windows w celu zapewnienia bezpieczeństwa należy najpierw

Która z licencji ma charakter grupowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, państwowym i charytatywnym na zakup większej ilości oprogramowania firmy Microsoft na korzystnych zasadach?

Jaki port na tylnym panelu płyty głównej jest w dokumentacji określany jako port zgodny z normą RS232C?

Jakim interfejsem można osiągnąć przesył danych o maksymalnej przepustowości 6Gb/s?

Jakiego typu macierz RAID nie zapewnia odporności na awarie żadnego z dysków tworzących jej strukturę?

Osoba korzystająca z systemu Windows zdecydowała się na przywrócenie systemu do określonego punktu. Które pliki utworzone po tym punkcie NIE zostaną zmienione w wyniku tej operacji?

Który z wewnętrznych protokołów routingu bazuje na metodzie wektora odległości?

Impulsator pozwala na testowanie uszkodzonych systemów logicznych w komputerze, między innymi poprzez

Jak ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie funkcjonować w dwóch sieciach lokalnych o różnych adresach IP?

Narzędzie, które chroni przed nieautoryzowanym dostępem do sieci lokalnej, to

Podczas uruchamiania komputera ukazuje się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL skutkuje

Aby możliwe było skierowanie wydruku na twardy dysk, konieczne jest w ustawieniach drukarki wybranie opcji drukowania do portu

Do jakich celów powinno się aktywować funkcję RMON (Remote Network Monitoring) w przełączniku?

Zewnętrzny dysk 3,5 cala o pojemności 5 TB, przeznaczony do archiwizacji lub tworzenia kopii zapasowych, dysponuje obudową z czterema różnymi interfejsami komunikacyjnymi. Który z tych interfejsów powinno się użyć do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

Wskaż standard interfejsu stosowanego do przewodowego połączenia dwóch urządzeń.

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Której komendy wiersza poleceń z opcji zaawansowanych naprawy systemu Windows należy użyć, aby naprawić uszkodzony MBR dysku?