Pytanie 1

Ile pinów znajduje się w wtyczce SATA?

Wynik: 9/40 punktów (22,5%)

Wymagane minimum: 20 punktów (50%)

Ile pinów znajduje się w wtyczce SATA?

Urządzenie pokazane na ilustracji to

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Jakie informacje można uzyskać na temat konstrukcji skrętki S/FTP?

Gdy system operacyjny laptopa działa normalnie, na ekranie wyświetla się komunikat o konieczności sformatowania wewnętrznego dysku twardego. Może to sugerować

Industry Standard Architecture to standard magistrali, który określa, że szerokość szyny danych wynosi:

Które medium transmisyjne charakteryzuje się najmniejszym ryzykiem narażenia na zakłócenia elektromagnetyczne przesyłanego sygnału?

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

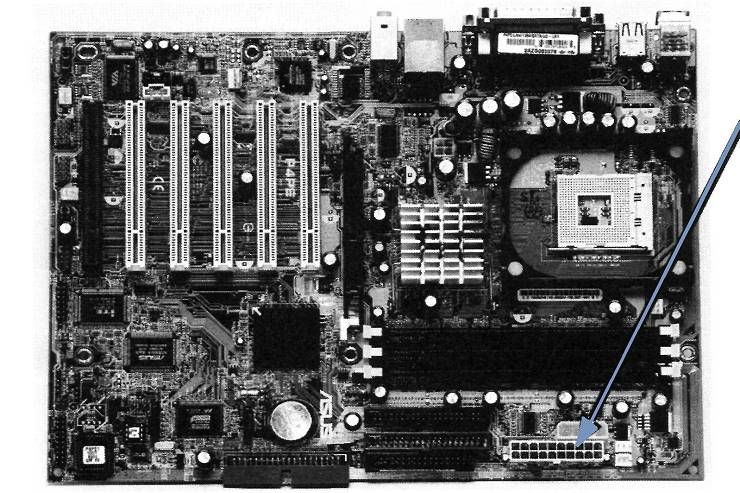

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

Urządzeniem wejściowym komputera, realizującym z najwyższą precyzją funkcje wskazujące w środowisku graficznym 3D, jest

Nośniki informacji, takie jak dyski twarde, zapisują dane w jednostkach zwanych sektorami, które mają wielkość

Który standard złącza DVI pozwala na przesyłanie wyłącznie sygnałów analogowych?

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

W systemie binarnym liczba 3FC7 będzie zapisana w formie:

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Zwiększenie zarówno wydajności operacji (zapis/odczyt), jak i bezpieczeństwa przechowywania danych jest możliwe dzięki zastosowaniu macierzy dyskowej

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

Instalacja systemów Linux oraz Windows 7 przebiegła bez problemów. Oba systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, o tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Jakie medium transmisyjne nosi nazwę 100BaseTX i jaka jest maksymalna prędkość danych, która może być w nim osiągnięta?

Czym wyróżniają się procesory CISC?

Na rysunku ukazany jest diagram blokowy zasilacza

Urządzenie warstwy dystrybucji, które umożliwia komunikację pomiędzy różnymi sieciami, to

Jakie urządzenie pozwoli na podłączenie drukarki, która nie jest wyposażona w kartę sieciową, do lokalnej sieci komputerowej?

Obniżenie ilości jedynek w masce pozwala na zaadresowanie

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

W jakim urządzeniu elektronicznym znajduje się układ RAMDAC?

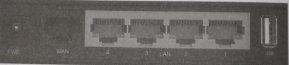

Na który port rutera należy podłączyć kabel od zewnętrznej sieci, aby uzyskać dostęp pośredni do Internetu?

Oblicz koszt brutto materiałów niezbędnych do połączenia w sieć w topologii gwiazdy 3 komputerów wyposażonych w karty sieciowe, wykorzystując przewody o długości 2m. Ceny materiałów podano w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu "skrętka" | 1 zł za 1 metr |

Podczas uruchamiania (krótko po zakończeniu testu POST) komputer się zawiesza. Jakie mogą być możliwe przyczyny tej awarii?

Brak odpowiedzi na to pytanie.

Aby osiągnąć przepustowość 4 GB/s w obydwie strony, konieczne jest zainstalowanie w komputerze karty graficznej używającej interfejsu

Brak odpowiedzi na to pytanie.

Jakie urządzenie jest kluczowe dla połączenia pięciu komputerów w sieci o strukturze gwiazdy?

Brak odpowiedzi na to pytanie.

Co symbolizuje graficzny znak przedstawiony na ilustracji?

Brak odpowiedzi na to pytanie.

Który z poniższych elementów jest częścią mechanizmu drukarki atramentowej?

Brak odpowiedzi na to pytanie.

Wtyczka zasilająca SATA ma uszkodzony żółty przewód. Jakie to niesie za sobą konsekwencje dla napięcia na złączu?

Brak odpowiedzi na to pytanie.

W systemie operacyjnym pojawił się problem z driverem TWAIN, który może uniemożliwiać prawidłowe funkcjonowanie

Brak odpowiedzi na to pytanie.

Tryb pracy portu równoległego, bazujący na magistrali ISA, umożliwiający transfer danych do 2,4 MB/s, dedykowany dla skanerów i urządzeń wielofunkcyjnych, to

Brak odpowiedzi na to pytanie.

W hurtowni materiałów budowlanych zachodzi potrzeba równoczesnego wydruku faktur w kilku kopiach. Jakiej drukarki należy użyć?

Brak odpowiedzi na to pytanie.

Proporcja ładunku zgromadzonego na przewodniku do potencjału tego przewodnika definiuje jego

Brak odpowiedzi na to pytanie.

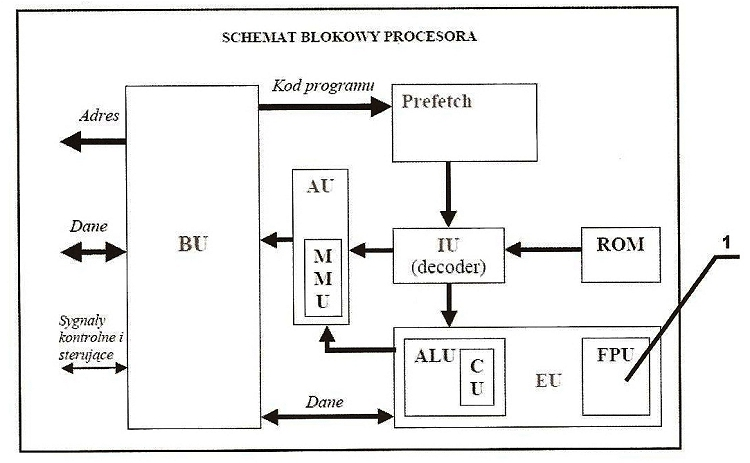

Element oznaczony numerem 1 w schemacie blokowym procesora pełni funkcję

Brak odpowiedzi na to pytanie.

Znak przedstawiony na ilustracji, zgodny z normą Energy Star, wskazuje na urządzenie

Brak odpowiedzi na to pytanie.