Pytanie 1

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

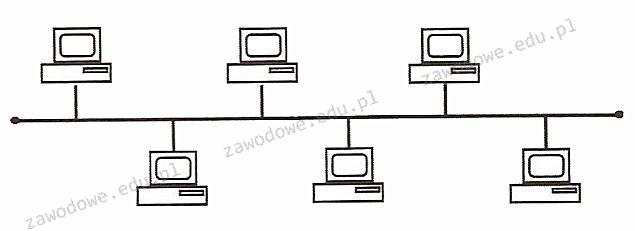

Na ilustracji zaprezentowano układ

Jak określa się typ licencji, który pozwala na pełne korzystanie z programu, lecz można go uruchomić tylko przez ograniczoną, niewielką liczbę razy od momentu instalacji?

Usługi na serwerze są konfigurowane za pomocą

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Przerywając działalność na komputerze, możemy szybko wrócić do pracy, wybierając w systemie Windows opcję:

Odmianą pamięci, która zapewnia tylko odczyt i może być usunięta przy użyciu światła ultrafioletowego, jest pamięć

Co oznacza standard 100Base-T?

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się operacje usuwania starych plików oraz dodawania nowych, staje się:

Jakiego rodzaju złącze powinna mieć płyta główna, aby umożliwić zainstalowanie karty graficznej przedstawionej na rysunku?

Aby chronić konto użytkownika przed nieautoryzowanymi zmianami w systemie Windows 7, 8 lub 10, które wymagają uprawnień administratora, należy ustawić

Które urządzenie należy zainstalować, w celu zwiększenia obszaru zasięgu sieci bezprzewodowej?

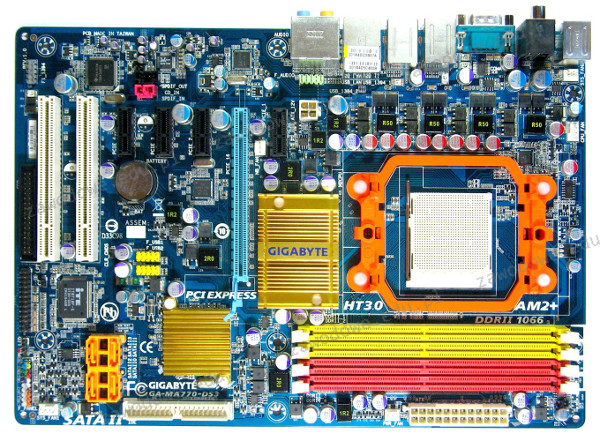

Jakie złącze umożliwia przesył danych między przedstawioną na ilustracji płytą główną a urządzeniem zewnętrznym, nie dostarczając jednocześnie zasilania do tego urządzenia przez interfejs?

Zaprezentowane właściwości karty sieciowej sugerują, że karta

| Kod Producenta | WN-370USB |

| Interfejs | USB |

| Zgodność ze standardem | IEEE 802.11 b/g/n |

| Ilość wyjść | 1 szt. |

| Zabezpieczenia | WEP 64/128, WPA, WPA2 |

| Wymiary | 49(L) x 26(W) x 10(H) mm |

Czy możesz wskazać, jak wygląda zapis maski podsieci /23 w systemie dziesiętnym, wiedząc, że pierwsze 23 bity z 32-bitowej liczby binarnej to jedynki, a pozostałe to zera? Każdemu z kolejnych 8 bitów odpowiada jedna liczba dziesiętna?

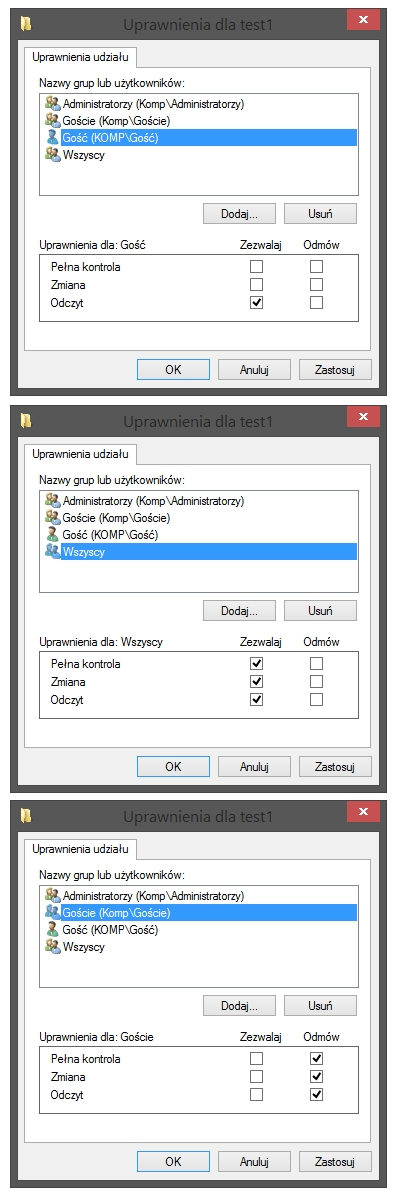

Użytkownik o nazwie Gość jest częścią grupy Goście, która z kolei należy do grupy Wszyscy. Jakie uprawnienia do folderu test1 ma użytkownik Gość?

Na przedstawionym rysunku zaprezentowane jest złącze

Administrator sieci LAN dostrzegł przełączenie w tryb awaryjny urządzenia UPS. To oznacza, że wystąpiła awaria systemu

Jakie narzędzie powinno być użyte do uzyskania rezultatów testu POST dla komponentów płyty głównej?

Liczba 100110011 zapisana w systemie ósemkowym wynosi

Którą czynność należy wykonać podczas konfiguracji rutera, aby ukryta sieć bezprzewodowa była widoczna dla wszystkich użytkowników znajdujących się w jej zasięgu?

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Zidentyfikuj najprawdopodobniejszą przyczynę pojawienia się komunikatu "CMOS checksum error press F1 to continue press DEL to setup" podczas uruchamiania systemu komputerowego?

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

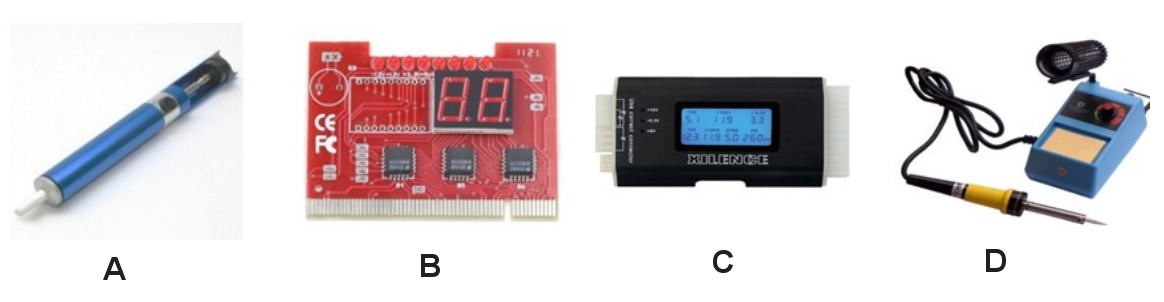

Na przedstawionej grafice wskazano strzałkami funkcje przycisków umieszczonych na obudowie projektora multimedialnego. Dzięki tym przyciskom można

Jeżeli w konfiguracji karty graficznej zostanie wybrane odświeżanie obrazu większe od zalecanego, monitor CRT spełniający normy TCO 99

W architekturze sieci lokalnych opartej na modelu klient-serwer

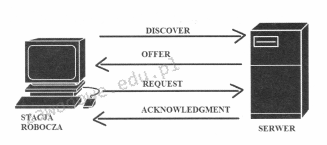

Którego protokołu działanie zostało zobrazowane na załączonym rysunku?

Wykorzystując narzędzie diagnostyczne Tracert, można zidentyfikować trasę do określonego celu. Ile routerów pokonał pakiet wysłany do hosta 172.16.0.99?

Jaki protokół służy komputerom do informowania rutera o przynależności do konkretnej grupy multicastowej?

Jak w systemie Windows Professional można ustalić czas działania drukarki oraz jej uprawnienia do drukowania?

Diagnostykę systemu Linux można przeprowadzić używając polecenia

Architecture: x86_64 CPU op-mode(s): 32-bit, 64-bit Byte Order: Little Endian CPU(s): 8 On-line CPU(s) list: 0-7 Thread(s) per core: 2 Core(s) per socket: 4 Socket(s): 1 NUMA node(s): 1 Vendor ID: GenuineIntel CPU family: 6 Model: 42 Stepping: 7 CPU MHz: 1600.000 BogoMIPS: 6784.46 Virtualization: VT-x L1d cache: 32K L1i cache: 32K L2 cache: 256K L3 cache: 8192K NUMA node0 CPU(s): 0-7

Aby monitorować przesył danych w sieci komputerowej, należy wykorzystać program klasy

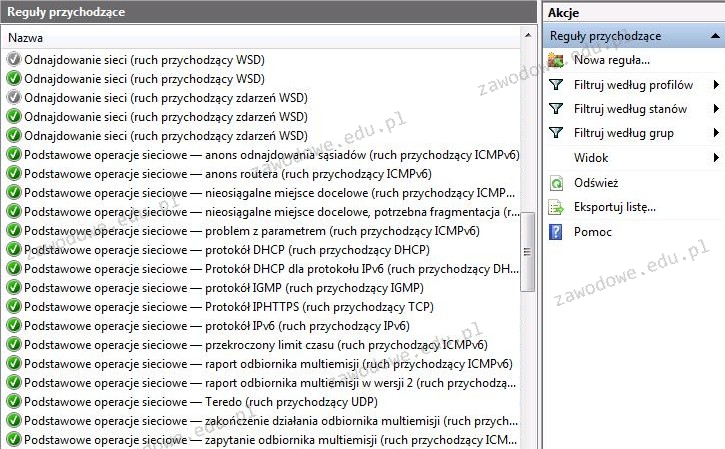

Zrzut ekranu ilustruje aplikację

Układ cyfrowy wykonujący operację logiczną koniunkcji opiera się na bramce logicznej

Który protokół służy do wymiany danych o trasach oraz dostępności sieci pomiędzy routerami w ramach tego samego systemu autonomicznego?

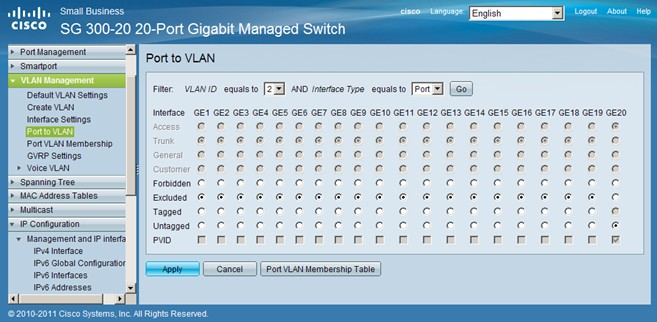

Na ilustracji przedstawiono

Serwer zajmuje się rozgłaszaniem drukarek w sieci, organizowaniem zadań do wydruku oraz przydzielaniem uprawnień do korzystania z drukarek

Na ilustracji ukazano sieć o układzie