Pytanie 1

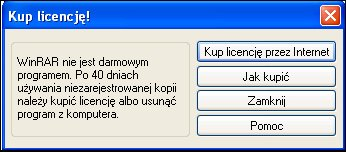

Program WinRaR zaprezentował okno informacyjne widoczne na ilustracji. Jakiego rodzaju licencji na program używał do tej pory użytkownik?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Program WinRaR zaprezentował okno informacyjne widoczne na ilustracji. Jakiego rodzaju licencji na program używał do tej pory użytkownik?

Do wyświetlenia daty w systemie Linux można wykorzystać polecenie

Jakie informacje można uzyskać za pomocą programu Wireshark?

System S.M.A.R.T. jest wykorzystywany do nadzorowania działania oraz identyfikacji usterek

Rzeczywistą kalibrację sprzętową monitora można wykonać

Jakie przyporządkowanie: urządzenie - funkcja, którą pełni, jest błędne?

Który z protokołów zapewnia bezpieczne połączenie między klientem a witryną internetową banku, zachowując prywatność użytkownika?

W wyniku realizacji podanego polecenia ping parametr TTL wskazuje na

C:\Users\Właściciel>ping -n 1 wp.pl

Pinging wp.pl [212.77.98.9] with 32 bytes of data:

Reply from 212.77.98.9: bytes=32 time=17ms TTL=54

Ping statistics for 212.77.98.9:

Packets: Sent = 1, Received = 1, Lost = 0 (0% loss),

Approximate round trip times in milli-seconds:

Minimum = 17ms, Maximum = 17ms, Average = 17msPolecenie uname -s w systemie Linux jest wykorzystywane do sprawdzenia

Do umożliwienia komunikacji pomiędzy sieciami VLAN, wykorzystuje się

Aby poprawić bezpieczeństwo prywatnych danych sesji na stronie internetowej, zaleca się dezaktywację w ustawieniach przeglądarki

Kiedy dysze w drukarce atramentowej wyschną z powodu długotrwałych przerw w użytkowaniu, co powinno się najpierw wykonać?

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Protokół ARP (Address Resolution Protocol) służy do konwersji adresu IP na

Który z poniższych protokołów nie jest wykorzystywany do konfiguracji wirtualnej sieci prywatnej?

Użycie skrętki kategorii 6 (CAT 6) o długości 20 metrów w sieci LAN wskazuje na jej maksymalną przepustowość wynoszącą

Jaki rodzaj fizycznej topologii w sieciach komputerowych jest pokazany na ilustracji?

Która z anten cechuje się najwyższym zyskiem mocy i pozwala na nawiązanie łączności na dużą odległość?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

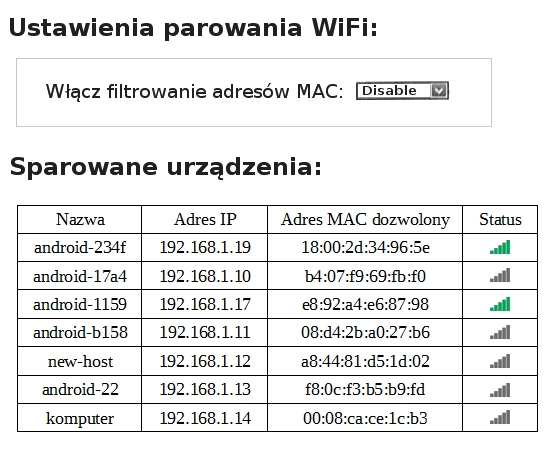

Na rysunku przedstawiono konfigurację urządzenia WiFi. Wskaż, które z poniższych stwierdzeń dotyczących tej konfiguracji jest poprawne?

Które z poniższych stwierdzeń dotyczących konta użytkownika Active Directory w systemie Windows jest prawdziwe?

Który z poniższych adresów IPv4 należy do klasy C?

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Na którym z domyślnych portów realizowana jest komunikacja protokołu ftp?

Jakie czynności nie są realizowane przez system operacyjny?

Które medium transmisyjne umożliwia izolację galwaniczną pomiędzy systemami przesyłu danych?

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Liczba \( 10_{D} \) w systemie uzupełnień do dwóch jest równa

Którą czynność należy wykonać podczas konfiguracji rutera, aby ukryta sieć bezprzewodowa była widoczna dla wszystkich użytkowników znajdujących się w jej zasięgu?

Ustawienie rutingu statycznego na ruterze polega na

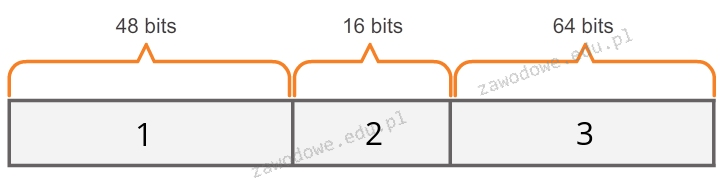

Jaką sekwencję mają elementy adresu globalnego IPv6 typu unicast ukazanym na diagramie?

Osoba korzystająca z systemu operacyjnego Linux pragnie przypisać adres IP 152.168.1.200 255.255.0.0 do interfejsu sieciowego. Jakie polecenie powinna wydać, mając uprawnienia administratora?

Układy sekwencyjne stworzone z grupy przerzutników, zazwyczaj synchronicznych typu D, wykorzystywane do magazynowania danych, to

Jakie narzędzie pozwala na zarządzanie menedżerem rozruchu w systemach Windows od wersji Vista?

Jaką długość ma maska sieci dla adresów z klasy B?

Ile maksymalnie hostów można przydzielić w sieci o masce 255.255.255.192?

Jakie narzędzie jest używane do diagnozowania łączności między hostami w systemie Windows?

W dwóch sąsiadujących pomieszczeniach w pewnej firmie występują bardzo silne zakłócenia elektromagnetyczne. Aby osiągnąć jak największą przepustowość podczas działania istniejącej sieci LAN, jakie medium transmisyjne powinno zostać użyte?

Jakie polecenie w systemie operacyjnym Windows służy do wyświetlenia konfiguracji interfejsów sieciowych?

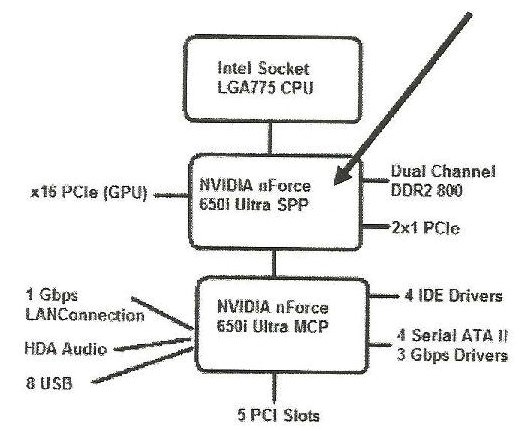

Jaką rolę pełni komponent wskazany strzałką na schemacie chipsetu płyty głównej?