Pytanie 1

Co nie ma wpływu na utratę danych z dysku HDD?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Co nie ma wpływu na utratę danych z dysku HDD?

Licencja CAL (Client Access License) uprawnia użytkownika do

Aby zapobiec uszkodzeniom układów scalonych przy serwisie sprzętu komputerowego, należy korzystać z

Która licencja pozwala na darmowe korzystanie z programu, pod warunkiem, że użytkownik dba o środowisko naturalne?

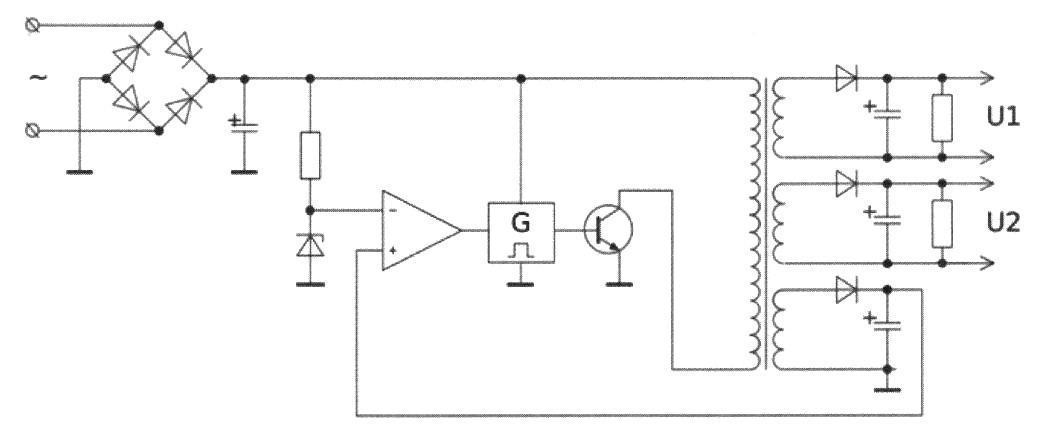

Na rysunku zobrazowano schemat

Nośniki informacji, takie jak dyski twarde, zapisują dane w jednostkach zwanych sektorami, które mają wielkość

Która z wymienionych technologii pamięci RAM wykorzystuje oba zbocza sygnału zegarowego do przesyłania danych?

Jaki protokół stosują komputery, aby informować rutera o przynależności do konkretnej grupy multicastowej?

Adres IP (ang. Internet Protocol Address) to

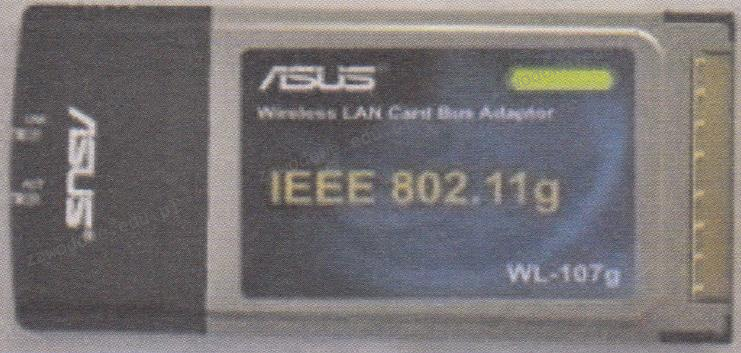

Standard IEEE 802.11 określa typy sieci

Która z usług umożliwia rejestrowanie oraz identyfikowanie nazw NetBIOS jako adresów IP wykorzystywanych w sieci?

Który z poniższych protokołów służy do zarządzania urządzeniami w sieciach?

Jak określa się atak w sieci lokalnej, który polega na usiłowaniu podszycia się pod inną osobę?

Aby zweryfikować mapę połączeń kabla UTP Cat 5e w sieci lokalnej, konieczne jest wykorzystanie

Na rysunkach technicznych dotyczących instalacji sieci komputerowej oraz dedykowanej instalacji elektrycznej, symbolem pokazanym na rysunku oznaczane jest gniazdo

Jakie jest właściwe IP dla maski 255.255.255.0?

Karta sieciowa przedstawiona na ilustracji ma zdolność przesyłania danych z maksymalną prędkością

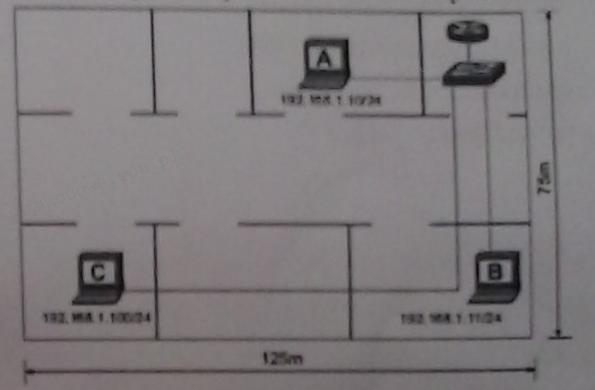

Na ilustracji przedstawiono sieć lokalną zbudowaną na kablach kat. 6. Stacja robocza "C" nie ma możliwości komunikacji z siecią. Jaki problem w warstwie fizycznej może powodować brak połączenia?

Po zainstalowaniu aplikacji VNC, używanej do obserwacji pulpitu konkretnego komputera, oprócz numeru portu należy wskazać jego

Program iftop działający w systemie Linux ma na celu

Zaproponowany fragment ustawień zapory sieciowej umożliwia przesył danych przy użyciu protokołów ```iptables -A INPUT --protocol tcp --dport 443 -j ACCEPT iptables -A INPUT --protocol tcp --dport 143 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 443 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 143 -j ACCEPT```

Wskaż sygnał, który wskazuje na uszkodzenie karty graficznej w komputerze z BIOS POST od firmy AWARD?

To narzędzie może być wykorzystane do

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Bez zgody właściciela praw autorskich do oprogramowania jego legalny użytkownik, zgodnie z ustawą o prawie autorskim i prawach pokrewnych, co może zrobić?

Jakim protokołem łączności, który gwarantuje pewne dostarczenie informacji, jest protokół

Na podstawie wyników działania narzędzia diagnostycznego chkdsk, które są przedstawione na zrzucie ekranu, jaka jest wielkość pojedynczego klastra na dysku?

Typ systemu plików to FAT32.

Wolumin FTP utworzono 12-11-2005 18:31

Numer seryjny woluminu: 3CED-3B31

Trwa sprawdzanie plików i folderów...

Zakończono sprawdzanie plików i folderów.

Trwa sprawdzanie wolnego miejsca na dysku...

Zakończono sprawdzanie wolnego miejsca na dysku.

System Windows sprawdził system plików i nie znalazł żadnych problemów.

8 233 244 KB całkowitego miejsca na dysku.

1 KB w 13 plikach ukrytych.

2 KB w 520 folderach.

1 537 600 KB w 4 952 plikach.

6 690 048 KB jest dostępnych.

4 096 bajtów w każdej jednostce alokacji.

2 058 311 ogółem jednostek alokacji na dysku.

1 672 512 jednostek alokacji dostępnych na dysku.

C:\>

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

Określ najprawdopodobniejszą przyczynę pojawienia się komunikatu: CMOS checksum error press F1 to continue press DEL to setup podczas uruchamiania systemu

Która z poniższych czynności NIE przyczynia się do personalizacji systemu operacyjnego Windows?

Na ilustracji widać

W sieci komputerowej działającej pod systemem Linux do udostępniania drukarek można zastosować serwer

Wskaź 24-pinowe lub 29-pinowe złącze żeńskie, które jest w stanie przesyłać skompresowany sygnał cyfrowy do monitora?

Co należy zrobić w pierwszej kolejności, gdy dysza w drukarce atramentowej jest zaschnięta z powodu długotrwałych przestojów?

NAT64 (Network Address Translation 64) to proces, który przekształca adresy

Aby bezpośrednio połączyć dwa komputery w przewodowej sieci LAN, należy zastosować

Jakiego parametru w poleceniu ping należy użyć, aby uzyskać rezultat pokazany na zrzucie ekranu?

Przedstawione narzędzie podczas naprawy zestawu komputerowego przeznaczone jest do

Magistrala PCI-Express wykorzystuje do transmisji danych metodę komunikacji

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona