Pytanie 1

Podaj poprawną sekwencję czynności, które należy wykonać, aby przygotować nowy laptop do użycia.

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Podaj poprawną sekwencję czynności, które należy wykonać, aby przygotować nowy laptop do użycia.

Urządzeniem, które służy do wycinania kształtów oraz grawerowania między innymi w materiałach drewnianych, szklanych i metalowych, jest ploter

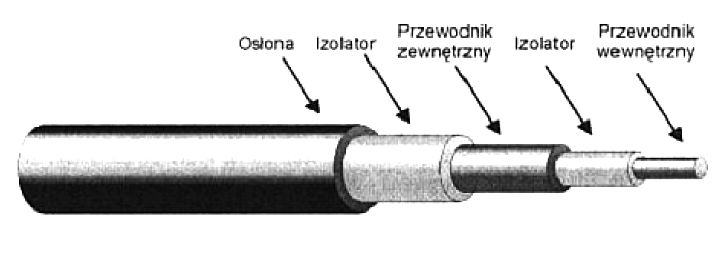

Na ilustracji pokazano przekrój kabla

Która z opcji konfiguracji ustawień konta użytkownika o ograniczonych uprawnieniach w systemie Windows jest dostępna dzięki narzędziu secpol?

Ustalenie adresów fizycznych MAC na podstawie adresów logicznych IP jest efektem działania protokołu

Aby umożliwić transfer danych między siecią w pracowni a siecią ogólnoszkolną o innej adresacji IP, należy zastosować

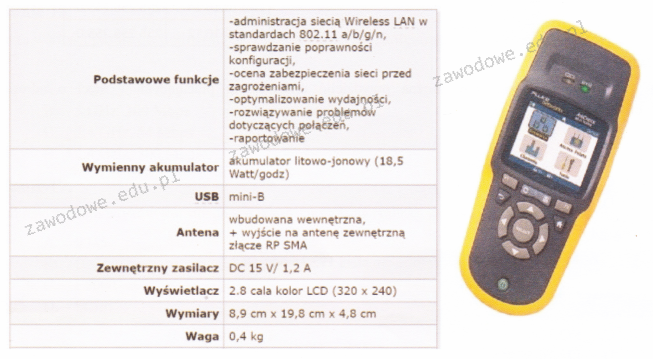

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Na zdjęciu ukazano złącze zasilające

Wskaż złącze, które nie jest stosowane w zasilaczach ATX?

Producent wyświetlacza LCD stwierdził, że spełnia on wymagania klasy II według normy ISO 13406-2. Na podstawie danych przedstawionych w tabeli określ, ile pikseli z defektem typu 3 musi wystąpić na wyświetlaczu o naturalnej rozdzielczości 1280x800 pikseli, aby uznać go za uszkodzony?

| Klasa | Maksymalna liczba dopuszczalnych błędów na 1 milion pikseli | ||

|---|---|---|---|

| Typ 1 | Typ 2 | Typ 3 | |

| I | 0 | 0 | 0 |

| II | 2 | 2 | 5 |

| III | 5 | 15 | 50 |

| IV | 50 | 150 | 500 |

Użytkownik napotyka trudności przy uruchamianiu systemu Windows. W celu rozwiązania tego problemu, skorzystał z narzędzia System Image Recovery, które

W jakim systemie operacyjnym występuje mikrojądro?

Jak zapisuje się liczbę siedem w systemie ósemkowym?

Ile bitów minimum będzie wymaganych w systemie binarnym do zapisania liczby szesnastkowej 110ₕ?

Podstawowym celem użycia przełącznika /renew w poleceniu ipconfig w systemie Windows jest

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakiego typu transmisję danych przesyłanych za pomocą interfejsu komputera osobistego pokazano na ilustracji?

| Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit stopu |

Przesyłanie informacji przy użyciu fal radiowych w pasmie ISM odbywa się w standardzie

ACPI to interfejs, który pozwala na

Symbol przedstawiony na ilustracji wskazuje na produkt

Medium transmisyjne, które jest odporne na zakłócenia elektromagnetyczne i atmosferyczne, to

Jaką liczbę dziesiętną reprezentuje liczba 11110101U2)?

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału pomiędzy segmentami sieci lub jego blokowaniu?

Norma TIA/EIA-568-B.2 definiuje parametry specyfikacji transmisyjnej

Jakie urządzenie pozwala na podłączenie kabla światłowodowego wykorzystywanego w okablowaniu pionowym sieci do przełącznika z jedynie gniazdami RJ45?

W sieciach opartych na standardzie, jaką metodę dostępu do medium wykorzystuje CSMA/CA?

Do jakiej warstwy modelu ISO/OSI odnosi się segmentacja danych, komunikacja w trybie połączeniowym przy użyciu protokołu TCP oraz komunikacja w trybie bezpołączeniowym z protokołem UDP?

Dobrze zaplanowana sieć komputerowa powinna pozwalać na rozbudowę, co oznacza, że musi charakteryzować się

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Do czego służy program CHKDSK?

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Przed dokonaniem zakupu komponentu komputera lub urządzenia peryferyjnego na platformach aukcyjnych, warto zweryfikować, czy nabywane urządzenie ma wymagany w Polsce certyfikat

Po podłączeniu działającej klawiatury do jednego z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Mimo to po uruchomieniu systemu w standardowym trybie klawiatura funkcjonuje prawidłowo. Co to oznacza?

W wyniku polecenia net accounts /MINPWLEN:11 w systemie Windows, wartość 11 będzie przypisana do

Ile jest klawiszy funkcyjnych na klawiaturze w układzie QWERTY?

Oznaczenie CE świadczy o tym, że

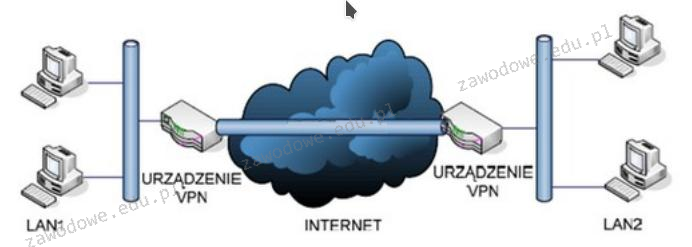

Schemat ilustruje zasadę funkcjonowania sieci VPN o nazwie

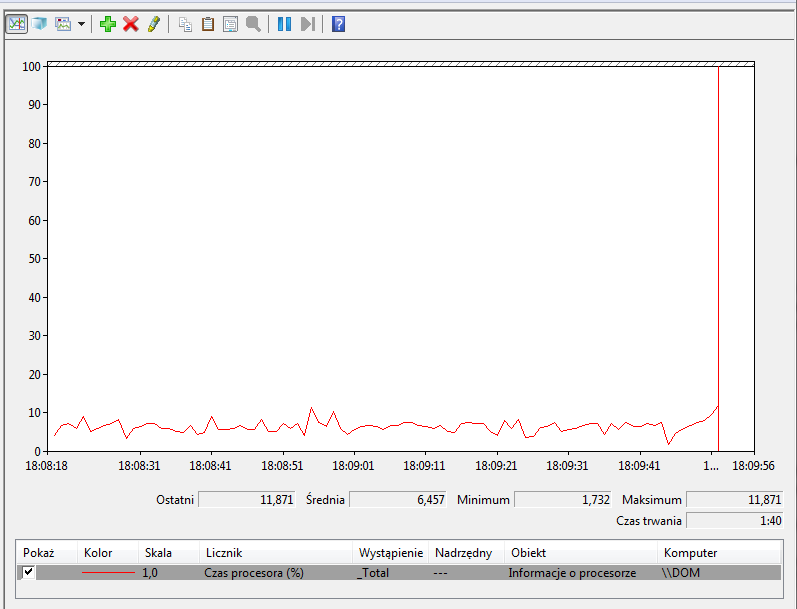

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

Nośniki informacji, takie jak dysk twardy, gromadzą dane w jednostkach określanych jako sektory, których rozmiar wynosi