Pytanie 1

W badaniu EEG elektrody referencyjne przymocowane do płatka ucha to

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

W badaniu EEG elektrody referencyjne przymocowane do płatka ucha to

Rumień skóry pojawiający się podczas radioterapii jest objawem

Pomiaru impedancji akustycznej ucha środkowego dokonuje się podczas badania

Który detektor w radiografii wymaga laserowego czytnika obrazu?

Na obrazie ultrasonograficznym jamy brzusznej uwidoczniono

W badaniu PET stosuje się tylko radioizotopy emitujące

Powierzchnia gabinetu rentgenowskiego, w którym zainstalowany jest aparat rentgenowski wyposażony w oddzielną lampę, nie może być mniejsza niż

Źródłem promieniowania protonowego stosowanego w radioterapii jest

Wskaż przyczynę powstania artefaktu widocznego na obrazie MR.

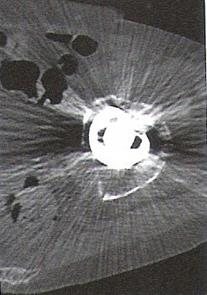

Zarejestrowany na obrazie TK artefakt jest spowodowany

Droga przewodnictwa powietrznego fali akustycznej przebiega przez

Wyniosłość międzykłykciowa znajduje się na nasadzie

Warstwa półchłonna (WP) jest wyrażona w mm Cu dla

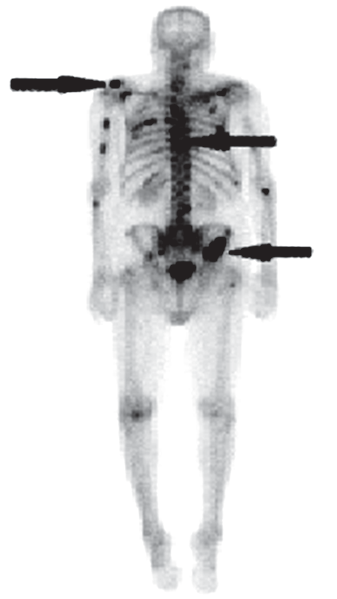

Na scyntygramie kości strzałkami oznaczono ogniska

Strzykawka automatyczna do podawania kontrastu jest stosowana przy wykonywaniu

W brachyterapii MDR stosowane są dawki promieniowania

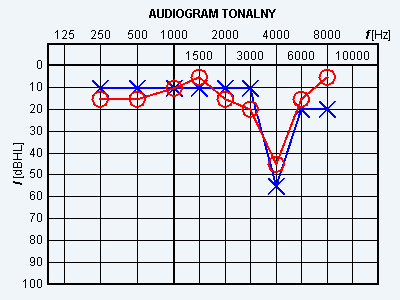

Wynik badania słuchu metodą audiometrii tonalnej wskazuje na

W obrazowaniu MR do uwidocznienia naczyń krwionośnych jest stosowana sekwencja

Największa wartość energii promieniowania stosowanego w radioterapii jest generowana przy użyciu

Wiązka elektronów najczęściej stosowana jest do leczenia zmian nowotworowych w obrębie

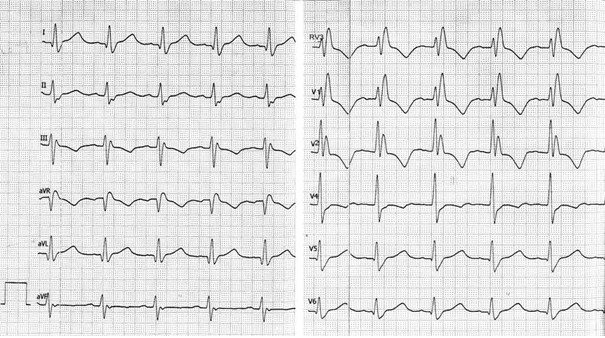

W badaniu EKG odprowadzenie I rejestruje różnicę potencjałów między

Które czynności wykonuje technik elektroradiolog w pracowni „gorącej”?

Podczas wykonywania zdjęcia rentgenowskiego lewobocznego czaszki promień centralny powinien przebiegać

Jaka jest odległość pomiędzy źródłem promieniowania a powierzchnią ciała pacjenta w technice izocentrycznej radioterapii?

Po wykonanej radioterapii do dokumentacji pacjenta należy wpisać dawkę promieniowania w jednostce

W standardowym badaniu elektrokardiograficznym elektrodę C4 należy umieścić

Do prób aktywacyjnych stosowanych w badaniu EEG zalicza się

Testy podstawowe z zakresu geometrii pola rentgenowskiego, przeznaczone do sprawdzenia zgodności pola wiązki promieniowania rentgenowskiego z symulacją świetlną, są wykonywane raz

Zgodnie ze standardami do wykonania zdjęcia bocznego czaszki, należy zastosować kasetę o wymiarze

Testy specjalistyczne aparatów rentgenowskich do zdjęć wewnątrzustnych są przeprowadzane

Dobierz dla standardowego pacjenta projekcję, pozycję i sposób ułożenia kasety o wymiarach 30 cm × 40 cm do zdjęcia przeglądowego układu moczowego.

| Projekcja | Pozycja | Ułożenie kasety | |||

|---|---|---|---|---|---|

| 1. | AP | 3. | stojąca | 5. | poprzeczne |

| 2. | PA | 4. | leżąca | 6. | podłużne |

Glukoza podawana pacjentowi w badaniu PET jest znakowana radioaktywnym

Zamieszczony rentgenogram został zarejestrowany podczas wykonania

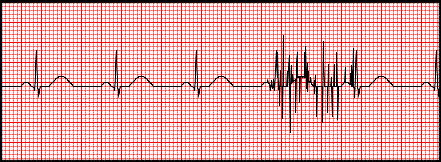

Przedstawiony zapis elektrokardiograficzny może wskazywać na

Wskazaniem do wykonania scyntygrafii perfuzyjnej jest

Podczas którego badania zostały zarejestrowane przedstawione obrazy?

Artefakty zarejestrowane na elektrokardiogramie zostały wywołane przez

Badanie przewodu pokarmowego metodą podwójnego kontrastu wiąże się z podaniem pacjentowi

Rytm alfa i beta rejestruje się podczas badania

Co określa M₀ w systemie klasyfikacji nowotworów TNM?