Pytanie 1

W trakcie instalacji oraz konfiguracji serwera DHCP w systemach z rodziny Windows Server istnieje możliwość dodania zastrzeżeń adresów, które określą

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

W trakcie instalacji oraz konfiguracji serwera DHCP w systemach z rodziny Windows Server istnieje możliwość dodania zastrzeżeń adresów, które określą

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W przypadku zalania układu elektronicznego klawiatury słodkim napojem należy natychmiast odłączyć ją od zestawu komputerowego, a następnie

Protokół ARP (Address Resolution Protocol) pozwala na przekształcanie logicznych adresów z warstwy sieciowej na fizyczne adresy z warstwy

Które z poniższych stwierdzeń dotyczących konta użytkownika Active Directory w systemie Windows jest prawdziwe?

Czym jest postcardware?

W systemie Linux narzędzie, które umożliwia śledzenie trasy pakietów od źródła do celu, pokazując procentowe straty oraz opóźnienia, to

Który interfejs bezprzewodowy, komunikacji krótkiego zasięgu pomiędzy urządzeniami elektronicznymi, korzysta z częstotliwości 2,4 GHz?

Serwer, który realizuje żądania w protokole komunikacyjnym HTTP, to serwer

Użytkownik chce tak zmodernizować komputer, aby działały na nim gry wymagające DirectX12. Jaki system operacyjny powinien zakupić do modernizowanego komputera, aby wspierał DX12?

Oprogramowanie komputerowe, które można używać bezpłatnie i bez czasowych ograniczeń, jest udostępniane na mocy licencji typu

Parametry katalogowe przedstawione w ramce dotyczą dysku twardego

| ST31000528AS |

| Seagate Barracuda 7200.12 ,32 MB, |

| Serial ATA/300, Heads 4, Capacity 1TB |

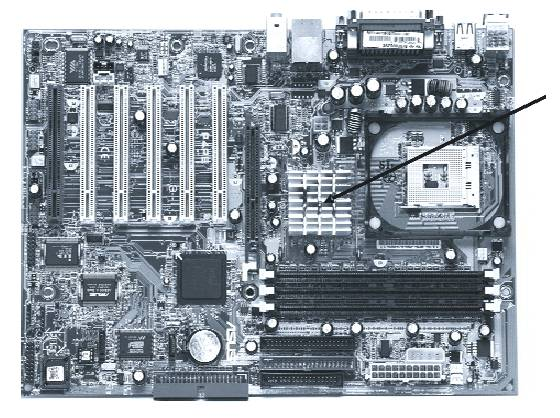

Na ilustracji pokazano płytę główną komputera. Strzałką wskazano

Z informacji przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi

| 184 styki |

| 64-bitowa szyna danych |

| Pojemność 1024 MB |

| Przepustowość 3200 MB/s |

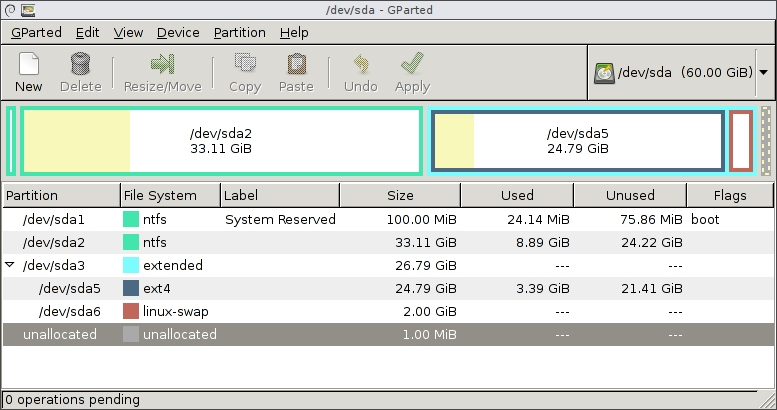

Badanie danych przedstawionych przez program umożliwia dojście do wniosku, że

Aby chronić konto użytkownika przed nieautoryzowanymi zmianami w systemie Windows 7, 8 lub 10, które wymagają uprawnień administratora, należy ustawić

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który zmusza go do automatycznej aktualizacji, są

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Ile maksymalnie podstawowych partycji możemy stworzyć na dysku twardym używając MBR?

Poprzez użycie opisanego urządzenia możliwe jest wykonanie diagnostyki działania

Jakie zastosowanie ma przedstawione narzędzie?

Na podstawie przedstawionego w tabeli standardu opisu pamięci PC-100 wskaż pamięć, która charakteryzuje się maksymalnym czasem dostępu wynoszącym 6 nanosekund oraz minimalnym opóźnieniem między sygnałami CAS i RAS równym 2 cyklom zegara?

| Specyfikacja wzoru: PC 100-abc-def jednolitego sposobu oznaczania pamięci. | ||

| a | CL (ang. CAS Latency) | minimalna liczba cykli sygnału taktującego, liczona podczas operacji odczytu, od momentu uaktywnienia sygnału CAS, do momentu pojawienia się danych na wyjściu modułu DIMM (wartość CL wynosi zwykle 2 lub 3); |

| b | tRCD (ang. RAS to CAS Delay) | minimalne opóźnienie pomiędzy sygnałami RAS i CAS, wyrażone w cyklach zegara systemowego; |

| c | tRP (ang. RAS Precharge) | czas wyrażony w cyklach zegara taktującego, określający minimalną pauzę pomiędzy kolejnymi komendami, wykonywanymi przez pamięć; |

| d | tAC | Maksymalny czas dostępu (wyrażony w nanosekundach); |

| e | SPD Rev | specyfikacja komend SPD (parametr może nie występować w oznaczeniach); |

| f | Parametr zapasowy | ma wartość 0; |

Jakim protokołem łączności, który gwarantuje pewne dostarczenie informacji, jest protokół

Technologia procesorów z serii Intel Core, wykorzystywana w układach i5, i7 oraz i9, umożliwiająca podniesienie częstotliwości w sytuacji, gdy komputer potrzebuje większej mocy obliczeniowej, to

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Norma PN-EN 50173 rekomenduje montaż przynajmniej

Który z poniższych protokołów jest używany do bezpiecznego przesyłania danych w sieci?

Podczas zamykania systemu operacyjnego na ekranie pojawił się błąd, tak zwany bluescreen, 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN – niepowodzenie zamykania systemu, spowodowane brakiem pamięci. Błąd ten może wskazywać na

Jakie urządzenia dotyczą terminy SLI?

Której komendy wiersza poleceń z opcji zaawansowanych naprawy systemu Windows należy użyć, aby naprawić uszkodzony MBR dysku?

W architekturze sieci lokalnych opartej na modelu klient-serwer

Korzystając z podanego urządzenia, możliwe jest przeprowadzenie analizy działania

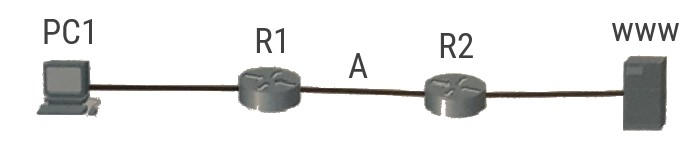

Ramka danych przesyłanych z komputera PC1 do serwera www znajduje się pomiędzy ruterem R1 a ruterem R2 (punkt A). Jakie adresy są w niej zawarte?

Aby zrealizować transfer danych pomiędzy siecią w pracowni a siecią ogólnoszkolną, która ma inną adresację IP, należy zastosować

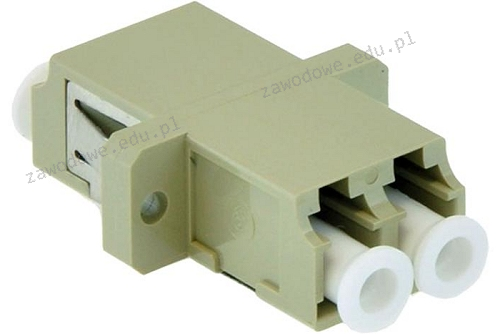

Z jakim medium transmisyjnym związany jest adapter przedstawiony na rysunku?

Jakim poleceniem w systemie Linux można ustalić trasę pakietu do celu?

Jakie polecenie pozwala na uzyskanie adresów fizycznych dla kart sieciowych w systemie?

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

Jaka usługa, opracowana przez firmę Microsoft, pozwala na konwersję nazw komputerów na adresy URL?