Pytanie 1

Jakie są prędkości przesyłu danych w sieciach FDDI (ang. Fiber Distributed Data Interface) wykorzystujących technologię światłowodową?

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Jakie są prędkości przesyłu danych w sieciach FDDI (ang. Fiber Distributed Data Interface) wykorzystujących technologię światłowodową?

Jakiego materiału używa się w drukarkach tekstylnych?

GRUB, LILO, NTLDR to

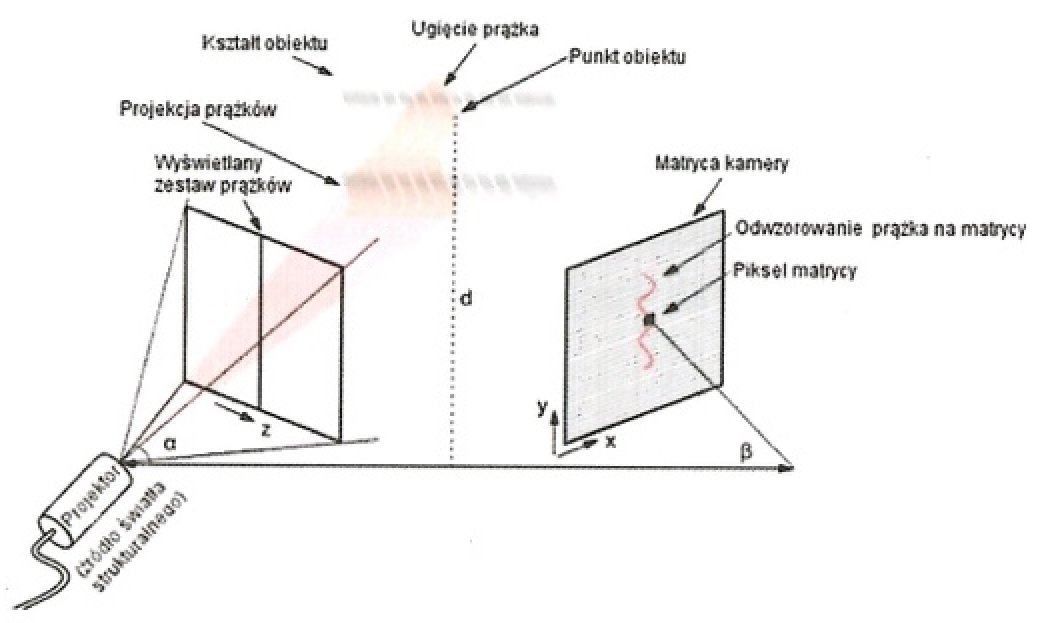

Zaprezentowany diagram ilustruje zasadę funkcjonowania skanera

Który z poniższych programów nie jest wykorzystywany do zdalnego administrowania komputerami w sieci?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W jakiej technologii produkcji projektorów stosowany jest system mikroskopijnych luster, przy czym każde z nich odpowiada jednemu pikselowi wyświetlanego obrazu?

Podstawowy protokół stosowany do ustalania ścieżki oraz przesyłania pakietów danych w sieci komputerowej to

Aby osiągnąć przepustowość wynoszącą 4 GB/s w obie strony, konieczne jest zainstalowanie w komputerze karty graficznej korzystającej z interfejsu

Narzędzie w systemie Windows umożliwiające monitorowanie prób logowania do systemu to dziennik

Licencja grupowa na oprogramowanie Microsoft należy do typu

Który z poniższych mechanizmów zapewni najwyższy stopień ochrony sieci bezprzewodowych w standardzie 802.11n?

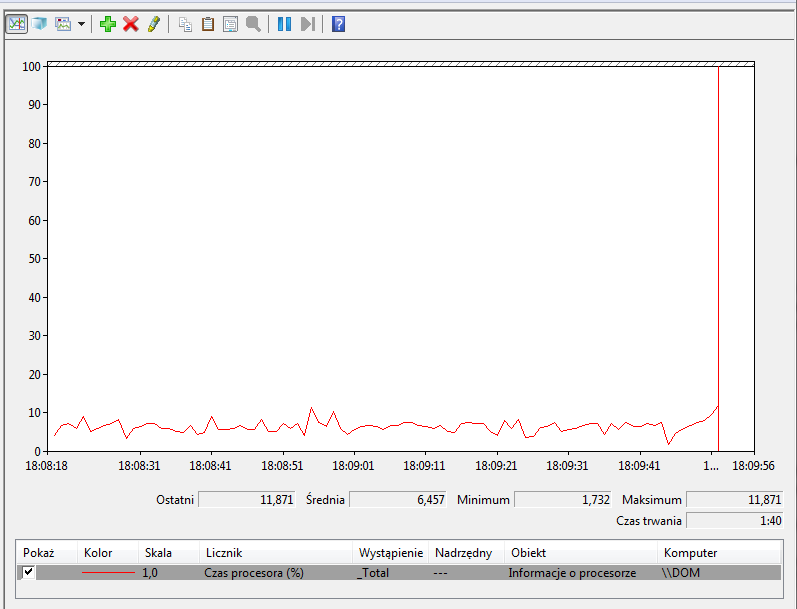

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

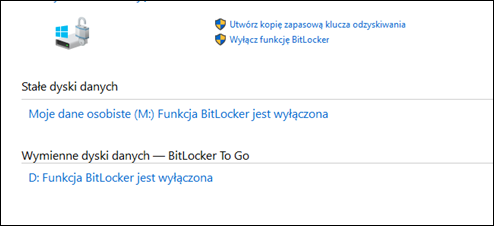

Przedstawione wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate służy do

Urządzenie, które zamienia otrzymane ramki na sygnały przesyłane w sieci komputerowej, to

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

W systemie Linux polecenie chmod służy do

Dysk twardy IDE wewnętrzny jest zasilany przez połączenie typu

Aby użytkownik laptopa z systemem Windows 7 lub nowszym mógł korzystać z drukarki przez sieć WiFi, musi zainstalować drukarkę na porcie

Adres IP 192.168.2.0/24 został podzielony na 8 podsieci. Jaką maskę należy zastosować dla tych nowych podsieci?

Do pokazanej na ilustracji płyty głównej nie da się podłączyć urządzenia korzystającego z interfejsu

Najskuteczniejszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

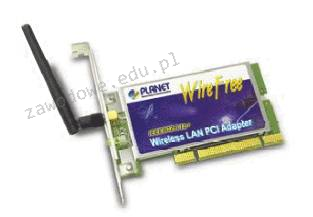

Na przedstawionym zdjęciu widoczna jest

W której fizycznej topologii awaria jednego komputera powoduje przerwanie pracy całej sieci?

Jakie składniki systemu komputerowego wymagają utylizacji w wyspecjalizowanych zakładach przetwarzania z powodu obecności niebezpiecznych substancji lub pierwiastków chemicznych?

Który z rodzajów rekordów DNS w systemach Windows Server określa alias (inną nazwę) dla rekordu A związanej z kanoniczną (rzeczywistą) nazwą hosta?

SuperPi to aplikacja używana do oceniania

Jaki rodzaj licencji pozwala na swobodne modyfikacje, kopiowanie oraz rozpowszechnianie po dokonaniu dowolnej płatności na rzecz twórcy?

Topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub switch, to topologia

Komputer powinien działać jako serwer w sieci lokalnej, umożliwiając innym komputerom dostęp do Internetu poprzez podłączenie do gniazda sieci rozległej za pomocą kabla UTP Cat 5e. Na chwilę obecną komputer jest jedynie połączony ze switchem sieci lokalnej również kablem UTP Cat 5e oraz nie dysponuje innymi portami 8P8C. Jakiego komponentu musi on koniecznie nabrać?

Jakie urządzenie sieciowe zostało pokazane na diagramie sieciowym?

Najczęstszym powodem, dla którego toner rozmazuje się na wydrukach z drukarki laserowej, jest

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

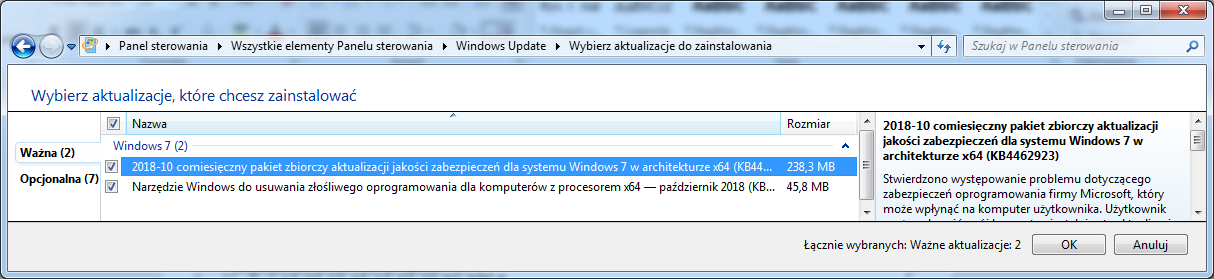

Głównie które aktualizacje zostaną zainstalowane po kliknięciu na przycisk OK prezentowany na zrzucie ekranu?

Wskaż złącze, które nie jest stosowane w zasilaczach ATX?

NIEWŁAŚCIWE podłączenie taśmy sygnałowej do napędu dyskietek skutkuje

Na podstawie wyników działania narzędzia diagnostycznego chkdsk, które są przedstawione na zrzucie ekranu, jaka jest wielkość pojedynczego klastra na dysku?

Typ systemu plików to FAT32.

Wolumin FTP utworzono 12-11-2005 18:31

Numer seryjny woluminu: 3CED-3B31

Trwa sprawdzanie plików i folderów...

Zakończono sprawdzanie plików i folderów.

Trwa sprawdzanie wolnego miejsca na dysku...

Zakończono sprawdzanie wolnego miejsca na dysku.

System Windows sprawdził system plików i nie znalazł żadnych problemów.

8 233 244 KB całkowitego miejsca na dysku.

1 KB w 13 plikach ukrytych.

2 KB w 520 folderach.

1 537 600 KB w 4 952 plikach.

6 690 048 KB jest dostępnych.

4 096 bajtów w każdej jednostce alokacji.

2 058 311 ogółem jednostek alokacji na dysku.

1 672 512 jednostek alokacji dostępnych na dysku.

C:\>

Włączenie systemu Windows w trybie debugowania umożliwia

Wartość liczby ABBA zapisana w systemie heksadecymalnym odpowiada w systemie binarnym liczbie