Pytanie 1

Jakie czynności należy wykonać, aby oczyścić zatkane dysze kartridża w drukarce atramentowej?

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Jakie czynności należy wykonać, aby oczyścić zatkane dysze kartridża w drukarce atramentowej?

Który protokół służy do wymiany danych o trasach oraz dostępności sieci pomiędzy routerami w ramach tego samego systemu autonomicznego?

Na ilustracji złącze monitora, które zostało zaznaczone czerwoną ramką, będzie współdziałać z płytą główną posiadającą interfejs

Aby stworzyć partycję w systemie Windows, należy skorzystać z narzędzia

Jaką konfigurację sieciową może posiadać komputer, który należy do tej samej sieci LAN co komputer z adresem 192.168.1.10/24?

Najskuteczniejszym sposobem na ochronę komputera przed wirusami jest zainstalowanie

Aby monitorować przesył danych w sieci komputerowej, należy wykorzystać program klasy

Cookie to plik

Jaką funkcję należy wybrać, aby utworzyć kopię zapasową rejestru systemowego w edytorze regedit?

Wskaź protokół działający w warstwie aplikacji, który umożliwia odbieranie wiadomości e-mail, a w pierwszym etapie pobiera jedynie nagłówki wiadomości, podczas gdy pobranie ich treści oraz załączników następuje dopiero po otwarciu wiadomości.

Konwencja zapisu ścieżki do udziału sieciowego zgodna z UNC (Universal Naming Convention) ma postać

Minimalna zalecana ilość pamięci RAM dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Jaki skrót odpowiada poniższej masce podsieci: 255.255.248.0?

Aby zweryfikować integralność systemu plików w systemie Linux, które polecenie powinno zostać użyte?

Obrazek ilustruje rezultat działania programu

│ ├── Checkbox_checked.svg │ └── Checkbox_unchecked.svg │ ├── revisions.txt │ ├── tools │ │ ├── howto.txt │ │ ├── Mangler │ │ │ ├── make.sh │ │ │ └── src │ │ │ └── Mangler.java │ │ └── WiFi101 │ │ ├── tool │ │ │ └── firmwares │ │ │ ├── 19.4.4 │ │ │ │ ├── m2m_aio_2b0.bin │ │ │ │ └── m2m_aio_3a0.bin │ │ │ └── 19.5.2 │ │ │ └── m2m_aio_3a0.bin │ │ └── WiFi101.jar │ ├── tools-builder │ │ └── ctags │ │ └── 5.8-arduino11 │ │ └── ctags │ └── uninstall.sh └── brother └── PTouch └── ql570 └── cupswrapper ├── brcupsconfpt1 └── cupswrapperql570pt1

Który z poniższych programów służy do tworzenia kopii zapasowych systemu w systemie Windows?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

Która z usług serwerowych oferuje automatyczne ustawienie parametrów sieciowych dla stacji roboczych?

Każdorazowo automatycznie szyfrowany staje się plik, który został zaszyfrowany przez użytkownika za pomocą systemu NTFS 5.0, w momencie

Do monitorowania aktywnych połączeń sieciowych w systemie Windows służy polecenie

Podaj nazwę funkcji przełącznika, która pozwala na przypisanie wyższego priorytetu dla transmisji VoIP?

Jakie jest tworzywo eksploatacyjne w drukarce laserowej?

W przedsiębiorstwie zainstalowano pięć komputerów z adresami kart sieciowych zawartymi w tabeli. W związku z tym można wyróżnić

| Adres IP | Maska |

|---|---|

| 10.1.61.10 | 255.255.0.0 |

| 10.1.61.11 | 255.255.0.0 |

| 10.3.63.20 | 255.255.0.0 |

| 10.3.63.21 | 255.255.0.0 |

| 10.5.63.10 | 255.255.0.0 |

GRUB, LILO oraz NTLDR to:

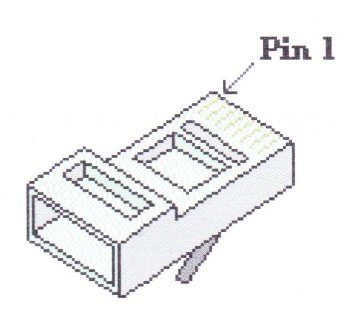

Urządzenie zaprezentowane na ilustracji jest wykorzystywane do zaciskania wtyków:

Aplikacją systemu Windows, która umożliwia analizę wpływu różnych procesów i usług na wydajność CPU oraz oceny stopnia obciążenia pamięci i dysku, jest

Aby serwerowa płyta główna mogła działać poprawnie, potrzebuje pamięci z rejestrem. Który z poniższych modułów pamięci będzie z nią zgodny?

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Główny księgowy powinien mieć możliwość przywracania zawartości folderów z kopii zapasowej plików. Do jakiej grupy użytkowników w systemie MS Windows XP powinien zostać przypisany?

Protokół transportowy bez połączenia w modelu ISO/OSI to

W hurtowni materiałów budowlanych zachodzi potrzeba równoczesnego wydruku faktur w kilku kopiach. Jakiej drukarki należy użyć?

Zadania systemu operacyjnego nie obejmują

Aby uzyskać wyświetlenie podanych informacji o systemie Linux w terminalu, należy skorzystać z komendy

Jakie napięcie zasilające mają pamięci DDR2?

Jak wygląda układ przewodów w złączu RJ45 zgodnie z kolejnością połączeń T568A?

W standardzie Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP przypisane do pinów

W norma PN-EN 50174 brak jest wskazówek odnoszących się do

Jakie gniazdo w notebooku jest przeznaczone do podłączenia kamery cyfrowej przez interfejs i.Link?

Czym jest klaster komputerowy?