Pytanie 1

Podczas tworzenia sieci kablowej o maksymalnej prędkości przesyłu danych wynoszącej 1 Gb/s, w której maksymalna odległość między punktami sieci nie przekracza 100 m, należy zastosować jako medium transmisyjne

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Podczas tworzenia sieci kablowej o maksymalnej prędkości przesyłu danych wynoszącej 1 Gb/s, w której maksymalna odległość między punktami sieci nie przekracza 100 m, należy zastosować jako medium transmisyjne

Farad to jednostka

Które polecenie w systemie Linux służy do zakończenia procesu?

Jakie polecenie w systemie Windows należy wpisać w miejsce kropek, aby uzyskać dane przedstawione na załączonym obrazku?

C:\Windows\system32> ................... Nazwa użytkownika Gość Pełna nazwa Komentarz Wbudowane konto do dostępu do komputera/domeny Komentarz użytkownika Kod kraju 000 (Domyślne ustawienia systemu) Konto jest aktywne Nie Wygasanie konta Nigdy Hasło ostatnio ustawiano 2019-11-23 10:55:12 Ważność hasła wygasa Nigdy Hasło może być zmieniane 2019-12-02 10:55:12 Wymagane jest hasło Nie Użytkownik może zmieniać hasło Nie Dozwolone stacje robocze Wszystkie Skrypt logowania Profil użytkownika Katalog macierzysty Ostatnie logowanie Nigdy Dozwolone godziny logowania Wszystkie Członkostwa grup lokalnych *Goście Członkostwa grup globalnych *None Polecenie zostało wykonane pomyślnie. C:\Windows\system32>

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Jaką wartość ma największa liczba 16-bitowa?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

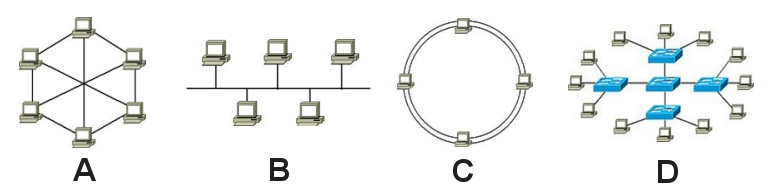

Który z rysunków ilustruje topologię sieci w układzie magistrali?

Proces, który uniemożliwia całkowicie odzyskanie danych z dysku twardego, to

Aby określić rozmiar wolnej oraz zajętej pamięci RAM w systemie Linux, można skorzystać z polecenia

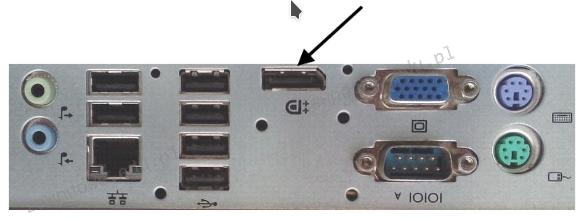

Na ilustracji ukazany jest tylny panel stacji roboczej. Strzałką wskazano port

Który z poniższych systemów operacyjnych jest systemem typu open-source?

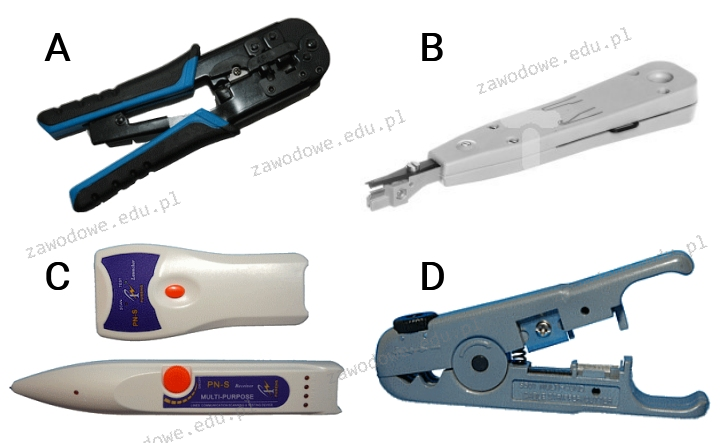

Jakie urządzenie jest używane do mocowania pojedynczych żył kabla miedzianego w złączach?

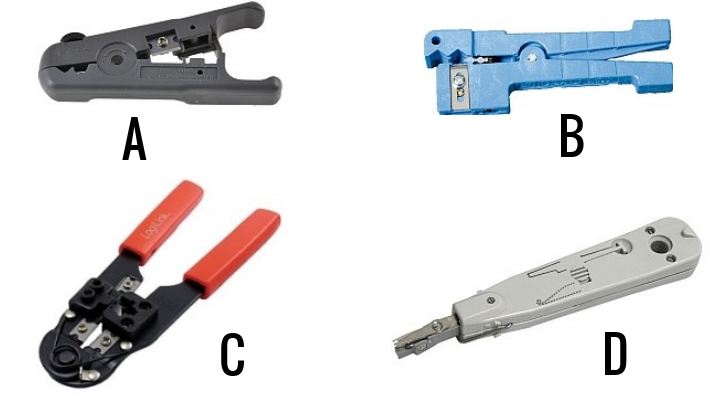

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

Który z interfejsów można uznać za interfejs równoległy?

Zjawisko przenikania, które ma miejsce w sieciach komputerowych, polega na

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?

Komputer A, który potrzebuje przesłać dane do komputera B działającego w sieci z innym adresem IP, najpierw wysyła pakiety do adresu IP

Wskaź zestaw wykorzystywany do diagnozowania logicznych systemów elektronicznych na płycie głównej komputera, który nie reaguje na próbę uruchomienia zasilania?

W standardzie Ethernet 100BaseTX konieczne jest użycie kabli skręconych

Licencja na Office 365 PL Personal (na 1 stanowisko, subskrypcja na 1 rok) ESD jest przypisana do

Podczas instalacji systemu operacyjnego Linux należy wybrać odpowiedni typ systemu plików

Jakie polecenie powinien zastosować użytkownik systemu Linux, aby wydobyć zawartość archiwum o nazwie dane.tar?

Jaki jest największy rozmiar pojedynczego datagramu IPv4, uwzględniając jego nagłówek?

Liczba 22 umieszczona w adresie http://www.adres_serwera.pl:22 wskazuje na numer

Po zainstalowaniu systemu Windows 7 zmieniono konfigurację dysku SATA w BIOS-ie komputera z AHCI na IDE. Przy ponownym uruchomieniu komputera system będzie

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Która z poniższych opcji nie jest wykorzystywana do zdalnego zarządzania stacjami roboczymi?

Podłączona mysz bezprzewodowa sprawia, że kursor na ekranie nie porusza się płynnie i „skacze”. Co może być przyczyną tego problemu?

Na ilustracji zaprezentowano kabel

Jakie wbudowane narzędzie w systemie Windows służy do identyfikowania problemów związanych z animacjami w grach oraz odtwarzaniem filmów?

Jaki typ rozbudowy serwera wymaga zainstalowania dodatkowych sterowników?

Dokument mający na celu przedstawienie oferty cenowej dla inwestora dotyczącej przeprowadzenia robót instalacyjnych w sieci komputerowej, to

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików na dysku twardym, należy wykonać

Jaką operację należy wykonać, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Najszybszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Jaką funkcję pełni zarządzalny przełącznik, aby łączyć wiele połączeń fizycznych w jedno logiczne, co pozwala na zwiększenie przepustowości łącza?

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma zainstalowanego dysku twardego ani żadnych innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w firmowej sieci komputery nie mają napędów, a wszystko "czyta" się z serwera. W celu przywrócenia utraconej funkcji należy zainstalować