Pytanie 1

W komputerowych stacjach roboczych zainstalowane są karty sieciowe Ethernet 10/100/1000 z interfejsem RJ45. Jakie medium transmisyjne powinno być zastosowane do budowy sieci komputerowej, aby osiągnąć maksymalną przepustowość?

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

W komputerowych stacjach roboczych zainstalowane są karty sieciowe Ethernet 10/100/1000 z interfejsem RJ45. Jakie medium transmisyjne powinno być zastosowane do budowy sieci komputerowej, aby osiągnąć maksymalną przepustowość?

Jaką kwotę będzie trzeba zapłacić za wymianę karty graficznej w komputerze, jeżeli jej koszt wynosi 250zł, czas wymiany to 80 minut, a każda rozpoczęta roboczogodzina to 50zł?

Która z poniższych czynności konserwacyjnych jest specyficzna tylko dla drukarki laserowej?

Jaką funkcję pełni punkt dostępowy, aby zabezpieczyć sieć bezprzewodową w taki sposób, aby jedynie urządzenia z wybranymi adresami MAC mogły się do niej łączyć?

Protokół User Datagram Protocol (UDP) należy do

Do jakiego pomiaru wykorzystywany jest watomierz?

Które z poniższych stwierdzeń NIE odnosi się do pamięci cache L1?

Aby zapewnić komputerowi otrzymanie konkretnego adresu IP od serwera DHCP, należy na serwerze ustalić

Instalacja serwera stron www w rodzinie systemów Windows Server jest możliwa dzięki roli

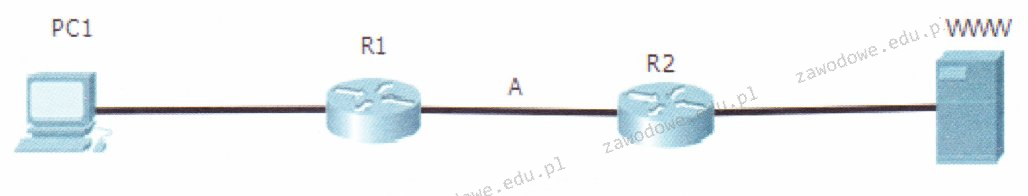

Ramka z informacjami przesyłanymi z komputera PC1 do serwera www znajduje się pomiędzy routerem R1 a routerem R2 w punkcie A). Jakie adresy są w niej zawarte?

W którym miejscu w edytorze tekstu należy wprowadzić tekst lub ciąg znaków, który ma być widoczny na wszystkich stronach dokumentu?

W skanerze z systemem CIS źródłem światła oświetlającym skanowany dokument jest

Złącze widoczne na obrazku pozwala na podłączenie

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem

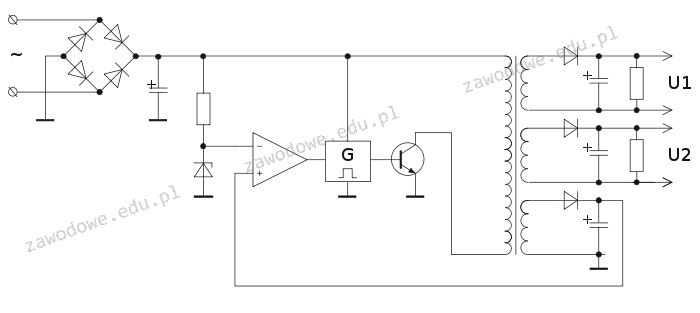

Na rysunku ukazano diagram

Do konserwacji elementów optycznych w komputerach zaleca się zastosowanie

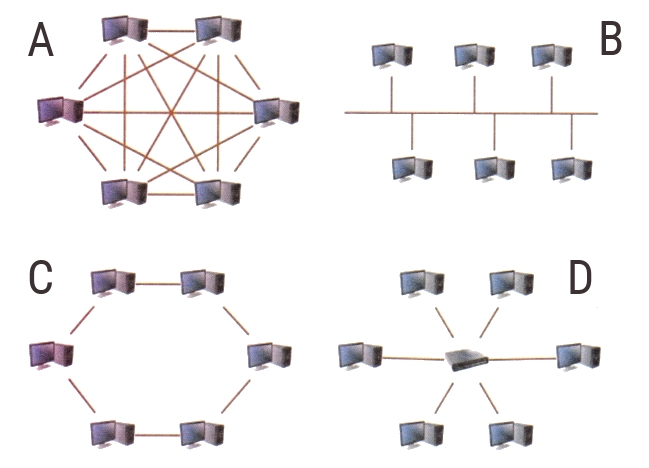

Która z przedstawionych na rysunkach topologii jest topologią siatkową?

Które z urządzeń sieciowych jest przedstawione na grafice?

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

Aby uniknąć utraty danych w systemie do ewidencji uczniów, po zakończeniu codziennej pracy należy wykonać

Podstawowym warunkiem archiwizacji danych jest

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Aby zweryfikować adresy MAC komputerów, które są połączone z przełącznikiem, można zastosować następujące polecenie

Jakie urządzenie NIE powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Wskaż efekt działania przedstawionego polecenia.

net user Test /expires:12/09/20

Jakie będzie rezultatem dodawania liczb 10011012 i 110012 w systemie binarnym?

Która karta graficzna nie będzie współpracowała z monitorem, wyposażonym w złącza przedstawione na zdjęciu (zakładając, że do podłączenia monitora nie można zastosować adaptera)?

Sprzęt sieciowy umożliwiający połączenie pięciu komputerów w tej samej sieci, minimalizując ryzyko kolizji pakietów, to

Wykonanie polecenia tar -xf dane.tar w systemie Linux spowoduje

Nie można uruchomić systemu Windows z powodu błędu oprogramowania. Jak można przeprowadzić diagnozę i usunąć ten błąd w jak najmniej inwazyjny sposób?

Do pielęgnacji elementów łożyskowych oraz ślizgowych w urządzeniach peryferyjnych wykorzystuje się

Liczba \( 10_{D} \) w systemie uzupełnień do dwóch jest równa

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Poniżej zaprezentowano fragment pliku konfiguracyjnego serwera w systemie Linux. Jaką usługi dotyczy ten fragment?

option domain-name "meinheimnetz";

ddns-update-style none;

default-lease-time 14400;

subnet 192.168.1.0 netmask 255.255.255.0 {

range 192.168.1.10 192.168.1.20;

default-lease-time 14400;

max-lease-time 172800;

}Jak nazywa się licencja oprogramowania pozwalająca na bezpłatne dystrybucję aplikacji?

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

AES (ang. Advanced Encryption Standard) to standard szyfrowania, który?

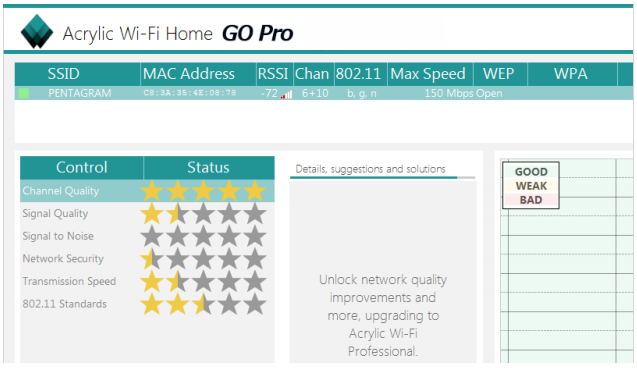

W programie Acrylic Wi-Fi Home przeprowadzono test, którego rezultaty ukazano na zrzucie ekranu. Na ich podstawie można stwierdzić, że sieć bezprzewodowa dostępna w danym momencie

W adresacji IPv6 standardowy podział długości dla adresu sieci oraz identyfikatora hosta wynosi odpowiednio

Ile warstw zawiera model ISO/OSI?