Pytanie 1

Które z poleceń systemu Linux nie umożliwia przeprowadzenia diagnostyki sprzętu komputerowego?

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Które z poleceń systemu Linux nie umożliwia przeprowadzenia diagnostyki sprzętu komputerowego?

W drukarce laserowej do trwałego utrwalania druku na papierze wykorzystuje się

Z wykorzystaniem polecenia dxdiag uruchomionego z linii komend systemu Windows można

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?

Jakie polecenie w systemie Windows służy do monitorowania bieżących połączeń sieciowych?

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Aby zmienić istniejące konto użytkownika przy użyciu polecenia net user oraz wymusić reset hasła po kolejnej sesji logowania użytkownika, jaki parametr należy dodać do tego polecenia?

Jakie zdanie charakteryzuje SSH Secure Shell?

Ataki mające na celu zakłócenie funkcjonowania aplikacji oraz procesów działających w urządzeniu sieciowym określane są jako ataki typu

Ile hostów można zaadresować w podsieci z maską 255.255.255.248?

Zbiór usług sieciowych dla systemów z rodziny Microsoft Windows jest reprezentowany przez skrót

Aby osiągnąć wysoką jakość połączeń głosowych VoIP kosztem innych przesyłanych informacji, konieczne jest włączenie i skonfigurowanie na routerze usługi

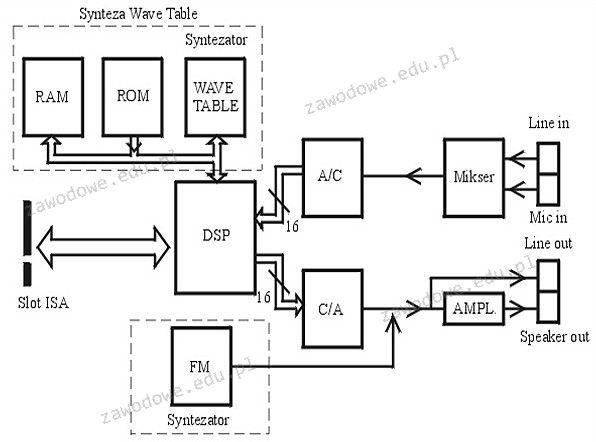

Na ilustracji zaprezentowano schemat działania

Oprogramowanie, które często przerywa działanie przez wyświetlanie komunikatu o konieczności dokonania zapłaty, a które spowoduje zniknięcie tego komunikatu, jest dystrybuowane na podstawie licencji

Jakie polecenie w systemie operacyjnym Linux umożliwia sprawdzenie bieżącej konfiguracji interfejsu sieciowego na komputerze?

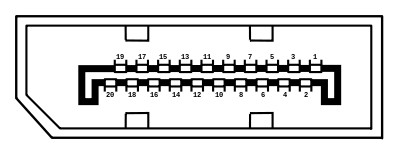

Na ilustracji ukazano port

Aby zabezpieczyć system przed atakami z sieci nazywanymi phishingiem, nie powinno się

Jaki protokół posługuje się portami 20 oraz 21?

Zidentyfikuj urządzenie przedstawione na ilustracji

Urządzenie sieciowe nazywane mostem (ang. bridge) to:

Ilustracja przedstawia rodzaj pamięci

Dostosowywanie parametrów TCP/IP hosta w oparciu o adres MAC karty sieciowej to funkcjonalność jakiego protokołu?

Na ilustracji pokazano część efektu działania programu przeznaczonego do testowania sieci. Sugeruje to użycie polecenia diagnostycznego w sieci

TCP 192.168.0.13:51614 bud02s23-in-f8:https ESTABLISHED TCP 192.168.0.13:51615 edge-star-mini-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51617 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51619 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51620 93.184.220.29:http TIME_WAIT TCP 192.168.0.13:51621 bud02s23-in-f206:https TIME_WAIT TCP 192.168.0.13:51622 xx-fbcdn-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51623 108.161.188.192:https ESTABLISHED TCP 192.168.0.13:51626 23.111.9.32:https TIME_WAIT TCP 192.168.0.13:51628 lg-in-f155:https ESTABLISHED TCP 192.168.0.13:51629 waw02s06-in-f68:https ESTABLISHED

Z powodu uszkodzenia kabla typu skrętka utracono dostęp między przełącznikiem a stacją roboczą. Który instrument pomiarowy powinno się wykorzystać, aby zidentyfikować i naprawić problem bez wymiany całego kabla?

W jakim miejscu są przechowywane dane o kontach użytkowników domenowych w środowisku Windows Server?

Jakie urządzenie jest przedstawione na rysunku?

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Osoba korzystająca z systemu Linux, która chce odnaleźć pliki o konkretnej nazwie przy użyciu polecenia systemowego, może wykorzystać komendę

Przy zmianach w rejestrze Windows w celu zapewnienia bezpieczeństwa należy najpierw

Komunikat "BIOS checksum error" pojawiający się podczas uruchamiania komputera zazwyczaj wskazuje na

Aby zminimalizować różnice w kolorach pomiędzy zeskanowanymi obrazami prezentowanymi na monitorze a ich wersjami oryginalnymi, należy przeprowadzić

Zaproponowany fragment ustawień zapory sieciowej umożliwia przesył danych przy użyciu protokołów ```iptables -A INPUT --protocol tcp --dport 443 -j ACCEPT iptables -A INPUT --protocol tcp --dport 143 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 443 -j ACCEPT iptables -A OUTPUT --protocol tcp --dport 143 -j ACCEPT```

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i przechowywać o nich informacje w centralnym miejscu, konieczne jest zainstalowanie na serwerze Windows roli

W systemie Linux uprawnienia pliku wynoszą 541. Właściciel ma możliwość:

Czym jest kopia różnicowa?

Aby możliwe było skierowanie wydruku na twardy dysk, konieczne jest w ustawieniach drukarki wybranie opcji drukowania do portu

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Główna rola serwera FTP polega na

W adresie IP z klasy A, wartość pierwszego bajtu mieści się w zakresie

Aby przeprowadzić diagnozę systemu operacyjnego Windows oraz stworzyć plik z listą wszystkich ładujących się sterowników, konieczne jest uruchomienie systemu w trybie