Pytanie 1

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Do sprawdzenia, czy w okablowaniu występują odwrócone pary przewodów, stosowany jest test

Do czego służy polecenie 'ping' w systemie operacyjnym?

W jakim miejscu są przechowywane dane o kontach użytkowników domenowych w środowisku Windows Server?

Sieć, w której funkcjonuje komputer o adresie IP 192.168.100.50/28, została podzielona na 4 podsieci. Jakie są poprawne adresy tych podsieci?

Urządzenie trwale zainstalowane u abonenta, które zawiera zakończenie poziomego okablowania strukturalnego, to

Wskaż urządzenie, które należy wykorzystać do połączenia drukarki wyposażonej w interfejs Wi-Fi z komputerem stacjonarnym bez interfejsu Wi-Fi, ale z interfejsem USB.

Przedstawione na ilustracji narzędzie jest przeznaczone do

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

Serwisant dotarł do klienta, który znajdował się 11 km od siedziby firmy, i przeprowadził u niego działania naprawcze wymienione w poniższej tabeli. Oblicz całkowity koszt brutto jego usług, wiedząc, że dojazd do klienta kosztuje 1,20 zł/km brutto w obie strony. Stawka VAT na usługi wynosi 23%.

Gdy wykonanie polecenia ping 127.0.0.1 nie przynosi żadnej odpowiedzi, to

Oblicz koszt wykonania okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego wraz z wykonaniem kabli połączeniowych dla stacji roboczych. W tym celu wykorzystano 50 m skrętki UTP. Punkt abonencki składa się z 2 gniazd typu RJ

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

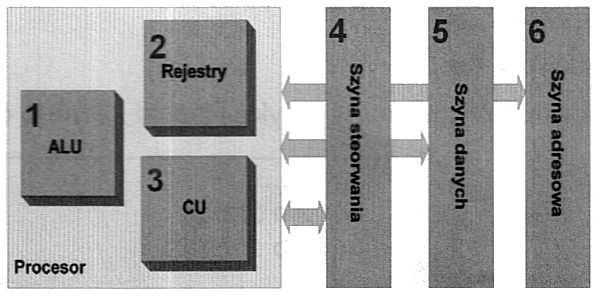

Na diagramie element odpowiedzialny za dekodowanie poleceń jest oznaczony liczbą

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

Aby umożliwić wymianę informacji pomiędzy sieciami VLAN, wykorzystuje się

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaki program powinien zostać zainstalowany na serwerze internetowym opartym na Linuxie, aby umożliwić korzystanie z baz danych?

Na rysunku widoczny jest symbol graficzny

Ustanowienie połączenia pomiędzy dwoma oddalonymi hostami za pomocą publicznej sieci, takiej jak Internet, w sposób, że węzły tej sieci nie wpływają na przesyłane pakiety, to

Tusz żelowy wykorzystywany jest w drukarkach

Do czego służy mediakonwerter?

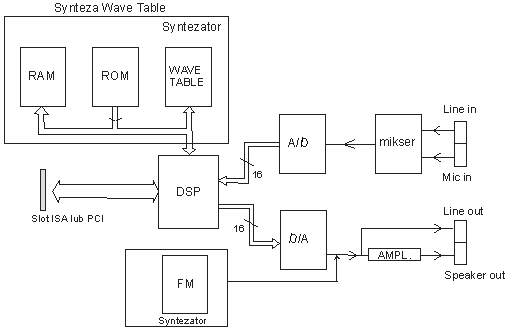

Który z elementów przedstawionych na diagramie karty dźwiękowej na rysunku jest odpowiedzialny za cyfrowe przetwarzanie sygnałów?

Cienki klient (thin client) to?

Jakiego protokołu używa się do ściągania wiadomości e-mail z serwera pocztowego na komputer użytkownika?

Optyczna rozdzielczość to jeden z właściwych parametrów

Symbolika tego procesora wskazuje na

Wskaż błędny sposób podziału dysku MBR na partycje

Z analizy danych przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi 184 styki 64-bitowa magistrala danych Pojemność 1024 MB Przepustowość 3200 MB/s

Urządzenie zaprezentowane na ilustracji jest wykorzystywane do zaciskania wtyków:

Użytkownik chce tak zmodernizować komputer, aby działały na nim gry wymagające DirectX12. Jaki system operacyjny powinien zakupić do modernizowanego komputera, aby wspierał DX12?

Jaki typ macierzy dyskowych zapewnia tak zwany mirroring dysków?

Zgodnie z normą PN-EN 50173, minimalna liczba punktów rozdzielczych, które należy zainstalować, wynosi

Podczas testowania kabla sieciowego zakończonego wtykami RJ45 przy użyciu diodowego testera okablowania, diody LED zapalały się w odpowiedniej kolejności, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły równocześnie na jednostce głównej testera, natomiast na jednostce zdalnej nie świeciły wcale. Jaka mogła być tego przyczyna?

Liczba 10011001100 w systemie heksadecymalnym przedstawia się jako

Najczęstszym powodem rozmazywania się tonera na wydrukach z drukarki laserowej jest

Aby zapewnić komputerowi otrzymanie konkretnego adresu IP od serwera DHCP, należy na serwerze ustalić

Jakie protokoły przesyłają regularne kopie tablic routingu do sąsiednich ruterów, nie zawierając pełnych informacji o odległych urządzeniach routujących?

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

Administrator sieci lokalnej zauważył, że urządzenie typu UPS przełączyło się w tryb awaryjny. Oznacza to awarię systemu

Przed przystąpieniem do modernizacji komputerów osobistych oraz serwerów, polegającej na dodaniu nowych modułów pamięci RAM, konieczne jest sprawdzenie