Pytanie 1

Aby zrealizować aktualizację zainstalowanego systemu operacyjnego Linux Ubuntu, należy wykonać polecenie

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Aby zrealizować aktualizację zainstalowanego systemu operacyjnego Linux Ubuntu, należy wykonać polecenie

Switch jako kluczowy komponent występuje w sieci o strukturze

Główny księgowy powinien mieć możliwość przywracania zawartości folderów z kopii zapasowej plików. Do jakiej grupy użytkowników w systemie MS Windows XP powinien zostać przypisany?

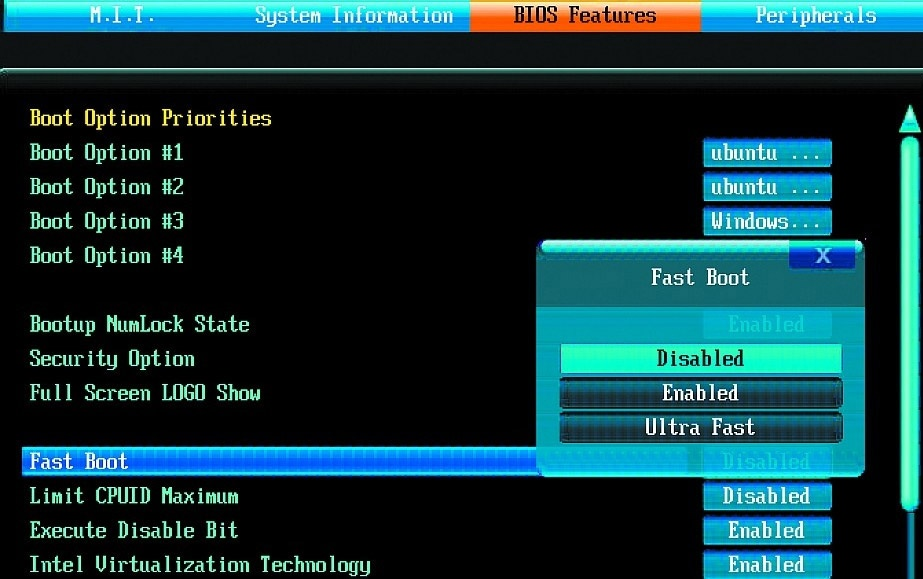

Co spowoduje zmiana opcji Fast Boot na wartość Enabledw konfiguracji BIOS przedstawionej na ilustracji?

W systemie Linux, polecenie usermod -s dla danego użytkownika umożliwia

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

Najczęściej używany kodek audio przy ustawianiu bramki VoIP to

Która z poniższych wskazówek nie jest właściwa w kontekście konserwacji skanera płaskiego?

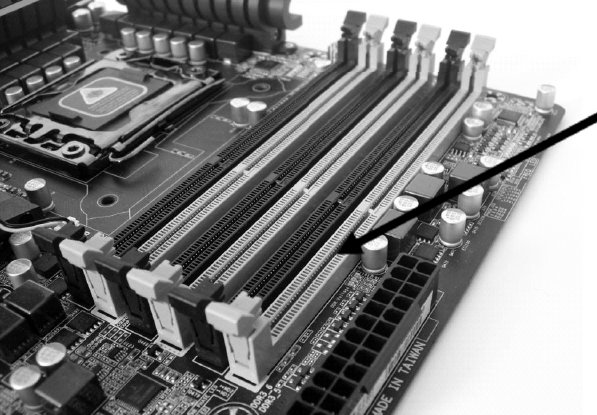

Jaki typ pamięci powinien być umieszczony na płycie głównej komputera w miejscu, które wskazuje strzałka?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie oprogramowanie zabezpieczające przed nieautoryzowanym dostępem do sieci powinno być zainstalowane na serwerze, który udostępnia dostęp do internetu?

Technika określana jako rytownictwo dotyczy zasady funkcjonowania plotera

W jakiej topologii sieci komputerowej każdy węzeł ma bezpośrednie połączenie z każdym innym węzłem?

Jakie urządzenie powinno się wykorzystać, aby rozszerzyć zasięg sieci bezprzewodowej w obiekcie?

Typ profilu użytkownika w systemie Windows Serwer, który nie zapisuje zmian wprowadzonych na bieżącym pulpicie ani na serwerze, ani na stacji roboczej po wylogowaniu, to profil

Jakie urządzenie pozwoli na podłączenie drukarki, która nie jest wyposażona w kartę sieciową, do lokalnej sieci komputerowej?

Aby stworzyć skompresowane archiwum danych w systemie Linux, jakie polecenie należy zastosować?

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Urządzenie, które łączy różne segmenty sieci i przesyła ramki pomiędzy nimi, wybierając odpowiedni port, do którego są kierowane konkretne ramki, to

W jakim miejscu są zapisane dane dotyczące kont użytkowników domenowych w systemach Windows Server?

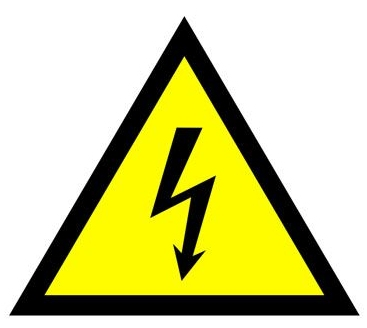

Symbol umieszczony na obudowie komputera stacjonarnego informuje o zagrożeniu przed

Do przechowywania fragmentów dużych plików programów oraz danych, które nie mieszczą się w całości w pamięci, wykorzystywany jest

Początkowe znaki heksadecymalne adresu IPv6 przeznaczonego do link-local to

Urządzenie peryferyjne pokazane na ilustracji to skaner biometryczny, który do autoryzacji wykorzystuje

W systemie Windows, po wydaniu komendy systeminfo, nie da się uzyskać danych o

W którym modelu płyty głównej można zamontować procesor o podanych parametrach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Fragment pliku httpd.conf serwera Apache przedstawia się jak na diagramie. W celu zweryfikowania prawidłowego funkcjonowania strony WWW na serwerze, należy wprowadzić w przeglądarkę

| Listen 8012 |

| Server Name localhost:8012 |

Aby zmagazynować 10 GB danych na pojedynczej płycie DVD, jaki typ nośnika powinien być wykorzystany?

Grupa, w której członkom można nadawać uprawnienia jedynie w obrębie tej samej domeny, co domena nadrzędna lokalnej grupy domeny, nosi nazwę grupa

Użytkownik planuje instalację 32-bitowego systemu operacyjnego Windows 7. Jaka jest minimalna ilość pamięci RAM, którą powinien mieć komputer, aby system mógł działać w trybie graficznym?

Który z komponentów komputera można wymienić bez konieczności wyłączania zasilania?

Jaki tryb funkcjonowania Access Pointa jest wykorzystywany do umożliwienia urządzeniom bezprzewodowym łączności z przewodową siecią LAN?

Planując pierwsze uruchomienie i konfigurację rutera, należy w pierwszej kolejności

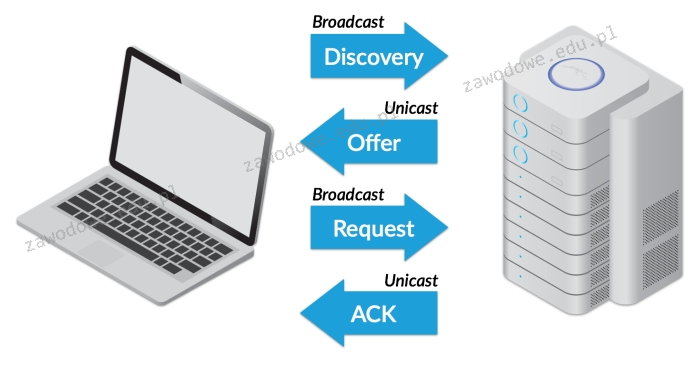

Którego protokołu działanie zostało zaprezentowane na diagramie?

Podczas testowania połączeń sieciowych za pomocą polecenia ping użytkownik otrzymał wyniki przedstawione na rysunku. Jakie może być źródło braku odpowiedzi serwera przy pierwszym teście, zakładając, że domena wp.pl ma adres 212.77.100.101?

C:\Users\uczen>ping wp.pl

Żądanie polecenia ping nie może znaleźć hosta wp.pl. Sprawdź nazwę i ponów próbe.

C:\Users\uczen>ping 212.77.100.101

Badanie 212.77.100.101 z 32 bajtami danych:

Odpowiedź z 212.77.100.101: bajtów=32 czas=19ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=35ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=40ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=20ms TTL=127

Statystyka badania ping dla 212.77.100.101:

Pakiety: Wysłane = 4, Odebrane = 4, Utracone = 0

(0% straty),

Szacunkowy czas błądzenia pakietów w millisekundach:

Minimum = 19 ms, Maksimum = 40 ms, Czas średni = 28 msZa przydzielanie czasu procesora do konkretnych zadań odpowiada

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Jakie zakresy adresów IPv4 mogą być używane jako adresy prywatne w lokalnej sieci?

Informacja zawarta na ilustracji może wskazywać na

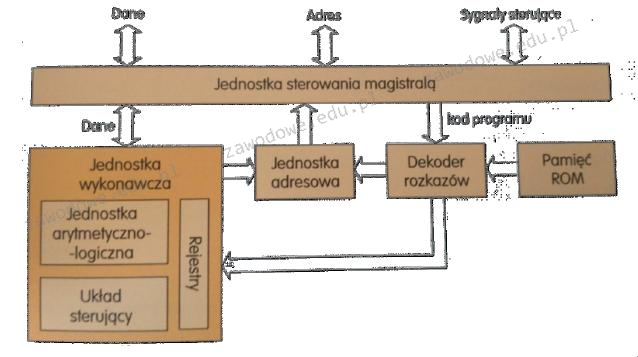

Na ilustracji przedstawiono schemat konstrukcji logicznej