Pytanie 1

Jak należy ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie łączyć się z dwiema różnymi sieciami lokalnymi posiadającymi odrębne adresy IP?

Wynik: 35/40 punktów (87,5%)

Wymagane minimum: 20 punktów (50%)

Jak należy ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie łączyć się z dwiema różnymi sieciami lokalnymi posiadającymi odrębne adresy IP?

Oprogramowanie OEM (Original Equipment Manufacturer) jest związane z

Na rysunku znajduje się graficzny symbol

Na płycie głównej z chipsetem Intel 865G

Jakie polecenie należy użyć w wierszu poleceń systemu Windows, aby utworzyć nowy katalog?

W sytuacji, gdy brakuje odpowiedniej ilości pamięci RAM do przeprowadzenia operacji, takiej jak uruchomienie aplikacji, system Windows pozwala na przeniesienie nieużywanych danych z pamięci RAM do pliku

Program do monitorowania, który umożliwia przechwytywanie, nagrywanie oraz dekodowanie różnych pakietów sieciowych to

Poprawę jakości skanowania można osiągnąć poprzez zmianę

Na przedstawionym schemacie wtyk (złącze męskie modularne) stanowi zakończenie kabla

Na diagramie zaprezentowano strukturę

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

Jakie zagrożenie nie jest eliminowane przez program firewall?

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

Jakim procesem jest nieodwracalne usunięcie możliwości odzyskania danych z hard dysku?

Aby zapobiec uszkodzeniom układów scalonych przy serwisie sprzętu komputerowego, należy korzystać z

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Technologia procesorów z serii Intel Core, wykorzystywana w układach i5, i7 oraz i9, umożliwiająca podniesienie częstotliwości w sytuacji, gdy komputer potrzebuje większej mocy obliczeniowej, to

W systemie Linux wykonanie komendy passwd Ala spowoduje

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

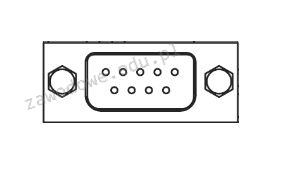

Obrazek ilustruje rodzaj złącza

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

Jakie urządzenie umożliwia połączenie sieci lokalnej z siecią rozległą?

Jakie polecenie uruchamia edytor polityk grup w systemach z rodziny Windows Server?

Do przeprowadzenia aktualizacji systemu Windows służy polecenie

Jak nazywa się materiał używany w drukarkach 3D?

Przedstawione na ilustracji narzędzie służy do

Na przedstawionym schemacie urządzeniem, które łączy komputery, jest

Zdiagnostykowane wyniki wykonania polecenia systemu Linux odnoszą się do ```/dev/sda: Timing cached reads: 18100 MB in 2.00 seconds = 9056.95 MB/sec```

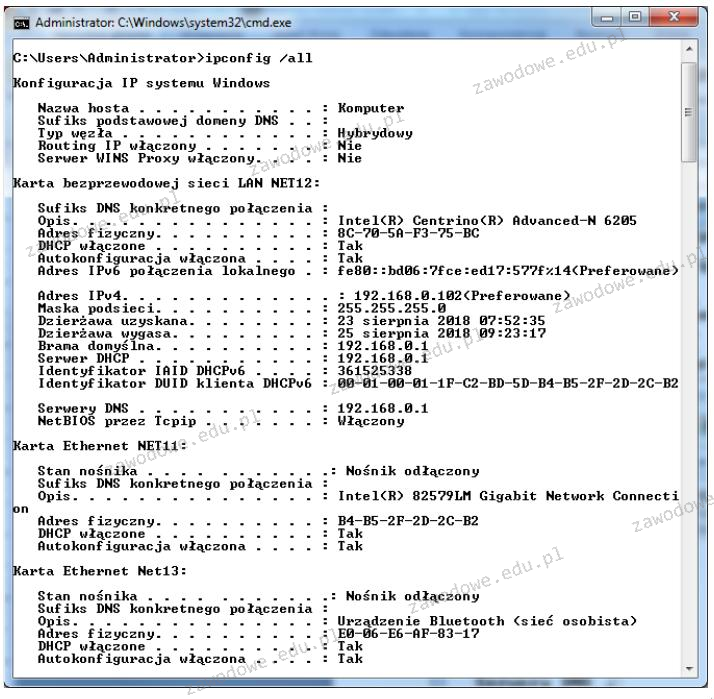

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych w komputerze, można zauważyć, że

W dokumentacji technicznej procesora znajdującego się na płycie głównej komputera, jaką jednostkę miary stosuje się do określenia szybkości zegara?

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz maską 26 bitową?

Jaką częstotliwość odświeżania należy ustawić, aby obraz na monitorze był odświeżany 85 razy na sekundę?

Interfejs UDMA to interfejs

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Jakie jest najbardziej typowe dla topologii gwiazdy?

W warstwie łącza danych modelu odniesienia ISO/OSI możliwą przyczyną błędów działania lokalnej sieci komputerowej jest

W trakcie instalacji systemu Windows, zaraz po rozpoczęciu instalacji w trybie graficznym, istnieje możliwość otwarcia Wiersza poleceń (konsoli) za pomocą kombinacji klawiszy

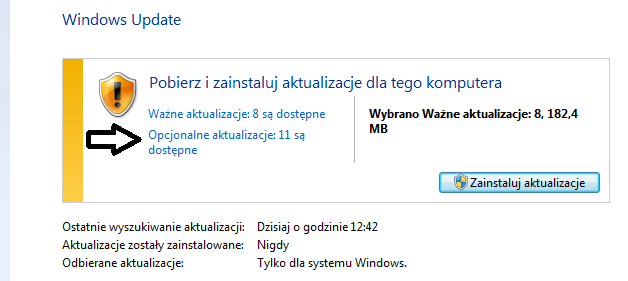

Jeśli użytkownik wybierze pozycję wskazaną strzałką, będzie mógł zainstalować aktualizacje

Jak nazywa się jednostka przeprowadzająca obliczenia stałoprzecinkowe?