Pytanie 1

Protokół pakietów użytkownika, który zapewnia dostarczanie datagramów w trybie bezpołączeniowym, to

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Protokół pakietów użytkownika, który zapewnia dostarczanie datagramów w trybie bezpołączeniowym, to

Profil użytkownika systemu Windows, który można wykorzystać do logowania na dowolnym komputerze w sieci, przechowywany na serwerze i mogący być edytowany przez użytkownika, to profil

W systemie Linux polecenie chown służy do

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału między segmentami sieci lub jego blokowaniu?

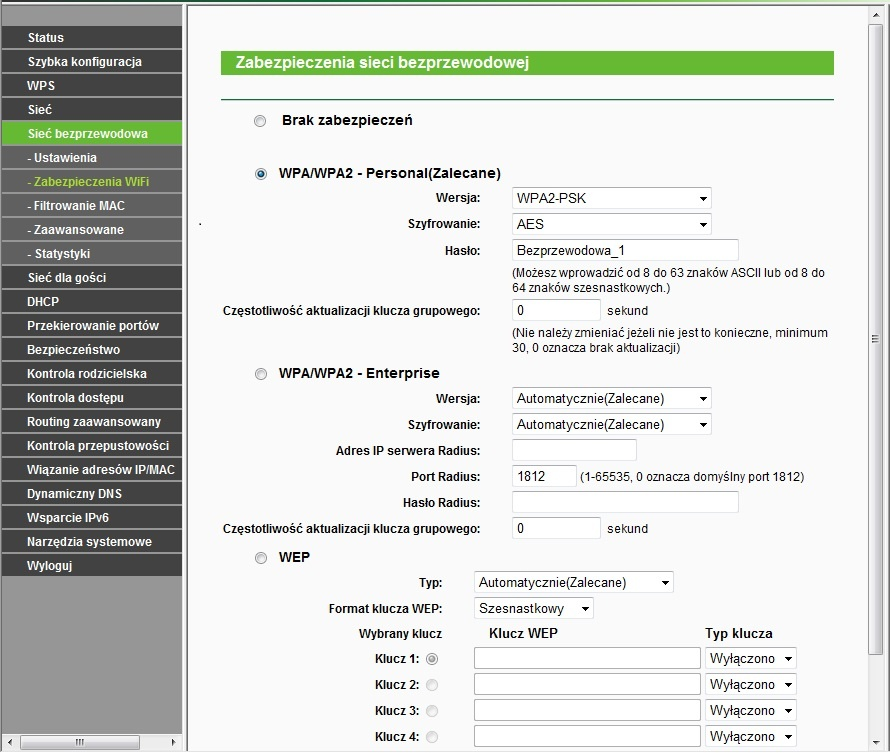

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

W przypadku dysku twardego, w jakiej jednostce wyrażana jest wartość współczynnika MTBF (Mean Time Between Failure)?

Do utworzenia skompresowanego archiwum danych w systemie Linux można użyć polecenia

Jakie oznaczenie na schematach sieci LAN przypisuje się punktom rozdzielczym dystrybucyjnym znajdującym się na różnych kondygnacjach budynku według normy PN-EN 50173?

Aby zainstalować serwer FTP w systemach z rodziny Windows Server, konieczne jest dodanie roli serwera

Protokół stosowany do rozgłaszania w grupie, dzięki któremu hosty informują o swoim członkostwie, to

Wskaż błędny sposób podziału dysku MBR na partycje?

Aby przekształcić zeskanowany obraz na tekst, należy użyć oprogramowania, które stosuje techniki

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji elektrycznej oświetlenia powinna wynosić

Rozkaz procesora, przetwarzający informację i zamieniający ją na wynik, należy do grupy rozkazów

Protokół transportowy bezpołączeniowy to

Plik zajmuje 2KB. Jakie to jest?

W trakcie instalacji systemu Windows, zaraz po rozpoczęciu instalatora w trybie graficznym, istnieje możliwość otwarcia Wiersza poleceń (konsoli) za pomocą kombinacji klawiszy

Uzyskanie przechowywania kopii często odwiedzanych witryn oraz zwiększenia bezpieczeństwa przez odfiltrowanie konkretnych treści w sieci Internet można osiągnąć dzięki

Urządzeniem peryferyjnym pokazanym na ilustracji jest skaner biometryczny, który wykorzystuje do identyfikacji

Do wykonania kopii danych na dysk USB w systemie Linux stosuje się polecenie

System Windows 8, w którym wcześniej został utworzony punkt przywracania, doświadczył awarii. Jakie polecenie należy wydać, aby przywrócić ustawienia i pliki systemowe?

Przedstawiony panel tylny płyty głównej jest wyposażony między innymi w interfejsy:

Komputer dysponuje adresem IP 192.168.0.1, a jego maska podsieci wynosi 255.255.255.0. Który adres stanowi adres rozgłoszeniowy dla podsieci, do której ten komputer przynależy?

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Jak nazywa się pamięć podręczną procesora?

Czytnik w napędzie optycznym, który jest zanieczyszczony, należy wyczyścić

W przedsiębiorstwie trzeba było zreperować 5 komputerów i serwer. Czas potrzebny na naprawę każdego z komputerów wyniósł 1,5 godziny, a serwera 2,5 godziny. Stawka za usługę to 100,00 zł za roboczogodzinę, a do tego doliczany jest podatek VAT w wysokości 23%. Jaka kwota brutto będzie należna za tę usługę?

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

Jeśli podczas podłączania stacji dysków elastycznych 1,44 MB kabel sygnałowy zostanie włożony odwrotnie, to

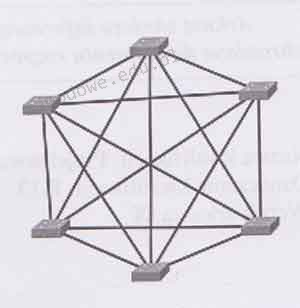

Jakiego rodzaju fizycznej topologii sieci komputerowej dotyczy przedstawiony obrazek?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie jest główne zadanie programu Wireshark?

Aby w systemie Linux wykonać kopię zapasową określonych plików, należy wprowadzić w terminalu polecenie programu

Najczęstszym powodem, dla którego toner rozmazuje się na wydrukach z drukarki laserowej, jest

Co oznacza kod BREAK odczytany przez układ elektroniczny klawiatury?

Usługa w systemie Windows Server, która umożliwia zdalną instalację systemów operacyjnych na komputerach zarządzanych przez serwer, to

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Jakie będą całkowite koszty materiałów potrzebnych do stworzenia sieci lokalnej dla 6 komputerów, jeśli do budowy sieci wymagane jest 100 m kabla UTP kat. 5e oraz 20 m kanału instalacyjnego? Ceny komponentów sieci przedstawiono w tabeli.

| Elementy sieci | j.m. | cena brutto |

|---|---|---|

| Kabel UTP kat. 5e | m | 1,00 zł |

| Kanał instalacyjny | m | 8,00 zł |

| Gniazdo komputerowe | szt. | 5,00 zł |

Jakie informacje można uzyskać dzięki programowi Wireshark?