Pytanie 1

Ile hostów można zaadresować w podsieci z maską 255.255.255.248?

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Ile hostów można zaadresować w podsieci z maską 255.255.255.248?

Który element pasywny sieci powinien być użyty do połączenia okablowania ze wszystkich gniazd abonenckich z panelem krosowniczym umieszczonym w szafie rack?

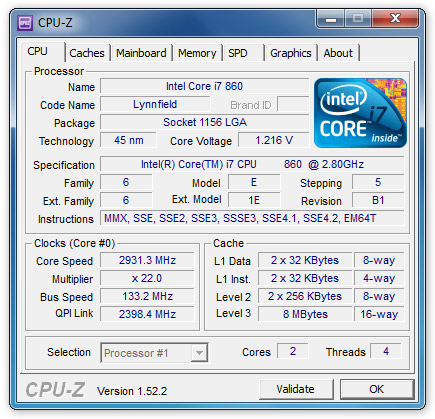

W dokumentacji technicznej procesora producent umieścił wyniki testu, który został wykonany przy użyciu programu CPU-Z. Z tych danych wynika, że procesor dysponuje

Zainstalowanie w komputerze wskazanej karty pozwoli na

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

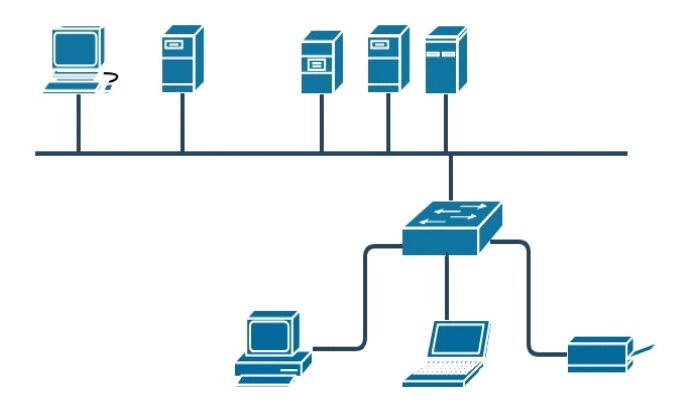

Ilustracja pokazuje schemat fizycznej topologii będącej kombinacją topologii

Według modelu TCP/IP, protokoły DNS, FTP oraz SMTP zaliczają się do warstwy

Z jakiego typu pamięci korzysta dysk SSD?

Zastosowanie symulacji stanów logicznych w obwodach cyfrowych pozwala na

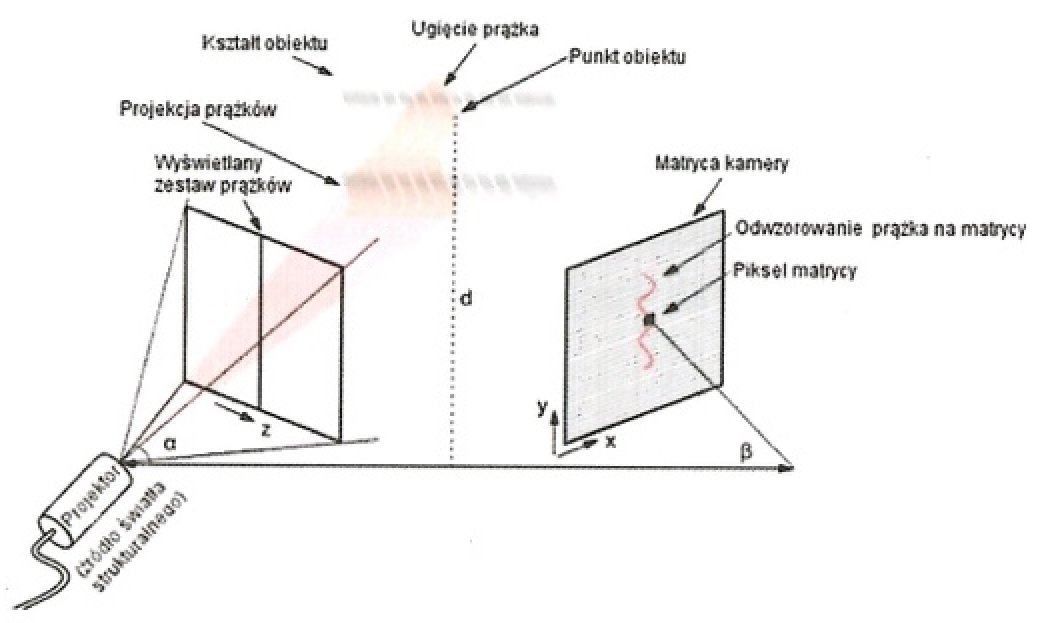

Zaprezentowany diagram ilustruje zasadę funkcjonowania skanera

Zarządzanie pasmem (ang. bandwidth control) w switchu to funkcjonalność

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Użytkownik systemu Windows napotyka komunikaty o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Które medium transmisyjne umożliwia izolację galwaniczną pomiędzy systemami przesyłu danych?

Który z wymienionych protokołów przekształca 48-bitowy adres MAC na 32-bitowy adres IP?

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

Klawiatura QWERTY, która pozwala na wprowadzanie znaków typowych dla języka polskiego, nazywana jest także klawiaturą

Wskaż interfejsy płyty głównej widoczne na rysunku.

Protokół ARP (Address Resolution Protocol) służy do konwersji adresu IP na

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Znak przedstawiony na ilustracji, zgodny z normą Energy Star, wskazuje na urządzenie

Jakie oznaczenie potwierdza oszczędność energii urządzenia?

Do jakiego złącza, które pozwala na podłączenie monitora, jest wyposażona karta graficzna pokazana na ilustracji?

Jaką minimalną ilość pamięci RAM musi mieć komputer, aby móc uruchomić 64-bitowy system operacyjny Windows 7 w trybie graficznym?

Jakim symbolem powinien być oznaczony sprzęt komputerowy, aby spełniał wymogi prawne konieczne do sprzedaży w Unii Europejskiej?

Jak będzie wyglądać liczba 29A16 w systemie binarnym?

Złącze IrDA służy do bezprzewodowej komunikacji i jest

Na podstawie wskazanego cennika oblicz, jaki będzie łączny koszt brutto jednego podwójnego natynkowego gniazda abonenckiego w wersji dwumodułowej?

| Lp. | Nazwa | j.m. | Cena jednostkowa brutto |

|---|---|---|---|

| 1. | Puszka natynkowa 45x45mm dwumodułowa | szt. | 4,00 zł |

| 2. | Ramka + suport 45x45mm dwumodułowa | szt. | 4,00 zł |

| 3. | Adapter 22,5x45mm do modułu keystone | szt. | 3,00 zł |

| 4. | Moduł keystone RJ45 kategorii 5e | szt. | 7,00 zł |

Element systemu komputerowego przedstawiony na ilustracji to

Który z elementów szafy krosowniczej został pokazany na ilustracji?

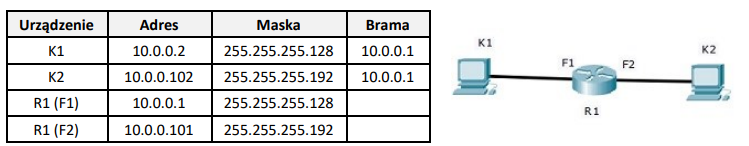

Komputery K1 i K2 nie są w stanie nawiązać komunikacji. Adresy urządzeń zostały przedstawione w tabeli. Co należy zmienić, aby przywrócić połączenie w sieci?

W przypadku okablowania strukturalnego opartego na skrętce UTP kat.6, jakie gniazda sieciowe powinny być używane?

SuperPi to aplikacja używana do testowania

W biurze rachunkowym znajduje się sześć komputerów w jednym pomieszczeniu, połączonych kablem UTP Cat 5e z koncentratorem. Pracownicy korzystający z tych komputerów muszą mieć możliwość drukowania bardzo dużej ilości dokumentów monochromatycznych (powyżej 5 tys. stron miesięcznie). Aby zminimalizować koszty zakupu i eksploatacji sprzętu, najlepszym wyborem będzie:

Jak nazywa się materiał używany w drukarkach 3D?

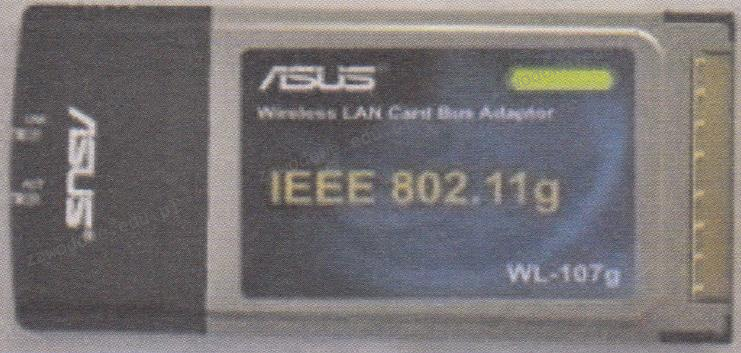

Karta sieciowa przedstawiona na ilustracji ma zdolność przesyłania danych z maksymalną prędkością

Na ilustracji zaprezentowano system monitorujący

Liczba 10101110110(2) w systemie szesnastkowym przedstawia się jako

Który sterownik drukarki jest niezależny od urządzenia i systemu operacyjnego oraz jest standardem w urządzeniach poligraficznych?