Pytanie 1

Aby zweryfikować integralność systemu plików w systemie Linux, które polecenie powinno zostać użyte?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Aby zweryfikować integralność systemu plików w systemie Linux, które polecenie powinno zostać użyte?

Wypukłe kondensatory elektrolityczne w module zasilania monitora LCD mogą doprowadzić do uszkodzenia

Jakie zastosowanie ma polecenie md w systemie Windows?

Funkcja systemu Windows Server, umożliwiająca zdalną instalację systemów operacyjnych na komputerach kontrolowanych przez serwer, to

W systemie Windows Server narzędzie, które pozwala na zarządzanie zasadami grupowymi, to

Który z protokołów umożliwia szyfrowanie połączenia?

Podstawowy rekord uruchamiający na dysku twardym to

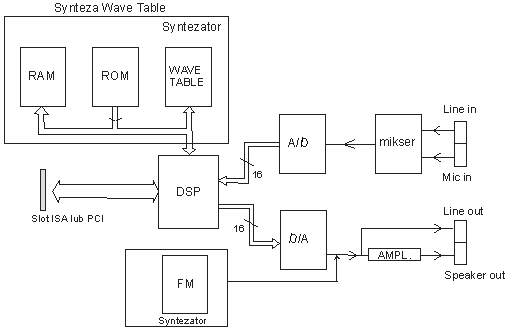

Który z elementów przedstawionych na diagramie karty dźwiękowej na rysunku jest odpowiedzialny za cyfrowe przetwarzanie sygnałów?

Jeżeli rozmiar jednostki alokacji wynosi 1024 bajty, to ile klastrów zajmą pliki umieszczone w tabeli na dysku?

| Nazwa | Wielkość |

|---|---|

| Ala.exe | 50 B |

| Dom.bat | 1024 B |

| Wirus.exe | 2 kB |

| Domes.exr | 350 B |

Który z podanych elementów jest częścią mechanizmu drukarki igłowej?

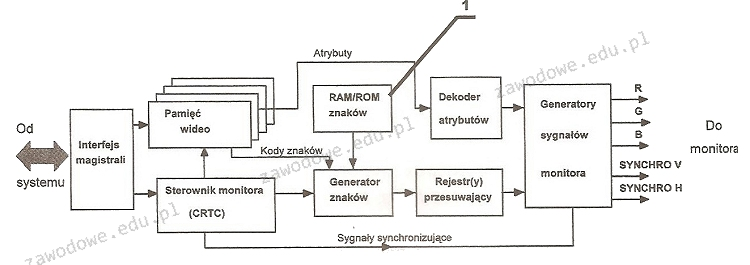

Element oznaczony cyfrą 1 na diagramie blokowym karty graficznej?

Nie jest możliwe tworzenie okresowych kopii zapasowych z dysku serwera na przenośnych nośnikach typu

Podczas konfiguracji nowego routera, użytkownik został poproszony o skonfigurowanie WPA2. Czego dotyczy to ustawienie?

Po zainstalowaniu Systemu Windows 7 dokonano zmiany w BIOS-ie komputera, skonfigurowano dysk SATA z AHCI na IDE. Po ponownym uruchomieniu systemu komputer będzie

Które urządzenie pomiarowe wykorzystuje się do określenia wartości napięcia w zasilaczu?

Osoba korzystająca z systemu Linux, która chce odnaleźć pliki o konkretnej nazwie przy użyciu polecenia systemowego, może wykorzystać komendę

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

Drukarka fotograficzna ma bardzo brudną obudowę oraz wyświetlacz. Aby usunąć zabrudzenia bez ich uszkodzenia, należy użyć

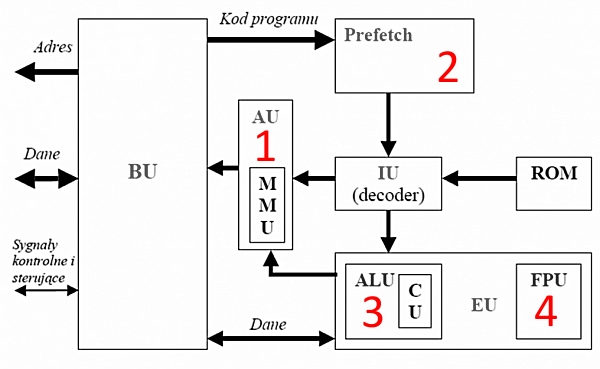

Koprocesor arytmetyczny, który pełni funkcję wykonywania obliczeń na liczbach zmiennoprzecinkowych w mikroprocesorze, został na schemacie oznaczony cyfrą

Jednym ze sposobów na ograniczenie dostępu do sieci bezprzewodowej dla nieuprawnionych osób jest

Jakie stwierdzenie o routerach jest poprawne?

Jakie środowisko graficzne zaprojektowane dla systemu Linux ma najniższe wymagania dotyczące pamięci RAM?

Zjawisko przenikania, które ma miejsce w sieciach komputerowych, polega na

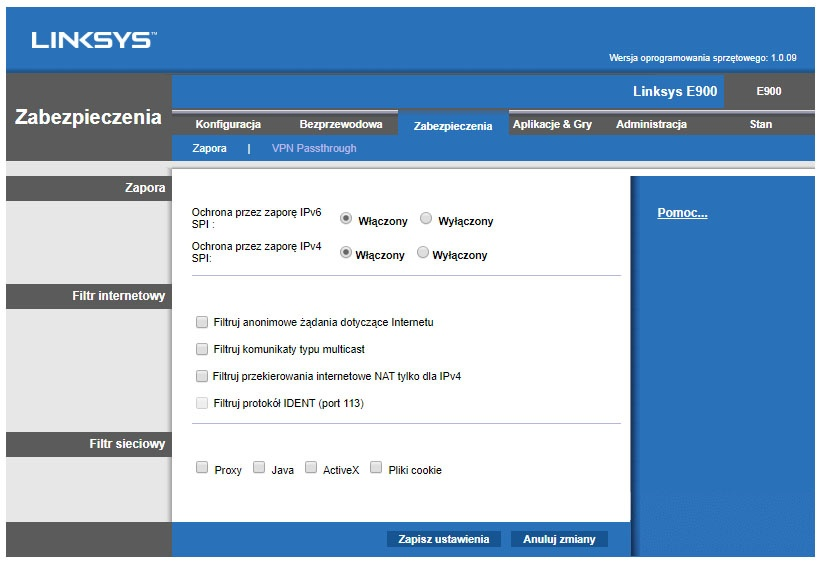

Na ilustracji przedstawiono okno konfiguracji rutera. Wskaż opcję, która wpływa na zabezpieczenie urządzenia przed atakami DDoS.

Komputer jest połączony z myszą bezprzewodową, a kursor w trakcie używania nie porusza się płynnie, tylko "skacze" po ekranie. Możliwą przyczyną awarii urządzenia może być

Jakie funkcje posiada program tar?

Aby skonfigurować usługę rutingu w systemie Windows Serwer, należy zainstalować rolę

Protokół ARP (Address Resolution Protocol) służy do konwersji adresu IP na

Z analizy oznaczenia pamięci DDR3 PC3-16000 można wywnioskować, że ta pamięć:

Ile adresów urządzeń w sieci jest dostępnych dzięki zastosowaniu klasy adresowej C w systemach opartych na protokołach TCP/IP?

Jakie właściwości charakteryzują pojedyncze konto użytkownika w systemie Windows Serwer?

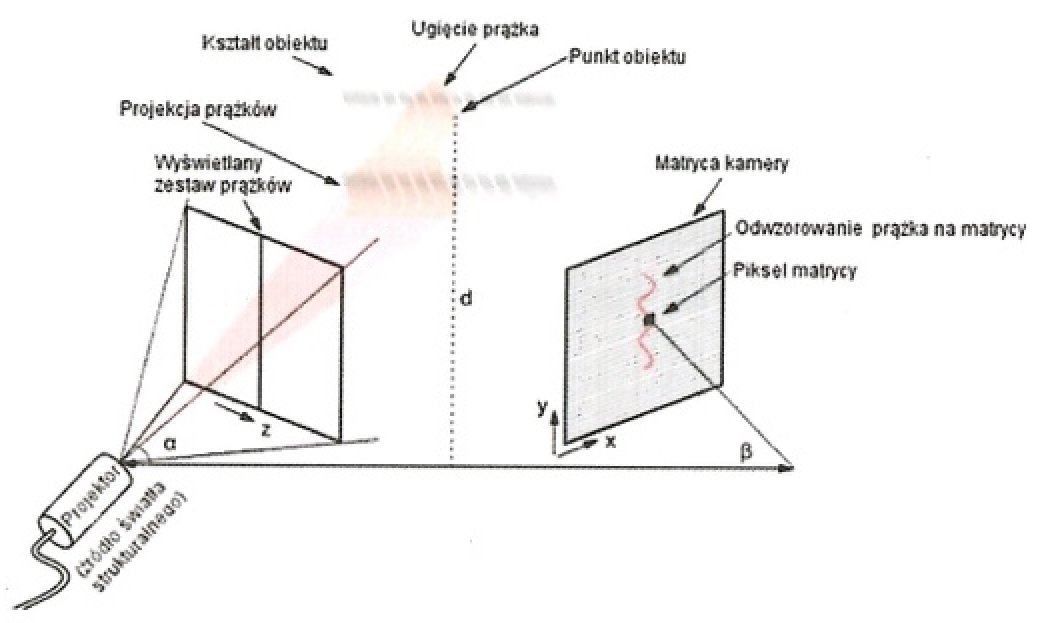

Zaprezentowany diagram ilustruje zasadę funkcjonowania skanera

Aby chronić urządzenia w sieci LAN przed przepięciami oraz różnicami potencjałów, które mogą się pojawić w trakcie burzy lub innych wyładowań atmosferycznych, należy zastosować

Jakie jest źródło pojawienia się komunikatu na ekranie komputera, informującego o wykryciu konfliktu adresów IP?

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Jakim protokołem jest protokół dostępu do sieci pakietowej o maksymalnej prędkości 2 Mbit/s?

Urządzenie peryferyjne, które jest kontrolowane przez komputer i służy do pracy z dużymi, płaskimi powierzchniami, a do produkcji druku odpornego na warunki atmosferyczne wykorzystuje farby na bazie rozpuszczalników, nosi nazwę ploter

Jakie urządzenie stosuje technikę detekcji zmian w pojemności elektrycznej do sterowania kursorem na monitorze?

Jakie rozszerzenia mają pliki instalacyjne systemu operacyjnego Linux?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z