Pytanie 1

Jakie urządzenie powinno być użyte do podłączenia komputerów, aby mogły działać w różnych domenach rozgłoszeniowych?

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie powinno być użyte do podłączenia komputerów, aby mogły działać w różnych domenach rozgłoszeniowych?

Na 16 bitach możemy przechować

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Za pomocą narzędzia diagnostycznego Tracert można ustalić trasę do punktu docelowego. Przez ile routerów przeszedł pakiet wysłany dl hosta 172.16.0.99?

C:\>tracert 172.16.0.99 Trasa śledzenia do 172.16.0.99 z maksymalną liczbą przeskoków 30 | ||||

| 1 | 2 ms | 3 ms | 2 ms | 10.0.0.1 |

| 2 | 12 ms | 8 ms | 8 ms | 192.168.0.1 |

| 3 | 10 ms | 15 ms | 10 ms | 172.17.0.2 |

| 4 | 11 ms | 11 ms | 20 ms | 172.17.48.14 |

| 5 | 21 ms | 16 ms | 24 ms | 172.16.0.99 |

Śledzenie zakończone. | ||||

Jaka jest maksymalna prędkość transferu danych w sieci lokalnej, w której zastosowano przewód UTP kat.5e do budowy okablowania strukturalnego?

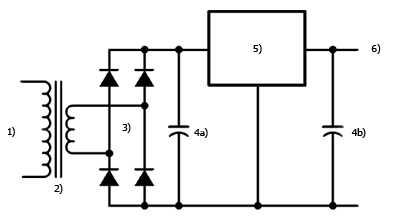

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Norma EN 50167 odnosi się do systemów okablowania

Awaria klawiatury może być spowodowana przez uszkodzenie

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma możliwości uruchomienia systemu operacyjnego, ponieważ brakuje dysku twardego oraz napędów optycznych, a system operacyjny uruchamia się z lokalnej sieci. W celu odzyskania utraconej funkcjonalności należy zainstalować w komputerze

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Które cechy ma licencja bezpłatnego oprogramowania zwana freemium?

Profil użytkownika systemu Windows, który można wykorzystać do logowania na dowolnym komputerze w sieci, przechowywany na serwerze i mogący być edytowany przez użytkownika, to profil

Jakie polecenie w systemie Linux jest używane do planowania zadań?

Jakie urządzenie powinno się wykorzystać, aby rozszerzyć zasięg sieci bezprzewodowej w obiekcie?

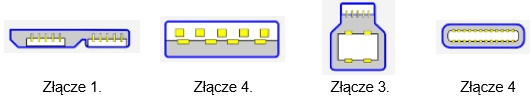

Wskaż kształt złącza USB typu C.

Która z kart graficznych nie będzie kompatybilna z monitorem, posiadającym złącza pokazane na ilustracji (zakładając, że nie można użyć adaptera do jego podłączenia)?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie znaczenie ma parametr NVP (Nominal Velocity of Propagation) podczas pomiarów okablowania strukturalnego?

Do czego służy program firewall?

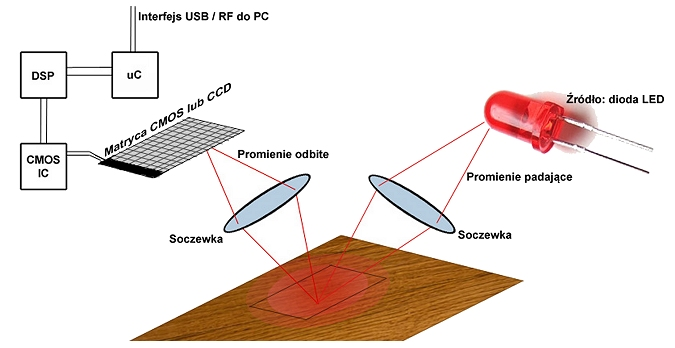

Zaprezentowany diagram ilustruje zasadę funkcjonowania

Wskaż ikonę programu stosowanego do rozpakowania archiwum plików RAR.

Aby przesłać projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry są pokazane w tabeli, można zastosować złącze

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

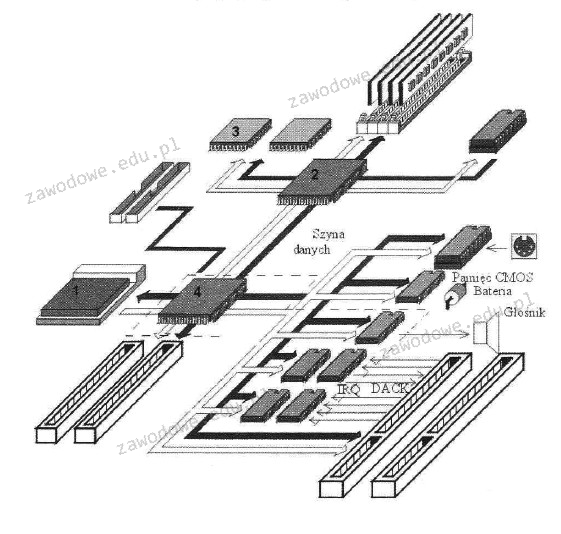

Jaką liczbą oznaczono procesor na diagramie płyty głównej komputera?

Jakie znaczenie ma termin "wykonanie kopii zapasowej systemu"?

Urządzenie pokazane na ilustracji jest przeznaczone do

Czym jest skrót MAN w kontekście sieci?

Adres MAC (Medium Access Control Address) stanowi fizyczny identyfikator interfejsu sieciowego Ethernet w obrębie modelu OSI

Podaj domyślny port używany do przesyłania poleceń (command) w serwerze FTP

Wskaż interfejsy płyty głównej widoczne na rysunku.

Podczas skanowania czarno-białego rysunku technicznego z maksymalną rozdzielczością optyczną skanera, na pochylonych i zaokrąglonych krawędziach można dostrzec schodkowe ułożenie pikseli. Aby poprawić jakość skanowanego obrazu, konieczne jest zastosowanie funkcji

ping 192.168.11.3 Jaką komendę należy wpisać w miejsce kropek, aby w systemie Linux wydłużyć domyślny odstęp czasowy między pakietami podczas używania polecenia ping?

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

Podstawowym zadaniem mechanizmu Plug and Play jest:

Nie jest możliwe wykonywanie okresowych kopii zapasowych dysków serwera na nośnikach wymiennych typu

Zgodnie ze specyfikacją JEDEC typowe napięcie zasilania modułów niskonapięciowych pamięci RAM DDR3L wynosi

Jaką maksymalną liczbę podstawowych partycji na dysku twardym z tablicą MBR można utworzyć za pomocą narzędzia Zarządzanie dyskami dostępnego w systemie Windows?

Ile urządzeń jest w stanie współpracować z portem IEEE1394?

Jakie miejsce nie jest zalecane do przechowywania kopii zapasowej danych z dysku twardego komputera?

Proces aktualizacji systemów operacyjnych ma na celu przede wszystkim