Pytanie 1

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Wymiana baterii należy do czynności związanych z eksploatacją

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Która przystawka MMC systemu Windows umożliwia przegląd systemowego Dziennika zdarzeń?

Użytkownik systemu Linux, który pragnie usunąć konto innej osoby wraz z jej katalogiem domowym, powinien użyć polecenia

Zjawisko, w którym pliki przechowywane na dysku twardym są zapisywane w klastrach, które nie sąsiadują ze sobą, określane jest mianem

Narzędziem wiersza poleceń w systemie Windows, umożliwiającym zamianę tablicy partycji GPT na MBR, jest program

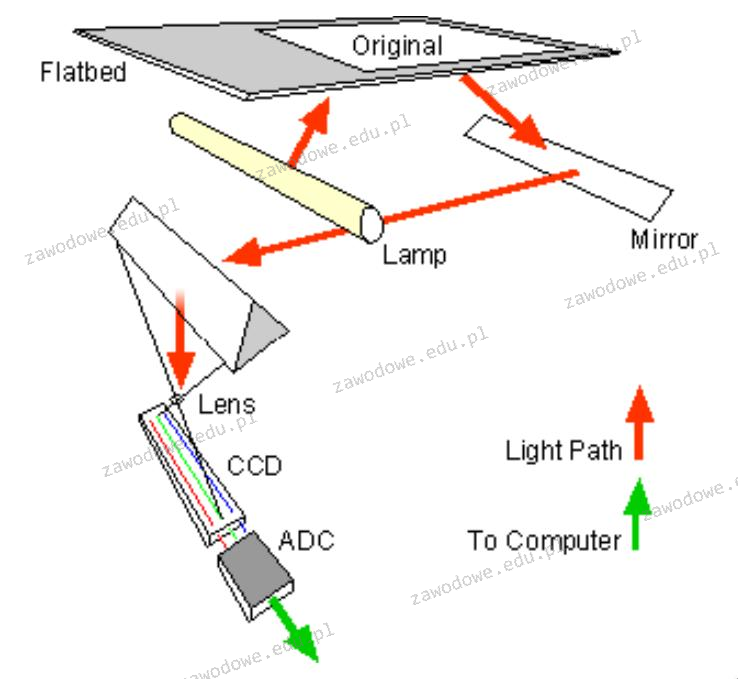

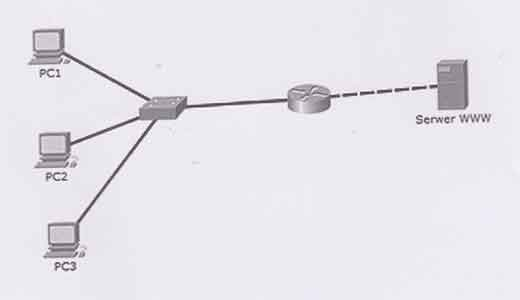

Ilustrowany schemat obrazuje zasadę funkcjonowania

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

W przypadku, gdy w tej samej przestrzeni będą funkcjonować jednocześnie dwie sieci WLAN zgodne ze standardem 802.11g, w celu zminimalizowania ryzyka wzajemnych zakłóceń, powinny one otrzymać kanały o numerach różniących się o

Do konwersji kodu źródłowego na program wykonywalny używany jest

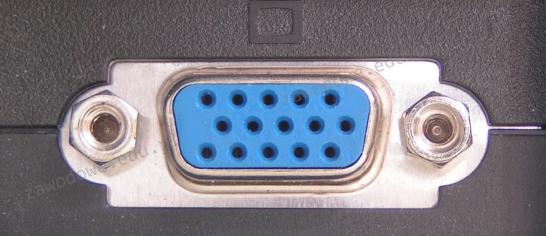

Złącze widoczne na ilustracji służy do podłączenia

Jaką maskę domyślną mają adresy IP klasy B?

Jakim materiałem eksploatacyjnym jest ploter solwentowy?

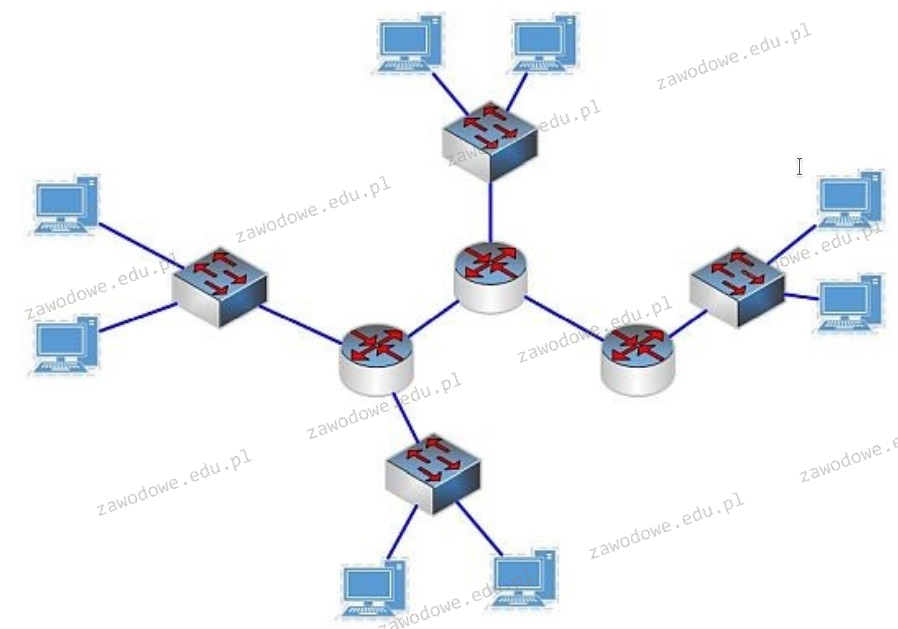

Na diagramie przedstawione są symbole

Urządzenie pokazane na ilustracji to

Aby zapewnić użytkownikom Active Directory możliwość logowania i korzystania z zasobów tej usługi w sytuacji awarii kontrolera domeny, trzeba

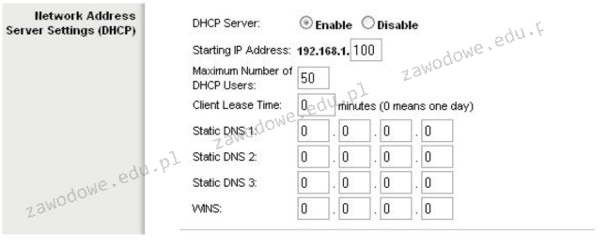

Na ilustracji widać panel ustawień bezprzewodowego punktu dostępu, który pozwala na

Jakie są zasadnicze różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

W schemacie logicznym struktury okablowania, zgodnie z polską terminologią zawartą w normie PN-EN 50174, cechą kondygnacyjnego punktu dystrybucyjnego jest to, że

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają możliwości połączenia z serwerem WWW. Wynik polecenia ping z komputerów do bramy jest pozytywny. Który element sieci nie może być źródłem problemu?

W systemie Windows przypadkowo zlikwidowano konto użytkownika, lecz katalog domowy pozostał nietknięty. Czy możliwe jest odzyskanie nieszyfrowanych danych z katalogu domowego tego użytkownika?

Aby skutecznie zabezpieczyć system operacyjny przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego konieczne jest

Aby zminimalizować różnice w kolorach pomiędzy zeskanowanymi obrazami prezentowanymi na monitorze a ich wersjami oryginalnymi, należy przeprowadzić

Jakie zadanie pełni router?

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Jakie ustawienie należy wprowadzić przy konfiguracji serwera DHCP?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaki system operacyjny funkcjonuje w trybie tekstowym i umożliwia uruchomienie środowiska graficznego KDE?

Błąd typu STOP Error (Blue Screen) w systemie Windows, który wiąże się z odniesieniem się systemu do niepoprawnych danych w pamięci RAM, to

Które z poniższych stwierdzeń jest prawdziwe w odniesieniu do przedstawionej konfiguracji serwisu DHCP w systemie Linux?

Administrator sieci komputerowej z adresem 192.168.1.0/24 podzielił ją na 8 równych podsieci. Ile adresów hostów będzie dostępnych w każdej z nich?

Czym charakteryzuje się technologia Hot swap?

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

Jakie polecenie należy wprowadzić w wierszu polecenia systemów Windows Server, aby zaktualizować dzierżawy adresów DHCP oraz przeprowadzić rejestrację nazw w systemie DNS?

Jaką funkcjonalność oferuje program tar?

Jak przywrócić stan rejestru systemowego w edytorze Regedit, wykorzystując wcześniej utworzoną kopię zapasową?

Wskaż rysunek ilustrujący kondensator stały?

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

Czym jest mapowanie dysków?