Pytanie 1

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Użytkownik systemu Windows doświadcza problemów z niewystarczającą pamięcią wirtualną. Jak można temu zaradzić?

Licencja grupowa na oprogramowanie Microsoft należy do typu

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Który z komponentów komputera można wymienić bez konieczności wyłączania zasilania?

Na diagramie okablowania strukturalnego przy jednym z komponentów znajduje się oznaczenie MDF. Z którym punktem dystrybucji jest powiązany ten komponent?

Zestaw komputerowy, który został przedstawiony, jest niepełny. Który z elementów nie został wymieniony w tabeli, a jest kluczowy dla prawidłowego funkcjonowania zestawu?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Zalman Obudowa R1 Midi Tower bez PSU, USB 3.0 |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, BOX |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Jakie polecenie wykorzystano do analizy zaprezentowanej konfiguracji interfejsów sieciowych w systemie Linux?

enp0s25 Link encap:Ethernet HWaddr a0:b3:cc:28:8f:37 UP BROADCAST MULTICAST MTU:1500 Metric:1 RX packets:0 errors:0 dropped:0 overruns:0 frame:0 TX packets:0 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:0 (0.0 B) TX bytes:0 (0.0 B) Interrupt:20 Memory:d4700000-d4720000 lo Link encap:Local Loopback inet addr:127.0.0.1 Mask:255.0.0.0 inet6 addr: ::1/128 Scope:Host UP LOOPBACK RUNNING MTU:65536 Metric:1 RX packets:172 errors:0 dropped:0 overruns:0 frame:0 TX packets:172 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:13728 (13.7 KB) TX bytes:13728 (13.7 KB) wlo1 Link encap:Ethernet HWaddr 60:67:20:3f:91:22 inet addr:192.168.1.11 Bcast:192.168.1.255 Mask:255.255.255.0 inet6 addr: fe80::dcf3:c20b:57f7:21b4/64 Scope:Link UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1 RX packets:7953 errors:0 dropped:0 overruns:0 frame:0 TX packets:4908 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:9012314 (9.0 MB) TX bytes:501345 (501.3 KB)

Zestaw dodatkowy, który zawiera strzykawkę z cieczą, igłę oraz rękawice ochronne, jest przeznaczony do napełniania pojemników z medium drukującym w drukarkach

Elementem eksploatacyjnym drukarki laserowej jest wszystko oprócz

Które z poniższych urządzeń jest przykładem urządzenia peryferyjnego wejściowego?

W hierarchicznym modelu sieci, komputery należące do użytkowników są składnikami warstwy

Interfejs równoległy, który ma magistralę złożoną z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na dystans do 5 metrów, gdy kable sygnałowe są skręcone z przewodami masy, a w przeciwnym razie na dystans do 2 metrów, jest określany mianem

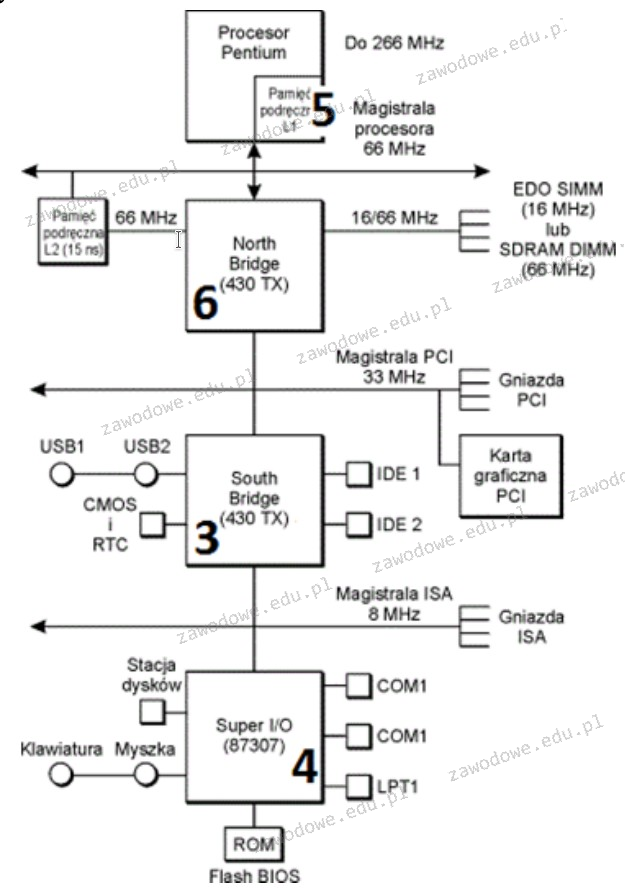

Część płyty głównej, która odpowiada za transmisję danych pomiędzy mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej, jest oznaczona na rysunku numerem

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

W ustawieniach haseł w systemie Windows Server aktywowano opcję, że hasło musi spełniać wymagania dotyczące złożoności. Z jakiej minimalnej liczby znaków musi składać się hasło użytkownika?

Jaką inną formą można zapisać 2^32 bajtów?

W systemie Windows, który wspiera przydziały dyskowe, użytkownik o nazwie Gość

W sieciach bezprzewodowych Ad-Hoc (Independent Basic Service Set) wykorzystywana jest fizyczna struktura

Protokół transportowy bez połączenia w modelu ISO/OSI to

Jaki adres IP został przypisany do hosta na interfejsie sieciowym eth0?

[root@ipv6 tspc]# ifconfig

eth0 Link encap:Ethernet HWaddr 00:A0:C9:89:02:F8

inet addr:128.171.104.26 Bcast:128.171.104.255 Mask:255.255.255.0

inet6 addr: fe80::2a0:c9ff:fe89:2f8/10 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:663940 errors:0 dropped:0 overruns:0 frame:0

TX packets:67717 errors:0 dropped:0 overruns:0 carrier:0

collisions:7797 txqueuelen:100

RX bytes:234400485 (223.5 Mb) TX bytes:17743338 (16.9 Mb)

Interrupt:10 Base address:0xef80

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

inet6 addr: ::1/128 Scope:Host

UP LOOPBACK RUNNING MTU:16436 Metric:1

RX packets:3070 errors:0 dropped:0 overruns:0 frame:0

TX packets:3070 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:153813 (150.2 Kb) TX bytes:153813 (150.2 Kb)

sit1 Link encap:IPv6-in-IPv4

inet6 addr: 3ffe:b80:2:482::2/64 Scope:Global

inet6 addr: fe80::80ab:681a/10 Scope:Link

UP POINTOPOINT RUNNING NOARP MTU:1480 Metric:1

RX packets:82 errors:0 dropped:0 overruns:0 frame:0

TX packets:78 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:8921 (8.7 Kb) TX bytes:8607 (8.4 Kb)Okablowanie pionowe w systemie strukturalnym łączy się

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

Usługa, która odpowiada za przekształcanie nazw domenowych na adresy IP, to

Aby zablokować oraz usunąć złośliwe oprogramowanie, takie jak exploity, robaki i trojany, konieczne jest zainstalowanie oprogramowania

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Brak odpowiedzi na to pytanie.

Urządzenie sieciowe nazywane mostem (ang. bridge) to:

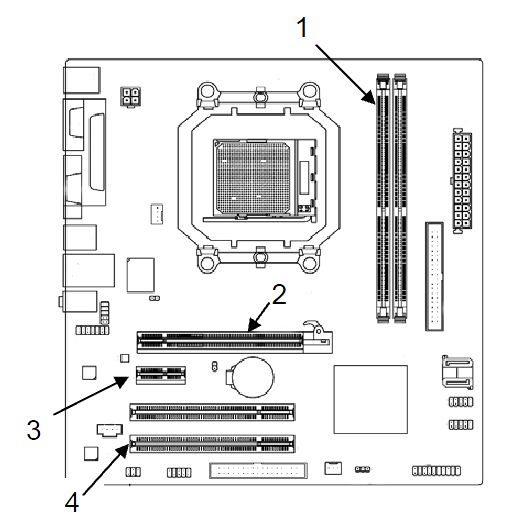

Na schemacie płyty głównej, gdzie można zamontować moduły pamięci RAM, gniazdo oznaczone cyfrą to

Odnalezienie głównego rekordu rozruchowego, wczytującego system z aktywnej partycji umożliwia

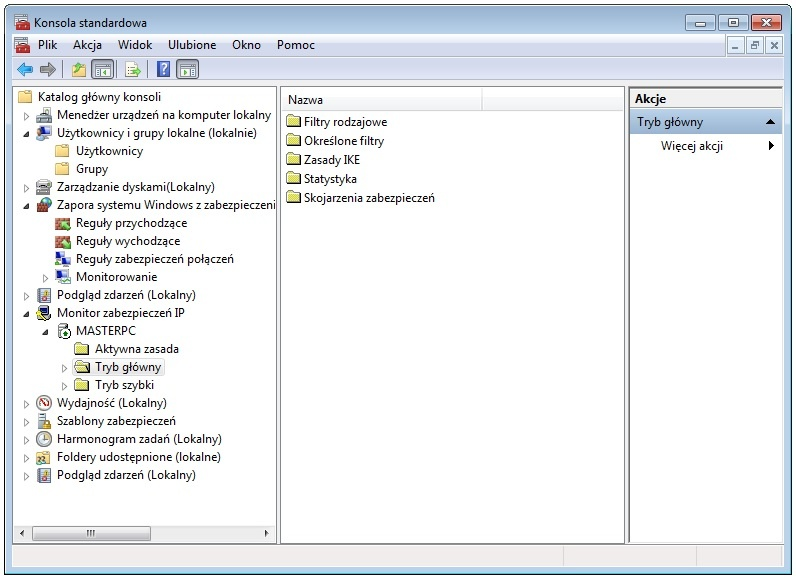

Okno narzędzia przedstawionego na ilustracji można uzyskać poprzez wykonanie polecenia

Celem złocenia styków złącz HDMI jest

Jakie typy połączeń z Internetem mogą być współdzielone w sieci lokalnej?

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

Adres komórki pamięci został podany w kodzie binarnym 1110001110010100. Jak zapisuje się ten adres w systemie szesnastkowym?

Aby zapobiec uszkodzeniom układów scalonych przy serwisie sprzętu komputerowego, należy korzystać z

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

Możliwą przyczyną usterki drukarki igłowej może być awaria

Obniżenie ilości jedynek w masce pozwala na zaadresowanie

Który protokół umożliwia zarządzanie wieloma folderami pocztowymi oraz pobieranie i operowanie na listach znajdujących się na zdalnym serwerze?