Pytanie 1

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Do serwisu komputerowego przyniesiono laptop z matrycą, która bardzo słabo wyświetla obraz. Dodatkowo obraz jest niezwykle ciemny i widoczny jedynie z bliska. Co może być przyczyną tej usterki?

Jak można przywrócić domyślne ustawienia płyty głównej, gdy nie ma możliwości uruchomienia BIOS Setup?

Relacja między ładunkiem zmagazynowanym na przewodniku a potencjałem tego przewodnika wskazuje na jego

Tryb działania portu równoległego, oparty na magistrali ISA, pozwalający na transfer danych do 2.4 MB/s, przeznaczony dla skanerów i urządzeń wielofunkcyjnych, to

Program wykorzystywany w wierszu poleceń systemu Windows do kompresji i dekompresji plików oraz katalogów to

Aby ustalić fizyczny adres karty sieciowej, w terminalu systemu Microsoft Windows należy wpisać komendę

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

Który sterownik drukarki jest niezależny od urządzenia i systemu operacyjnego oraz jest standardem w urządzeniach poligraficznych?

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Urządzenie przedstawione na ilustracji, wraz z podanymi danymi technicznymi, może być zastosowane do pomiarów systemów okablowania

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i centralnie gromadzić o nich informacje, należy zainstalować rolę na serwerze Windows

Określenie najlepszej trasy dla połączenia w sieci to

Metoda transmisji żetonu (ang. token) znajduje zastosowanie w topologii

Jakie elementy wspierają okablowanie pionowe w sieci LAN?

W cenniku usług informatycznych znajdują się poniższe wpisy. Jaki będzie koszt dojazdu serwisanta do klienta, który mieszka poza miastem, w odległości 15km od siedziby firmy?

| Dojazd do klienta na terenie miasta – 25 zł netto |

| Dojazd do klienta poza miastem – 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony. |

Który z poniższych protokołów reprezentuje protokół warstwy aplikacji w modelu ISO/OSI?

Jaki rodzaj licencji pozwala na swobodne modyfikacje, kopiowanie oraz rozpowszechnianie po dokonaniu dowolnej płatności na rzecz twórcy?

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows umożliwi wyświetlenie szczegółów wszystkich zasobów udostępnionych na komputerze lokalnym?

Brak odpowiedzi na to pytanie.

Jakie wbudowane narzędzie w systemie Windows służy do identyfikowania problemów związanych z animacjami w grach oraz odtwarzaniem filmów?

Jaką maskę podsieci należy wybrać dla sieci numer 1 oraz sieci numer 2, aby urządzenia z podanymi adresami mogły komunikować się w swoich podsieciach?

| sieć nr 1 | sieć nr 2 | |

|---|---|---|

| 1 | 10.12.0.12 | 10.16.12.5 |

| 2 | 10.12.12.5 | 10.16.12.12 |

| 3 | 10.12.5.12 | 10.16.12.10 |

| 4 | 10.12.5.18 | 10.16.12.16 |

| 5 | 10.12.16.5 | 10.16.12.20 |

Numer 22 umieszczony w adresie http://www.adres_serwera.pl:22 wskazuje na

W systemie Windows mechanizm ostrzegający przed uruchamianiem nieznanych aplikacji oraz plików pobranych z Internetu funkcjonuje dzięki

Podczas skanowania czarno-białego rysunku technicznego z maksymalną rozdzielczością optyczną skanera, na pochylonych i zaokrąglonych krawędziach można dostrzec schodkowe ułożenie pikseli. Aby poprawić jakość skanowanego obrazu, konieczne jest zastosowanie funkcji

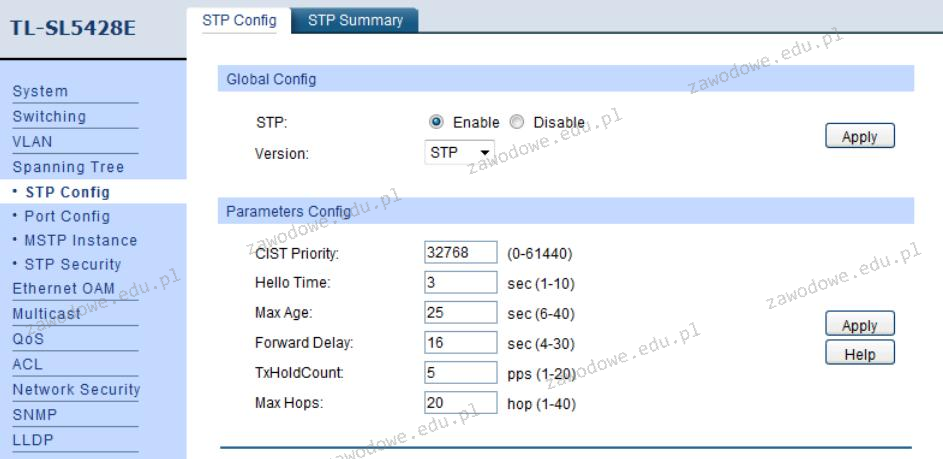

Na podstawie zrzutu ekranu ilustrującego ustawienia przełącznika można wnioskować, że

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Programem, który pozwala na zdalne monitorowanie działań użytkownika w sieci lokalnej lub przejęcie pełnej kontroli nad zdalnym komputerem, jest

Okablowanie pionowe w sieci strukturalnej łączy się

Podczas pracy dysk twardy wydaje stukanie, a uruchamianie systemu oraz odczyt danych są znacznie spowolnione. W celu naprawienia tej awarii, po wykonaniu kopii zapasowej danych na zewnętrznym nośniku należy

Podczas procesu zamykania systemu operacyjnego na wyświetlaczu pojawił się błąd, znany jako bluescreen 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN - nieudane zakończenie pracy systemu, spowodowane brakiem pamięci. Co może sugerować ten błąd?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Program testujący wydajność sprzętu komputerowego to

Aplikacją, która umożliwia wyświetlenie listy aktywnych urządzeń w sieci LAN, jest

Jak nazywa się protokół warstwy transportowej modelu TCP/IP, który nie gwarantuje dostarczenia danych?

Jakie kanały są najodpowiedniejsze dla trzech sieci WLAN 2,4 GHz, aby zminimalizować ich wzajemne interferencje?

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue, press Del to setup) naciśnięcie klawisza Del skutkuje

NOWY, GOTOWY, OCZEKUJĄCY oraz AKTYWNY to

Który z wymienionych składników stanowi element pasywny w sieci?

Najwyższy stopień zabezpieczenia sieci bezprzewodowej zapewnia szyfrowanie

Zamiana koncentratorów na switch'e w sieci Ethernet doprowadzi do